Internet

Sprachen lernen!

![]() Par

blatt-christophe

Le 14/06/2022

Par

blatt-christophe

Le 14/06/2022

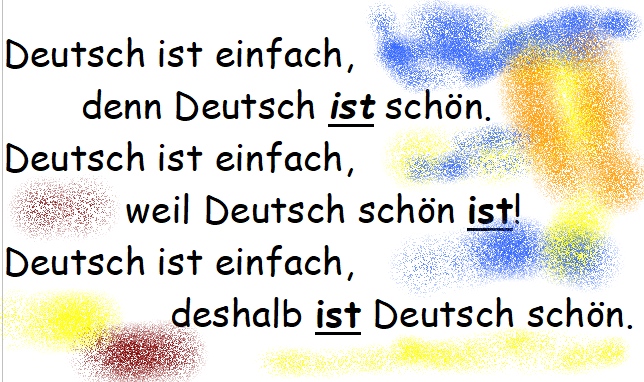

Wir lernen Sprachen, wenn wir eine Sprache lernen wollen.

Pourquoi autoriser le mélange des langues à l’école ?

Grégory Miras, Université de Rouen NormandieDepuis la fin des années 1960, les travaux qui portent sur l’acquisition des langues, tant chez l’enfant que chez l’adulte, s’intéressent à la manière dont les humains sont capables de développer une ou plusieurs langues initiales (la langue « maternelle » qui se conjugue souvent au pluriel) puis d’autres langues additionnelles (les langues « étrangères »).

Ces travaux ont mis en évidence le caractère complexe de ces processus, dont le phénomène d’attrition – le fait de perdre totalement ou partiellement sa compétence dans une langue (parfois sa langue « maternelle ») sous l’effet d’un manque d’actualisation de cette dernière, par la pratique par exemple.

Rappelons que, loin de la vision monolingue française, la grande majorité des humains sur terre est plurilingue. Une situation régulièrement soulignée à l’occasion de la journée européenne des langues.

Si les premiers travaux sur le plurilinguisme ont longtemps considéré le cerveau comme modulaire – c’est-à-dire que le cerveau classerait les langues indépendamment les unes des autres – les avancées en neurocognition tout autant que celles portant sur l’acquisition d’une troisième langue ont ouvert la porte à une compréhension plus complexe de la production du discours.

Pratiques pédagogiques

La manière de considérer le recours à plusieurs langues a évolué au fur et à mesure des avancées scientifiques du domaine. Dans un premier temps, il a été question de considérer les compétences plurilingues comme la capacité à mobilier plusieurs langues de manière superposée et cumulative donc indépendante. Ensuite, cette même compétence a été considérée sous l’angle d’un entrelacement temporaire entre deux ou plusieurs langues – « certains mots transparents ou des faux amis en français se glissent quand je parle en anglais ». Enfin, des travaux plus récents décrivent une approche transversale des langues du répertoire des individus qui transcendent les frontières entre les langues.

Les fondements du « translanguaging » s’inscrivent dans l’école britannique, pour ne pas dire galloise (Trawsieithu), avec les travaux de Cen Williams, dans les années 1980. À ce moment-là, l’objectif pédagogique était de valoriser, à l’école, les langues locales confrontées à l’anglais britannique comme langue d’enseignement. Pour ce faire, la mobilisation et la valorisation des deux langues, pour des objectifs conjoints en production et en perception, étaient légitimées.

Des pratiques de ce type peuvent être identifiées dans d’autres espaces. Ainsi, en Argentine la lecture-compréhension, où les apprenants lisent un texte en langue étrangère et en produisent une synthèse en espagnol, est bien institutionnalisée.

Dans les années 2000, l’école américaine du « translanguaging », incarnée par Ofelia García, élargit ce principe pédagogique vers une compréhension des processus cognitifs transversaux de la maîtrise des langues. Dans son contexte, il s’agissait de réfléchir à l’accompagnement des enfants hispanophones dans le sud des États-Unis d’Amérique où l’anglais américain, comme langue d’enseignement, est un facteur d’échec scolaire. Il s’agit ainsi de reconnaître que les individus ne segmentent pas les langues de leur répertoire mais qu’ils développent des pratiques sociales transversales spécifiques en fonction des contextes de production du discours.

Dans un dispositif pédagogique, les apprenants peuvent lire des ressources dans les langues qu’ils maîtrisent, puis collaborent de manière plurilingue dans la production d’une synthèse dans la langue et la norme visées (le français académique, par exemple) puis terminent par la rédaction d’un texte synthétique dans l’une de leurs langues initiales. Ce principe dépasse le simple fait de « mélanger » des langues comme le font des sketches humoristiques sur l’apprentissage des langues ou des publicités pour des cours d’anglais.

Il est à noter que le terme de « translanguaging » a été traduit et prend des acceptions très différentes dans la recherche francophone comme le précise Guillaume Gentil, professeur en linguistique appliquée à Carleton University. Les principes définis par le « translanguaging » peuvent également apparaître dans d’autres concepts contemporains et francophones comme « la compétence plurilingue » théorisée par Coste, Moore et Zarate et reprise dans le Cadre Européen Commun de Références en Langues (CECRL).

Vers un activisme translingue

Au-delà de la simple description de pratiques pédagogiques ou de processus cognitifs, le « translanguaging » convoque un activisme translingue selon Alastair Pennycook, professeur à l’université de technologie de Sydney. En effet, reconnaître l’existence de cette conception transversale des compétences langagières conduit à des transformations sociétales ayant des répercussions sur les politiques linguistiques.

Le chercheur s’intéresse notamment aux pays où l’anglais a minoré la pratique des langues régionales endogènes et aux formes de libéralisme linguistique (le globish, par exemple).

Cette vision impacte également les politiques éducatives en langues et le cloisonnement des langues étrangères dans les « salles de classe ». Il est question d’ouvrir ces dernières au monde en favorisant une approche par tâches permettant de mieux reconnaître la réalité des pratiques (trans)langagières effectives.

Cependant, il est important de noter que les travaux qui vont dans ce sens suggèrent de reconnaître l’intérêt de valoriser les usages complexes des individus quand il s’agit de « manipuler » plusieurs langues pour réaliser une tâche. Cette reconnaissance ne conduit pas au fait de penser que tout doit se mélanger et l’on pourra attendre des individus qu’ils soient capables, au terme de ce processus translingue, de réaliser une production selon les attendus sociaux, dans la langue étudiée (une dissertation académique, une lettre de motivation, un texte poétique, etc.).

Pour ce faire, Marie-Françoise Narcy-Combes, professeure émérite en didactique des langues, et ses co-auteurs proposent dix principes fondamentaux dont les principaux sont les suivants.

Pour l’apprenant, il s’agit de l’accueillir comme un être unique, complexe et multi-facettes qui ramène avec lui ses connaissances, ses aptitudes et ses expériences culturelles et émotionnelles. Cela conduit à valoriser (et avoir recours) à toutes les langues qu’il parle. Il n’y a pas de « sous-langue » dans un dispositif pédagogique. Cela aura d’autant plus de sens si l’enseignant fait en sorte que l’apprenant soit amené à communiquer dans la langue visée avec des personnes d’autres pays. L’investissement de l’enfant sera d’autant plus important que le travail se fait en faveur du développement de sa créativité, en favorisant un cadre d’apprentissage stimulant.

Pour l’enseignant, il est toujours plus efficace d’être bienveillant et encourageant en proposant des objectifs d’apprentissage clairs et réalistes pour s’assurer que les apprenants les comprennent. Il est pertinent de mettre en place des tâches en lien avec le monde social en dehors de l’école et d’adapter les étapes de travail en fonction des besoins qui émergent au fil de la réalisation de l’exercice.

L’enseignant ne peut avoir toutes les solutions. Il est donc primordial d’encourager la collaboration entre pairs et les interactions sociales (notamment pour l’évaluation par des membres extérieurs au dispositif) mais aussi d’identifier tous les outils facilement disponibles qui permettront aux apprenants de devenir acteurs dans la langue étudiée. Alors comparons nos langues !![]()

Grégory Miras, Maitre de conférences en didactique des langues et prononciation, Université de Rouen Normandie

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

IA: Künstliche Intelligenz?!?

![]() Par

blatt-christophe

Le 19/05/2022

Par

blatt-christophe

Le 19/05/2022

L'intelligence artificielle dans nos vies, au travail: s'adapter ou périr?

Nadia Naffi, Concordia University

À l’ère de la quatrième révolution industrielle, entreprises et travailleurs courent le même risque d’extinction. Pour y faire face, ils doivent faire preuve d’initiative et savoir s’adapter.

À la suite de mes recherches sur le passage de l’état de témoin passif à celui d’agent de changement, j’avance qu'une formation permettant de développer nos connaissances et notre savoir-faire est nécessaire à l’adaptation à l’âge de l’intelligence artificielle (IA).

Mais elle ne suffira pas. Un milieu empathique et empreint de soutien ainsi qu’un apprentissage de soi sont également cruciaux.

La révolution de l’IA est là

La révolution de l’IA est amorcée. La technologie évolue à une vitesse remarquable. La question n’est plus de savoir si l’on s’en sert ou non, mais plutôt comment mieux collaborer avec elle.

Les technologies ambiantes, telles que Siri, Alexa ou Cortana, s’intègrent sans heurt dans nos interactions. Et ce n’est qu’un début.

L’IA émotionnelle apprend aux robots à éprouver de l’empathie. Les articles sur Google AI révèlent la manière dont l’IA aide les gens à résoudre divers problèmes. Les experts s’empressent de prédire comment nous vivrons avec l’IA dans un avenir rapproché, comment il interagira dans le domaine de la santé.

On observe à Montréal une convergence de l’expertise en matière d’IA. Ainsi, le Centre hospitalier de l’Université de Montréal a fondé l’École de l’intelligence artificielle en santé. Quant à Mila, l’Institut québécois d’intelligence artificielle mené par Yoshua Bengio – plus grand spécialiste mondial de l’apprentissage machine et lauréat du prix Turing –, il accélérera le développement de l’IA au Québec.

En France, le gouvernement veut faire du pays « la première terre d’accueil des centres de données en Europe », et les intervenants de l’AI France Summit discutent des « potentialités de l’écosystème France en matière d’intelligence artificielle ». L’Agenda de l’intelligence artificielle prévoit par ailleurs nombre d’événements.

Une tâche qui dépasse l’humain

Les technologies de rupture progressent, la démographie évolue, le pouvoir des consommateurs et l’économie à la demande augmentent, les marchés de talents mondiaux sont en plein essor. L’avenir du travail s’en trouve façonné dans tous les domaines, notamment l’éducation, la cybersécurité, le transport, les soins de santé, la musique et l’agriculture.

Les travailleurs « humains+ » sont ceux qui œuvrent aux côtés des machines pour parvenir à une intelligence collaborative. Ils consolident leurs connaissances, leurs compétences et leurs expériences individuelles au moyen d’un ensemble de capacités technologiques pour améliorer leur rendement.

Enseigner l’adaptabilité

Le 12 février 2019, à l’occasion du CIO Montreal Summit, j’ai abordé la manière de composer avec les technologies de rupture et la diversité, facteurs qui transforment le milieu de travail. Après la table ronde, une participante m’a posé une question clé : comment enseigner l’adaptabilité, soit la capacité de s’accommoder à de nouvelles conditions et de s’épanouir dans de nouveaux environnements, aux dinosaures humains?

« S’adapter ou périr » demeure un mantra du monde des affaires. L'adaptabilité des employés constitue pour eux la clé d’un avenir où nombre des tâches ne peuvent encore être imaginées.

Les employés de la prochaine génération devront être formés comme des humains+ avant d’entrer sur le marché du travail, et la main-d’œuvre actuelle devra se soumettre à une mise à niveau et à un renouvellement continus de ses compétences.

Or, on a peu fait pour repenser la formation et le perfectionnement nécessaires au milieu de travail de l’avenir. Certes, comme la créativité, une autre compétence générale recherchée, l’adaptabilité se révèle plus complexe qu’il n’y paraît.

Elle va au-delà des connaissances et du savoir-faire. Elle exige un changement d’attitude qui ne se produit qu’en révisant nos construits, en tenant compte de nouvelles perspectives et en comprenant que les technologies s’ajoutent à nos propres capacités plutôt que de les remplacer.

Humain contre machine

Beaucoup associent l’IA aux récits de science-fiction, comme la série de films Terminator, où le principal objectif de la technologie est de contrôler, voire d’exterminer la race humaine.

D’autres sont influencés par les mises en garde répétées d’experts du monde entier contre l’IA et la domination technologique. Ainsi, le fondateur de Tesla, Elon Musk, a déclaré à plusieurs reprises que l’IA est plus dangereuse que les armes nucléaires et peut devenir un dictateur immortel. Quant à James Barrat, il s’emploie à mettre en lumière la course à l’intelligence qui se dessine selon lui non pas entre géants de la technologie, mais entre humains et machines.

La technologie a éliminé des emplois dans le passé et en éliminera d’autres dans un avenir rapproché. Les emplois de demain exigeront de la main-d’œuvre actuelle qu’elle s’engage à pratiquer un apprentissage continu.

Par ailleurs, les problèmes éthiques de l’IA n’ont pas encore été résolus, et l’établissement d’un code en la matière s’avère complexe.

Depuis la présentation de la Déclaration de Montréal pour un développement responsable de l’intelligence artificielle, en novembre 2017, jusqu'à son adoption, en décembre 2018, 1 130 citoyens et 28 organismes signataires se sont engagés à favoriser le développement et la mise en œuvre socialement responsables d’une IA qui sert la société et lui profite.

Une évolution empathique

Les dinosaures humains peuvent-ils s’adapter? Je dirais qu’ils le peuvent, mais qu’ils auront besoin du soutien empathique de tout un village.

Les entreprises qui veulent voir leur main-d’œuvre prête pour l’avenir du travail doivent adopter une approche proactive et aider leurs employés à trouver leur place dans le milieu de travail de demain. Surtout, elles doivent comprendre d’où vient la résistance au changement afin d’y remédier.

Simultanément, les entreprises doivent mettre à profit les capacités de leur main-d’œuvre qui ne sont pas propres à un contexte particulier et en faire usage de manière efficace. Avant tout, elles doivent trouver des moyens de préserver les emplois de leurs travailleurs. La peur d’être remplacés peut en effet rendre les dinosaures humains encore moins disposés à changer.

La dynamique d’équipe devrait fonctionner de manière empathique pour faciliter les collaborations entre humains ainsi qu’entre humains et machines, et appuyer chacun dans son processus d’adaptation.

À l’échelle individuelle, nous devons développer notre capacité mentale et émotionnelle ainsi que nos connaissances et compétences pour embrasser notre identité et notre attitude d’humain+. Enfin, nous devons vouloir nous adapter, ce qui exige de changer la manière dont nous voyons le monde. Une fois que nous avons défini et analysé l’essence de notre résistance au changement, nous pouvons élaborer des stratégies qui nous permettront de faire face aux incertitudes et d’expérimenter activement de nouvelles possibilités.

Grâce à cette expérimentation, nous pourrons repenser notre collaboration avec les technologies de rupture et modifier notre conception du milieu de travail de demain.

Le premier World Summit AI Americas, qui a lieu à Montréal le 10 et 11 avril 2019, rassemblera des sommités de l’intelligence artificielle. Outre les fascinantes discussions prévues sur le concept d’AI4Good, les solutions appliquées pour les entreprises, les ateliers pratiques et l’élaboration de plans de mise en œuvre de l’IA au cours de l’année à venir, j’encourage vivement les influenceurs qui seront présents à discuter de l’adaptation de la main-d’œuvre ainsi que de stratégies concrètes pour l’appuyer et la faciliter.![]()

Nadia Naffi, Assistant Professor in the Department of Education (Educational Technology), Concordia University

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Probleme lösen? Algorithmus!

![]() Par

blatt-christophe

Le 12/12/2021

Par

blatt-christophe

Le 12/12/2021

Wir wollen Probleme definieren und wir wollen Lösunge finden. Damit stellt sich die Frage: Wie kann ich ein bestimmtes Problem lösen? Welche Schritte, welche Prozeduren sind notwendig, um in einer gegebenen Situation Lösungen zu erarbeiten?

Ein Algorithmus ist eine Definition von Schritten, um Lösungen methodisch zu erarbeiten.

Qu’est-ce qu’un algorithme ?

Jean Cardinal, Université Libre de Bruxelles (ULB)

Le mot « algorithme » est utilisé couramment dans la presse pour désigner le fonctionnement opaque des moteurs de recherche et des réseaux sociaux.

Mais de quoi parlons-nous exactement ? Qu’est-ce qu’un algorithme ? Cette notion a traversé l’histoire, depuis Euclide jusqu’aux algorithmes des GAFAM. Les algorithmes peuvent-ils résoudre n’importe quel problème ? Quelles garanties a-t-on sur leur comportement ? Quels sont leurs impacts sociétaux ?

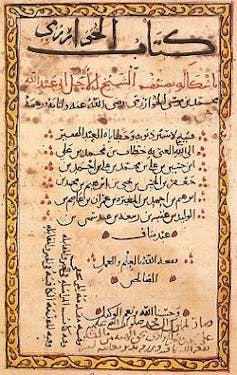

Au IXe siècle, en Perse

L’étymologie fait remonter l’histoire des algorithmes au savant persan Muhammad Ibn Mūsā al-Khuwārizmī, qui aux alentours de l’an 800 a publié les premiers manuels de résolution d’équations. Ses méthodes, à l’origine de l’algèbre, concernent typiquement des problèmes de calcul pratiques : des questions d’héritage ou de mesure.

Ses ouvrages sont traduits en latin au cours du XIIe siècle et popularisés par des personnalités telles que le mathématicien italien Leonardo Fibonacci. C’est son nom, latinisé en « algoritmi » ou « algorismi », qui est à l’origine du terme « algorithme ». Près d’un millénaire avant lui, Euclide avait décrit dans les Éléments une méthode pour calculer le plus grand diviseur commun de deux nombres.

Au XXe siècle, la notion d’algorithme construit des branches des mathématiques

Il faut pourtant attendre le début du XXe siècle pour que la notion d’algorithme soit formalisée. Dans son célèbre discours au deuxième congrès international des mathématiciens à Paris en 1900, le mathématicien allemand David Hilbert propose 23 problèmes ouverts, 23 défis à relever pour la communauté mathématique, dont les énoncés auront une influence considérable sur le développement des mathématiques dans les décennies suivantes. Le dixième problème porte sur l’existence d’une « méthode par laquelle, au moyen d’un nombre fini d’opérations, on pourra déterminer l’existence d’une solution en nombres entiers à une équation polynomiale à coefficients entiers » (les équations « Diophantiennes »). C’est bien de l’existence d’un algorithme qu’il s’agit.

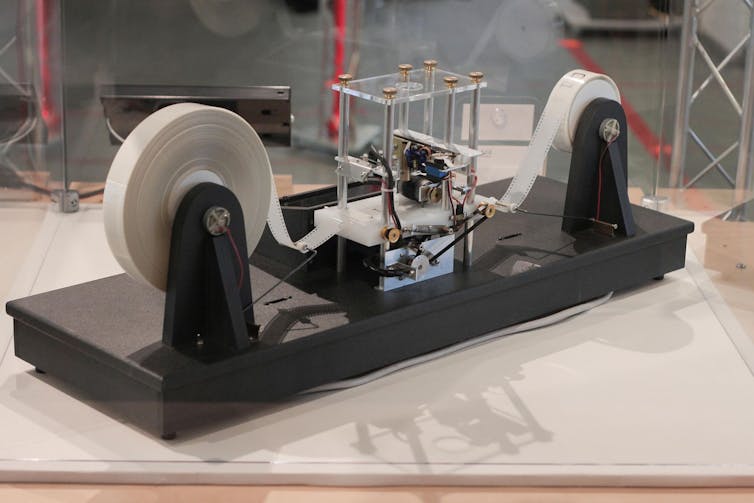

C’est par les travaux fondateurs d’Alan Turing et d’Alonzo Church, entre autres, que les algorithmes deviennent des objets mathématiques à part entière. Dans son article de 1936, Alan Turing donne sa définition de la « calculabilité » d’une fonction : il doit exister une machine qui donne sa valeur en un nombre fini d’étapes élémentaires, guidées par un système de transitions et le contenu d’un ruban, qui joue le rôle de mémoire. C’est la célèbre « machine de Turing ».

Alan Turing comprend le lien entre la calculabilité d’une fonction et le caractère démontrable d’une assertion mathématique dans un système d’axiomes. L’informatique théorique devient une branche des mathématiques.

On circonscrit la puissance des algorithmes, et certains problèmes sont démontrés indécidables : aucun algorithme n’existe pour les résoudre. En 1970, Julia Robinson et Youri Matiiassevitch résolvent finalement le dixième problème de Hilbert : la résolution des équations diophantiennes est un problème indécidable !

Au cours des années 1970, on établit des hiérarchies de problèmes en fonction du temps et de l’espace qu’un algorithme requiert pour les résoudre : c’est la théorie de la complexité.

Comment se présente un algorithme ?

Les algorithmes sont souvent comparés à des recettes de cuisine : une suite d’instructions précises permettant d’obtenir un résultat en un nombre fini d’étapes.

Cette image est juste, mais occulte sans doute un aspect fondamental, le fait qu’un algorithme reçoit des données à traiter (nombres, texte, relations), et certaines instructions sont conditionnelles : les étapes suivies dépendent de ces données, et les exécutions peuvent suivre un cours difficilement prévisible. On peut donner ces instructions sous différentes formes bien définies (organigramme, langage de description), ou même, avec les précautions de rigueur, en langage naturel.

Nous avons tous appris l’algorithme de multiplication de deux nombres à l’école primaire, sans l’aide d’un formalisme avancé. Les algorithmes sont en principe destinés à être mis en œuvre sous forme de programme, dans un langage de programmation compréhensible par un ordinateur. Mais l’algorithme existe indépendamment de cette traduction.

Pour cerner la portée des algorithmes dans nos vies modernes, il faut distinguer leurs familles

Pour mieux comprendre les enjeux et les défis actuels autour des algorithmes, il est important de cerner leur portée et les propriétés que nous sommes à même de garantir sur leurs résultats et leurs comportements. Une typologie des algorithmes est indispensable à cette compréhension.

On peut d’abord distinguer une famille d’algorithmes tellement omniprésents dans notre quotidien qu’ils y sont presque devenus invisibles. Il s’agit d’algorithmes exacts pour des tâches parfaitement bien définies, dont le résultat est facilement vérifiable : multiplier deux nombres, trier une liste de noms par ordre alphabétique, stocker et retrouver efficacement une information, effectuer la conversion d’un signal analogique vers un signal numérique, interpréter un programme.

Il s’agit là des algorithmes fondamentaux étudiés depuis les balbutiements des sciences informatiques. Ils ne font pas moins pour autant l’objet de recherches actuelles, tant des mystères subsistent autour de la complexité de certaines opérations fondamentales. La complexité exacte du problème de multiplication de deux nombres entiers, par exemple, est d’un point de vue théorique encore ouverte : nous sommes actuellement incapables de démontrer que la multiplication prend nécessairement plus de temps que l’addition ! Le meilleur algorithme de multiplication connu n’a été publié que très récemment.

Les algorithmes d’optimisation constituent une deuxième famille importante. Ils résolvent des problèmes dans lesquels on cherche à identifier des paramètres ou une configuration qui maximise ou minimise une valeur, appelée « fonction objectif ». Les applications concrètes consistent par exemple en la recherche d’un chemin le plus court entre deux points, l’ordonnancement des phases d’un projet pour en minimiser la durée, le choix des emplacements d’antennes pour couvrir à moindre coût une zone donnée, ou celui des paramètres des routeurs d’un réseau pour en minimiser la latence.

Les objectifs des algorithmes de ces deux familles sont quantifiables et leurs résultats sont mathématiquement garantis. Les méthodes formelles permettent de vérifier rigoureusement les propriétés d’un algorithme. Les algorithmes d’optimisation linéaire sont bien compris.

Une troisième famille d’algorithmes, plus spécialisés, est celle des algorithmes cryptographiques, destinés à garantir la sécurité des communications et transactions. Cette sécurité repose souvent sur des hypothèses liées à la complexité de problèmes algorithmiques. Le célèbre algorithme RSA (du nom de ses inventeurs : Ronald Rivest, Adi Shamir et Leonard Adleman), par exemple, fait reposer la sécurité des transactions commerciales électroniques sur l’hypothèse qu’il n’existe pas d’algorithme efficace pour décomposer un nombre en ses facteurs premiers.

Certaines procédures issues des recherches en intelligence artificielle, en revanche, ne se soumettent pas facilement à une analyse rigoureuse.

Les algorithmes changent de nature avec l’intelligence artificielle

Parmi ceux-ci, les algorithmes de classification cherchent à placer les données reçues en entrée dans une catégorie correspondant à une réalité extérieure. Un algorithme de reconnaissance d’animaux, par exemple, recevra en entrée une image sous forme d’un tableau de pixels, et devra déterminer si cette image représente plutôt un chat ou un dauphin. Cette tâche n’est pas formellement bien définie : on peut probablement trouver une image ambiguë pour laquelle les réponses fournies par des humains pourraient être différentes. Le caractère correct de ces algorithmes dépend d’une réalité extérieure, qui n’est pas formalisée, et leur exactitude, ou précision, ne peut être établie qu’expérimentalement.

De la même manière, les algorithmes de prédiction cherchent à anticiper l’évolution de certaines quantités mesurées dans le monde physique, ou des comportements dans une population. Ils sont utilisés par exemple en finance pour prédire l’évolution des marchés, ou en marketing, pour présenter aux visiteurs d’un site web les produits ou publicités les plus susceptibles d’attirer leur attention. La pertinence des résultats est ici encore validée empiriquement, et non mathématiquement. À tel point qu’en 2006, la société Netflix a lancé un concours pour améliorer les performances de son algorithme de prédiction d’évaluations de films, avec un prix d’un million de dollars à la clé.

Le développement des ces algorithmes fait massivement appel à des modèles probabilistes, mais aussi à des structures difficilement analysables rigoureusement. C’est le cas en particulier pour les algorithmes de réseaux de neurones artificiels utilisés dans ce qu’on appelle désormais l’« apprentissage profond », en référence au nombre de couches utilisées dans ces réseaux. Ces réseaux encodent implicitement la mémoire des données fournies lors d’une phase d’apprentissage, et permettent de classifier de nouvelles données en entrée.

Que pouvons-nous exiger des algorithmes ?

L’omniprésence des algorithmes fait légitimement l’objet de craintes. Quelles sont les garanties que nous pouvons exiger ?

Un premier type de garantie porte sur l’efficacité. Combien de temps doit-on attendre pour avoir une réponse ? De quelle quantité de mémoire doit-on disposer ? Ces questions sont bien étudiées et ont des formulations et des réponses rigoureuses, mais partielles. Les lacunes dans notre compréhension de la complexité algorithmique laissent en particulier ouverte la possibilité d’attaques inédites mettant en péril la cryptographie basée sur l’algorithme RSA.

La question traditionnelle des performances est intimement liée aux questions de consommation de ressources, qui ont des impacts écologiques. On peut donner à cette question un cadre plus large, et s’interroger sur les ressources consommées par les logiciels, les serveurs. Dans le domaine des algorithmes cryptographiques, certains mécanismes au cœur du fonctionnement des cryptomonnaies, en particulier le principe de la « preuve de travail », ont un impact énergétique dramatique.

Lorsque les objectifs sont facilement vérifiables, comme dans le cas d’un algorithme de tri, ou quantifiés explicitement, comme dans le cas d’un algorithme d’optimisation, il existe une mesure objective de la qualité de la solution. Dans le cas des algorithmes d’optimisation, cependant, le choix de la fonction objectif, la quantité que l’on optimise, peut avoir un impact humain considérable.

Des questions d’éthique

Les questions d’équité et de transparence des algorithmes de classification et de prédiction deviennent pressantes. Dans un ouvrage devenu classique, Cathy O’Neil alerte sur les dérives des systèmes de prise de décision dans les domaines de la justice, de l’action policière, des assurances, de l’évaluation des enseignants, entre autres.

L’algorithme de Gale-Shapley, utilisé par la plate-forme Parcoursup satisfait des propriétés d’optimalité, mais garantit également qu’un comportement stratégique de la part des postulants est impossible.

Les méthodes d’apprentissage supervisé pour la classification consistent classiquement en une collection d’exemples, de paires « entrée-sortie », dont on espère qu’ils peuvent être généralisés, de façon qu’une nouvelle donnée en entrée puisse être associée à une réponse en sortie qui fasse sens. En ne fournissant que des exemples connus lors de ces phases d’apprentissage, on inculque au système tous les biais présents de facto dans les exemples dont on dispose, et l’on apprend ainsi à la machine à les reproduire. C’est le thème du documentaire Coded Bias, relatant l’expérience d’une étudiante du MIT avec les algorithmes de reconnaissance faciale.

Le caractère parfois inexplicable des résultats termine d’expliquer le glissement sémantique récent du mot algorithme : de simple méthode de calcul, l’algorithme est perçu comme une boîte noire omnipotente, dont le fonctionnement interne est inaccessible, et dont les réponses finissent par se substituer à la réalité. Cette perception s’explique notamment par la résurgence des méthodes de réseaux de neurones, dont la complexité défie toute analyse formelle. Les succès expérimentaux dans les tâches confiées aux réseaux profonds sont indéniables et fascinants. Mais certaines expériences mettent en évidence leur fragilité : des chercheurs ont montré qu’en modifiant de manière imperceptible quelques pixels bien choisis d’une image, on peut changer du tout au tout la réponse fournie. En l’absence d’explicitation de la réponse (« c’est un chat, car il a des oreilles pointues et des moustaches »), les questions de confiance et de responsabilités se posent.

La communauté de recherche en intelligence artificielle et en apprentissage automatique s’est emparée des questions d’équité et d’explicabilité : le développement de méthodes d’apprentissage incluant des critères d’équité (fairness in AI) est en plein essor, tandis que le domaine de l’intelligence artificielle « explicable » (explainable AI) traite de la justification des résultats et de la confiance.

Al-Khuwārizmī aurait sûrement été surpris de la postérité de son patronyme !![]()

Jean Cardinal, Professeur, Département d'informatique, Faculté des Sciences, Université Libre de Bruxelles (ULB)

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Aber dieser Ansatz schafft neue Probleme.

Entsteht die Lösung des Problems durch die dabei genutzte Methode?

Werden mögliche Lösungen etwa durch die benutzte Methode verdeckt?

Oder ist die Erarbeitung des Werkzeugs, des Algorithmus, das zentrale Problem, um Lösungen zu erarbeiten?

PASCH: Eine Initiative für ... Zusammenarbeit.

![]() Par

blatt-christophe

Le 05/10/2021

Par

blatt-christophe

Le 05/10/2021

Le 11 Septembre a bouleversé nos mémoires.

![]() Par

blatt-christophe

Le 11/09/2021

Par

blatt-christophe

Le 11/09/2021

Der 11. September 2001 verändert die Welt. Eine neue Weltordnung ist dabei zu entstehen.

-- Was müssen wir lernen? -- Und wie können wir die Situation politisch gestalten?

Aber zuerst: Welche Folgen hat der 11. September für die jungen Menschen heute?

Comment le 11 Septembre a bouleversé nos mémoires

Deux décennies ont passé, mais les souvenirs du 11 septembre 2001 semblent toujours aussi vivaces dans les esprits de ceux qui ont assisté, de près ou de loin, à ces terribles attentats. Directeur de l’unité de recherche « Neuropsychologie et imagerie de la mémoire humaine » à l’Université Caen Normandie, Francis Eustache nous explique pourquoi, et revient sur ce que les recherches des vingt dernières années nous ont appris sur les processus de mémorisation.

The Conversation : En quoi le 11 Septembre a-t-il marqué un tournant dans la recherche sur le traumatisme et la mémoire ?

Francis Eustache : L’impact du 11 Septembre a été majeur, dans nos sociétés, mais aussi dans le monde de la recherche. Après ces attentats, de nombreux travaux ont été menés pour comprendre non seulement la mémoire traumatique, mais aussi la façon dont la mémoire évolue au cours du temps.

Ces travaux ont contribué à modifier de notre perception de la mémoire, en particulier dans ses aspects malléables, dynamiques. Ils ont aussi permis de mieux comprendre les relations entre mémoire individuelle et mémoire collective. Après ces attentats, la notion de trouble de stress post-traumatique a également diffusé beaucoup plus largement dans le grand public.

On peut en effet distinguer plusieurs grandes étapes dans la compréhension de ce syndrome, décrit dès le milieu du XIXe siècle chez les victimes de grandes catastrophes ferroviaires : les deux guerres mondiales, la guerre du Vietnam, la prise de conscience au niveau sociétal de l’impact des violences faites aux femmes et aux enfants dans les années 1970… Mais jusqu’au 11 Septembre, ces informations circulaient surtout dans certains milieux spécialisés. Après cette date, le grand public a pris conscience que le psychotraumatisme entraînait différents symptômes et en particulier des troubles de la mémoire.

TC : Par leur ampleur, par la profusion des images, par le suivi quasi minute par minute du déroulé des événements, ces attentats ont marqué durablement les esprits, bien au-delà des personnes qui ont vécu un psychotraumatisme. Chacun a l’impression de se souvenir très précisément de ce qu’il faisait au moment de l’attaque. Comment cela s’explique-t-il ?

FE : Ce phénomène s’appelle « souvenir flash » (« flash bulb memory » en anglais) : cette expression désigne un souvenir détaillé et vivace qui fixe précisément les circonstances dans lesquelles nous sommes informés de la survenue d’un événement collectif inattendu, surprenant et empreint d’émotion. Une autre dimension importante intervenant dans la formation du souvenir flash est que nous percevons immédiatement que l’information reçue va avoir d’importantes conséquences, pour nous-mêmes et pour la société (quand bien même nous n’en appréhendons pas la portée exacte). En revanche, nous ne participons pas directement à l’événement qui survient ; nous sommes spectateurs à distance, sans possibilité d’action efficace.

Typiquement, après le 11 Septembre, les connaissances sur le souvenir flash ont fait l’objet d’un renouvellement majeur. Avant cette date, le débat était de savoir si le souvenir flash appartenait à une catégorie spéciale de souvenir, plus précis, moins susceptible de s’altérer dans le temps, qui aurait été produite par des mécanismes particuliers. Selon certains, il se serait agi d’un souvenir permanent et indélébile.

Or, les recherches post-11 Septembre (en particulier celles de l’équipe de William Hirst, à la New School de New York, avec qui nous avons aussi collaboré) ont montré que ce n’est pas le cas. En réalité, le souvenir flash est un souvenir comme les autres, qui lui aussi se modifie au fil du temps. Il est juste en quelque sorte « augmenté », plus vivace, par rapport à d’autres souvenirs autobiographiques.

TC : C’est-à-dire ?

FE : Quand on mémorise un souvenir, on encode également son contexte : on sait où l’on est, qui nous donne l’information, le moment où se passe la scène, ce que l’on est en train de faire. À mesure que le temps passe, le souvenir évolue, devient moins précis. Dans le cas du souvenir flash, étant donné qu’il s’agit d’un souvenir qui se forme dans un contexte émotionnel intense, ledit contexte est très fortement mémorisé, y compris en cas d’une activité aussi banale que d’éplucher des légumes dans sa cuisine.

On en vient donc naturellement et inconsciemment à se dire « si je me souviens tellement précisément qu’à ce moment je faisais quelque chose d’aussi trivial, le reste aussi doit être vrai ». On est tellement sûr de se souvenir du contexte qu’on est également certain du contenu du souvenir. Mais ce n’est pas vrai : comme les autres souvenirs, le souvenir flash a pu évoluer avec le temps. Ce qui peut mener à de faux souvenirs dont on ne veut pas démordre…

TC : Comment s’en est-on aperçu ?

FE : Pour déterminer si le souvenir flash avait une spécificité ou s’il s’agissait d’un souvenir autobiographique « normal », les scientifiques ont étudié quatre paramètres : sa précision (qui fait référence à la véracité des détails mémorisés), sa vivacité (qui correspond à la richesse de l’expérience phénoménologique associée au rappel du souvenir), la confiance en sa recollection (qui concerne le sentiment de certitude qu’ont les individus en leur remémoration), et sa stabilité dans le temps.

William Hirst et ses collaborateurs ont par exemple interrogé 3 246 Américains vivant dans sept villes des États-Unis sur leurs souvenirs des attentats du 11 septembre 2001. Leurs résultats indiquent que le taux d’oubli des détails associés au souvenir flash était important la première année (30 %) puis diminuait les deux années suivantes (entre 5 et 10 %) avant de devenir négligeable jusqu’à la dixième année. Cette évolution suit la même courbe que celle d’un souvenir classique.

Nous avons nous-mêmes analysé les mots utilisés par 206 personnes à qui nous avons demandé d’évoquer leurs souvenirs du 11 septembre 2001 une semaine, un an, deux ans et dix ans après les attentats. Nos travaux, publiés cette année, révèlent que dans les premiers temps, le registre émotionnel prédomine, ainsi que la précision temporelle. Les gens décrivent avec exactitude le déroulé des événements, les horaires. Puis au bout de quelque temps, assez rapidement, cette précision s’estompe, et les témoignages se focalisent sur les références spatiales. En outre, l’évolution du souvenir flash de l’attentat est très influencée par la façon dont l’événement est rapporté par les médias.

Tous ces résultats indiquent que le souvenir flash, comme les autres souvenirs, se transforme au fil du temps. C’est un souvenir puissant au plan émotionnel, mais ce n’est pas un souvenir indélébile. Cela peut parfois être difficile à entendre, mais c’est aujourd’hui clairement démontré.

TC : Cette conclusion concerne le souvenir flash, mais n’a rien à voir avec le souvenir traumatique, tel que celui qui peut survenir chez certaines victimes d’attentats…

FE : Effectivement, souvenir flash et souvenir traumatique sont deux représentations mnésiques très différentes. D’ailleurs, le « souvenir traumatique » n’est pas un souvenir à proprement parler.

Contrairement au souvenir flash, dans le cas d’une situation potentiellement traumatique, l’individu se trouve directement confronté avec l’événement. Il perçoit un risque immédiat pour son intégrité physique (ou pour l’intégrité physique de quelqu’un situé à proximité, avec qui il est en empathie), mais sans pouvoir agir avec efficacité. Dans ce cas, l’encodage du souvenir se fait très différemment, sans renforcement contextuel. Le souvenir traumatique présente un profil presque inverse du souvenir flash, de ce point de vue.

Cependant, il existe entre les deux une forme de continuum, en ce sens que l’on monte en intensité émotionnelle. Chez certaines personnes, dans ce « no man’s land » entre souvenir flash et souvenir traumatique se trouve un point de rupture émotionnelle au-delà duquel peut se produire un basculement.

TC : Cela signifie-t-il que l’on peut développer un trouble de stress post-traumatique, même si l’on ne s’est pas trouvé à proximité des tours jumelles le 11 septembre 2001 ? Simplement en étant exposé aux images de l’attentat, par exemple ?

FE : Oui, même si ce n’est bien sûr pas la règle. C’est aujourd’hui un fait bien documenté, et cela a malheureusement été confirmé lors des attentats qui sont survenus par la suite.

Quant à savoir quel est le rôle joué par les images à proprement parler, c’est une question complexe. Bien entendu, chez l’être humain le canal visuel est très prégnant, c’est un vecteur important pour la fabrication des mémoires en général. Quand on évoque un souvenir, ce sont souvent d’abord les images qui reviennent en mémoire. Néanmoins, un point est probablement plus important qu’une éventuelle hiérarchie des sensorialités : c’est le fait que ce qui est perçu soit décontextualisé, encore une fois. Cette absence de contexte mime la situation traumatique.

C’est un point intéressant que l’on a observé dans le cas des attentats du 13 novembre 2015 à Paris : les images qui ont tourné en boucle sur les chaînes d’information en continu, souvent hors de tout contexte (bandeaux défilants mentionnant des informations sans lien avec les images, son coupé dans les lieux publics privant les spectateurs de commentaires, etc.), ont contribué au développement de troubles de stress post-traumatique chez certaines personnes. Ces chaînes n’existaient pas au moment des attentats du 11 Septembre 2001, mais les images en boucles sur toutes les télévisions du monde ont pu avoir le même effet.

TC : À nouveau, on voit que le collectif influence la mémoire individuelle…

FE : C’est un point important : les études menées sur le 11 Septembre ont contribué à établir les liens entre la mémoire des individus et la mémoire collective. Celle-ci se construit de diverses façons, via la narration des médias, la création de mémoriaux, l’organisation de commémorations, l’éducation…

À partir de cette date tragique, on a également réalisé l’importance de la mémoire communicative. Notre mémoire ne se construit pas uniquement dans notre intimité subjective, mais aussi via nos échanges : quand nous enregistrons un souvenir, nous le faisons dans un cadre social, et il en est de même quand nous l’évoquons avec les autres, que nous en parlons. Dès 1926, le sociologue Maurice Halbwachs avait pressenti l’importance de ce qu’il nommait « les cadres sociaux de la mémoire ».

Le trouble de stress post-traumatique survient justement en raison de ce manque de cadre social. La personne qui en souffre mémorise des éléments disparates, très sensoriels et fortement émotionnels, de la scène vécue sans assemblage par le contexte qui permettrait de les unifier et de les faire évoluer dans le temps comme d’autres souvenirs.

Dans le trouble de stress post-traumatique, ces éléments disparates peuvent se transformer en images intrusives qui envahissent la conscience de la personne qui en est victime ; elle les vit comme de nouveaux événements surgissant dans son présent.

TC : Les relations sociales jouent aussi un rôle important dans la prise en charge des blessés psychiques…

FE : Tout à fait. Il y a bien entendu les cellules d’urgence médico-psychologiques, des dispositifs précoces faisant intervenir psychologues, psychiatres, soignants spécifiquement formés pour prendre en charge les blessés psychiques immédiatement après l’événement traumatisant. Mais par la suite, le soutien social est également primordial.

Les blessés psychiques sont très sensibles à l’entourage de leurs proches et de la société. Même ceux qui ne le montrent pas, et donnent l’impression de vouloir s’isoler. Dans cette situation, il est essentiel de maintenir le contact. Et surtout, il faut avoir conscience que les échelles de temps peuvent être très longues. Trop souvent, les proches aimeraient que les personnes traumatisées passent rapidement « à autre chose », qu’elles reprennent leurs activités. Mais c’est souvent difficile.

Nous avons évoqué le traumatisme du 11 Septembre et, plus largement, celui des attentats. Il s’agit, le plus souvent, d’un événement unique dans la vie de l’individu. Mais les situations sont très différentes d’une personne à l’autre. Je pense en particulier aux personnes endeuillées qui ont perdu un proche ou encore à celles qui conservent des séquelles physiques. Le traumatisme peut aussi entraîner d’autres complications, comme une dépression.

Toutefois, nous avons aujourd’hui une meilleure connaissance du traumatisme. Les recherches qui sont menées, y compris au plan thérapeutique, modifient notre regard et les pratiques. Aujourd’hui, des thérapies innovantes sont proposées, qui prennent en compte non seulement la personne souffrant de trouble de stress post-traumatique, mais également son environnement familial.![]()

Francis Eustache, Directeur de l'unité Neuropsychologie et imagerie de la mémoire humaine, Inserm, Ecole Pratique des Hautes Etudes, Université de Caen Normandie, Inserm

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Warum sprechen wir verschiedene Sprachen?

![]() Par

blatt-christophe

Le 25/08/2021

Par

blatt-christophe

Le 25/08/2021

Warum sprechen wir verschiedene Sprachen? Und welche Folgen hat das für die Gesellschaften?

-- Sprachen haben eine Geschichte, sie sind Teil einer Familie und sie verändern sich in der Zeit.

Wir müssen oder dürfen oder können uns mit Übersetzungen verstehen. Wir müssen das Übersetzen ... lernen.

Oscar : « Pourquoi n’y a-t-il pas qu’une langue parlée sur Terre ? »

Cameron Morin, Université de Paris

Merci, Oscar, sache que c’est une question plus compliquée qu’on ne le croit et qui a interrogé l’humanité depuis bien des années !

À première vue, on a souvent envie de penser que la grande diversité de langues qui peuplent notre monde remonte aux origines de l’humanité elle-même.

Une des histoires les plus connues qui a tenté de répondre à cette question, c’est celle de la Tour de Babel, dans la Bible. Je te raconte : au commencement du monde, tous les humains parlaient la même langue. C’était une situation vue comme idéale, car ainsi tout le monde se comprenait : moins de risques de malentendus entre les communautés, une communication plus simple, universelle, et propice à la paix. Seulement, les humains utilisèrent cet outil à de mauvaises fins : ils voulurent construire une ville dont la tour principale serait si haute qu’elle toucherait le ciel, le domaine de Dieu. Ce dernier, voyant cette démesure, décida de disperser les bâtisseurs aux quatre coins de la Terre et de brouiller leur langue, afin que chaque groupe en parle une différente et qu’ils ne puissent plus se comprendre. Ainsi naquirent les langues.

Bien sûr, il s’agit d’une histoire, mais elle souligne un certain nombre de problèmes lorsqu’on pense à l’origine du langage et sa diversification sous forme de langues. Les disciplines qui étudient ces questions sont la linguistique (l’étude du langage) et l’anthropologie (l’étude de l’espèce humaine). Beaucoup de scientifiques étudient ces deux domaines depuis le XIXe siècle, mais il reste encore de nombreuses controverses (des débats compliqués) dans les théories. Elles étudient des périodes de l’histoire humaine si anciennes qu’on y trouve très peu d’indices sur les langues parlées à l’époque. Il faut dire que l’écriture n’avait pas encore été inventée, encore moins les cassettes audio !

Tout d’abord, est-ce que l’humanité a démarré avec une et une seule langue ? Ce problème concerne l’évolution du langage : les étapes biologiques qui nous ont permis de communiquer avec des systèmes d’expression de plus en plus créatifs et de plus en plus complexes, qu’on pourrait appeler provisoirement la « grammaire ». Tout comme pour l’origine de la vie, les scientifiques débattent depuis longtemps de la source du langage : a-t-elle émergé à un seul endroit sur Terre ou à plusieurs endroits en même temps ?

Si c’est la première réponse, alors oui, l’humanité a peut-être démarré avec une seule langue, mais sans doute une langue partagée par un tout petit groupe, et qui a très vite changé par la suite. Si c’est la deuxième réponse, alors le langage aurait émergé au sein de plusieurs groupes humains distincts, et donc il y aurait eu, dès le départ, plusieurs langues parlées sur Terre. Les deux positions semblent se défendre et il y a un vrai débat, à cause du manque de données et de preuves issues de notre Préhistoire… Mais dans les deux cas, il semble improbable que tous les humains, au sein d’une grande population allant de l’Europe à l’Asie, aient pu parler une seule et même langue partout, comme dans l’histoire de la Tour de Babel.

Pourquoi c’est improbable ? Parce que la langue a la caractéristique unique de changer en permanence, et très vite, lorsqu’elle est parlée par des groupes de plus en plus nombreux, et dans un espace géographique de plus en plus grand.

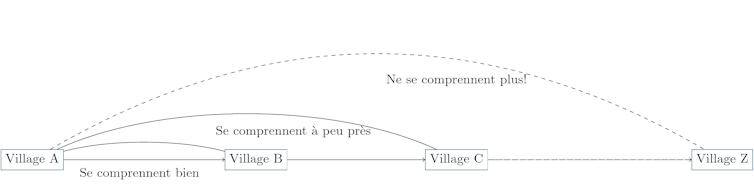

Lorsque nous parlons une langue, nous nous mettons d’accord sur les mots que nous utilisons et les règles grammaticales qui vont les organiser dans des phrases. Mais ces mots et ces règles ne sont jamais exactement les mêmes entre deux individus ni entre deux groupes. Cette variation a pour résultat de faire changer les langues, et d’en créer des nouvelles. Par exemple : prenons le village A, qui parle une langue. Le village B, qui est juste à côté, parle presque la même langue, avec peut-être quelques mots qui changent. Le village C, un peu plus loin, parle une langue similaire, mais avec certaines règles qui diffèrent… Et ainsi de suite, jusqu’au village Z, qui est si loin du village A qu’ils ne se sont jamais rencontrés, et qu’ils parlent une langue si différente qu’ils ne se comprendraient pas !

Notre exemple des villages souligne la variation des langues dans l’espace, mais une autre dimension importante, c’est le changement au cours du temps : par exemple, si tu compares ta manière de parler avec celle de tes parents, tu remarqueras sans doute que vous utilisez des mots un peu différents. En principe, ces différences devraient être encore plus remarquables entre ta manière de parler et celle de tes grands-parents. Tu peux faire le test !

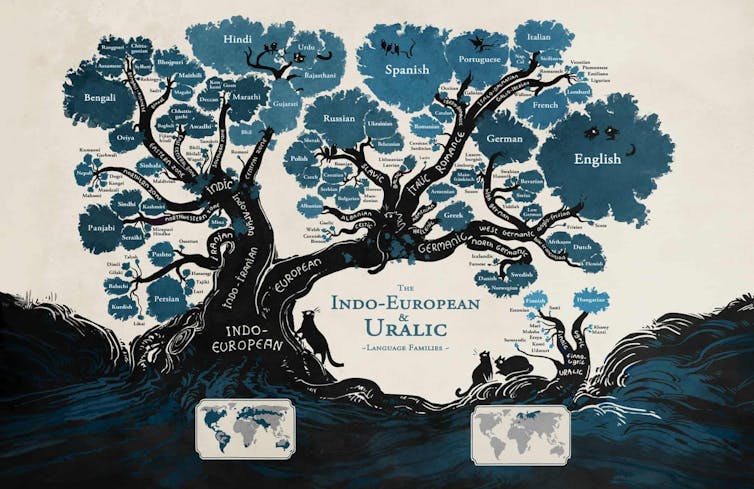

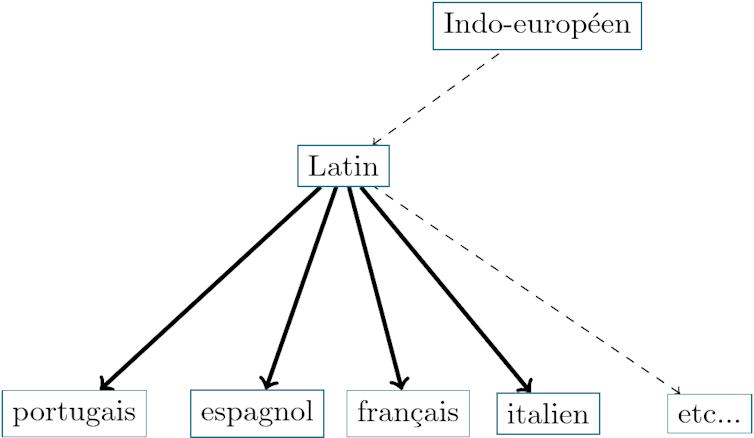

Cette variabilité fondamentale du langage nous donne l’immense nombre de langues qui s’est développé au cours de l’Histoire : aujourd’hui, on les estime à environ 7000 dans le monde – un nombre qui malheureusement décline, à cause d’un phénomène contemporain d’extinction des langues. Chacune de ses langues s’inscrit dans une famille, avec des « frères et sœurs » contemporains (par exemple, le français, l’italien et l’espagnol) et un parent antérieur (le latin). Au XIXe siècle, les linguistes et anthropologues firent une découverte majeure sur les plus de 200 langues parlées en Europe. Une grande partie de celles-ci seraient issues d’une langue commune et très ancienne, répandue en Eurasie : l’indo-européen ! Au fur et à mesure des années, et avec les mouvements de populations qui se sont séparés dans des pays de plus en plus éloignés, l’indo-européen s’est subdivisé en plusieurs familles et sous-familles : parmi les plus connues, les langues slaves (russe, tchèque, croate), celtiques (gaélique, gallois, breton), germaniques (allemand, anglais, scandinave), romanes, et bien d’autres.

Voilà certaines raisons pour expliquer qu’il n’y ait pas qu’une langue parlée sur Terre. Mais est-ce que c’est une mauvaise chose, comme le sous-entend l’histoire de Babel ? Bien que les langues du monde soient très différentes les unes des autres, elles ont en commun de refléter les étonnantes compétences du langage chez les humains, et en cela, elles sont toutes égales. De plus, la diversité des langues est l’image d’une diversité des cultures du monde, d’une richesse de l’humanité répandue aux quatre coins de notre planète. Nous sommes à une époque où la mondialisation tend à réduire cette diversité, et à mettre de nombreuses langues en voie d’extinction, un peu comme les espèces vivantes, animales et végétales, de la nature. Il est urgent de préserver cette diversité, et de peut-être rejeter l’idéal biblique d’une langue « unique et universelle ». Après tout, nous sommes aussi très forts en traduction !

Si toi aussi tu as une question, demande à tes parents d’envoyer un mail à : tcjunior@theconversation.fr. Nous trouverons un·e scientifique pour te répondre.![]()

Cameron Morin, Doctorant en linguistique, Université de Paris

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Arbeiten mit dem Computer...

![]() Par

blatt-christophe

Le 24/08/2021

Par

blatt-christophe

Le 24/08/2021

Arbeiten mit dem Computer... muss man lernen. Internet und Informatik schaffen neue Möglichleiten, aber gleichzeitig braucht man neue Kompetenzen. Die Frage stellt sich: was sollen wir denn noch alles lernen? Kommen denn immer neue Programme und Prüfungen hinzu?

Wie kann man darum den Computer nutzen, um die Arbeit schneller und besser, einfacher zu organisieren?

-- Das wollen wir auch in der Schule lernen.

Débat : Pourquoi le numérique doit s’apprendre à l’école

La crise sanitaire a été un révélateur de l’état de l’école. Le numérique, longtemps aux marges des préoccupations des institutions éducatives, a montré son importance pour le maintien d’une relation pédagogique quand l’accès aux salles de classe n’est plus possible.

Très marginale au sein de l’enseignement scolaire auparavant, essentiellement réservée aux enfants empêchés (en cas de maladie, d’expatriation familiale), la formation à distance est devenue le cinquième argument d’importance en faveur de la transition numérique de l’école. Elle s’ajoute aux quatre enjeux suivants :

l’efficacité qu’offre le numérique pour certaines activités d’apprentissage ;

l’aide que peuvent apporter les moyens informatiques dans la gestion des parcours d’apprentissage ;

l’apprentissage des sciences du numérique en tant que connaissances académiques ;

enfin, et certainement l’enjeu plus important alors que les réseaux sociaux font partie du quotidien des jeunes, l’éducation citoyenne au numérique.

L’expérience du confinement a eu le mérite d’induire un changement d’échelle dans l’appropriation que les enseignants et leurs élèves ont réalisée du numérique. Pour autant, ce recours contraint aux techniques numériques a également fait apparaître à tous de nombreuses déficiences que les États généraux du numérique, organisés en novembre 2020 par la Direction du numérique pour l’Éducation (DNE), ont relevées.

En réalité, la plupart des enjeux identifiés sont connus de longue date mais restent en suspens en raison d’une politique éducative qui n’a jamais encore donné au numérique la place qu’il devrait y avoir.

L’illusion du concept de « digital natives »

Parmi ces problèmes, il en est un pourtant bien documenté par la recherche depuis une vingtaine d’années, mais encore contre-intuitif à beaucoup. Il s’agit des compétences que les enfants et adolescents ont quant à l’usage des techniques numériques. Aux yeux de beaucoup d’adultes, et en particulier à ceux d’une partie des acteurs de l’école (enseignants, parents d’élèves, décideurs politiques ou responsables institutionnels), les jeunes sont très compétents.

Il faut reconnaître que les pratiques intensives et la dextérité dont la plupart d’entre eux font preuve dans l’utilisation de leurs smartphones nourrissent efficacement une illusion d’expertise. Pour ceux qui les observent, comme pour eux d’ailleurs. Une analyse plus fine de leurs pratiques atteste la réalité de cette expertise mais montre qu’elle se limite aux nécessités techniques de leurs pratiques (utilisation de réseaux sociaux, jeux, entre autres…).

À lire aussi : « In extenso » : Décrypter l’info sur écran, ça s’apprend !

De nombreux témoignages, recueillis dans le cadre de recherches conduites par le laboratoire Techné de l’université de Poitiers durant le confinement, permettent une première identification de compétences de mise en œuvre des techniques numériques, apparemment basiques, qui manquent pourtant aux élèves et font obstacle aux usages scolaires du numérique.

À titre d’exemples, on peut signaler les compétences relatives à l’organisation du stockage des fichiers, celles liées à la manipulation des principaux formats de fichier ou à la maîtrise élémentaire des principales fonctionnalités d’une application d’édition de texte. C’est ainsi que l’on a pu observer des élèves réduits à photographier l’écran de leur ordinateur avec un smartphone pour adresser à leur enseignant le résultat de leur travail, faute d’avoir su l’enregistrer depuis l’application utilisée ou d’avoir su réaliser une copie d’écran.

Ainsi, les compétences numériques des jeunes, essentiellement acquises par l’expérience, ne correspondent pas toujours à celles requises pour une utilisation scolaire. Deux problèmes de formation des jeunes au numérique sont ainsi mis en évidence, aussi importants l’un que l’autre. Le premier concerne l’éducation citoyenne au numérique et le deuxième, plus circonscrit, la formation aux compétences numériques mobilisées à l’École.

Les limites de l’apprentissage par l’expérience

Ce constat milite clairement pour un apprentissage de l’utilisation du numérique à finalité scolaire à l’école. C’est d’autant plus nécessaire quand l’usage des équipements et services numériques par les élèves s’effectue hors de la supervision et de l’accompagnement des enseignants. Ce qui est le cas en situation de confinement.

Aujourd’hui, l’évolution de la quatrième vague pandémique laisse malheureusement craindre que les mesures de restriction d’accès aux locaux scolaires annoncées par le ministre de l’Éducation nationale dans sa circulaire de rentrée ne doivent être activées au long des mois à venir. Certains formulent l’hypothèse que l’expérience acquise par les élèves durant le premier confinement leur a permis de maîtriser l’ensemble des compétences d’utilisation scolaire du numérique. La réalité est autre.

Certaines compétences se construisent relativement aisément dans l’usage, d’autres requièrent le support d’activités d’apprentissage spécifiques. L’utilisation répétée d’une plate-forme de classe virtuelle, par exemple, aura permis à la plupart des élèves d’en découvrir les fonctionnalités principales et de se les approprier. Pour autant, l’instauration de temps de formation explicites permet de progresser plus rapidement, ouvre souvent d’autres perspectives d’utilisation et, surtout, réduit fortement les inégalités face au numérique.

Le développement des compétences numériques par l’expérience trouve ici ses limites. Il semble raisonnable de demander à l’École qu’elle forme systématiquement les élèves aux gestes techniques dont elle attend par ailleurs la maîtrise dans les activités d’apprentissage qu’elle organise. Sinon risquent de se creuser encore les carences éducatives imputables à différents déterminants individuels et sociaux.

L’enjeu des référentiels de compétences

La première initiative institutionnelle marquante pour faire face aux besoins de formation des jeunes au numérique date des années 2000 avec l’instauration du brevet informatique et Internet, décliné depuis l’école élémentaire selon les ordres d’enseignement. Ce dispositif comprenait un référentiel de compétences et des procédures de certification.

Observés par de nombreux chercheurs, ces effets se sont révélés mineurs, faute d’une inscription suffisante des apprentissages dans des activités scolaires appropriées, faute d’une réflexion élaborée sur les problématiques de didactique du numérique, faute d’une formation des enseignants et faute, avant tout, d’une vision claire des objectifs poursuivis.

En 2016, PIX, service public de certification des compétences numériques, est venu relancer la question avec une proposition légèrement différente. Un nouveau référentiel de compétences a été établi, globalement aligné sur le cadre de référence européen des compétences numériques DigComp développé depuis 2013.

Une plate-forme a été développée par une équipe au sein du ministère rapidement instituée en groupement d’intérêt public, pour proposer des activités construites autour du référentiel destinées à la formation, l’évaluation et la certification des compétences distribuées en cinq grands domaines. Élaborée autour d’une logique contributive, la plate-forme s’enrichit progressivement de nouveaux contenus adressés à tous les publics dont ceux de l’enseignement scolaire. En quelques années, elle est devenue une ressource précieuse pour la formation à l’utilisation des techniques numériques.

Aussi incitative soit-elle, cette plate-forme ne saurait pourtant suffire à la mise en œuvre effective de la formation des élèves. C’est pourquoi l’annonce de l’instauration de « parcours PIX » et de la certification des compétences de tous les élèves annoncés par le ministre de l’Éducation dans sa circulaire de rentrée est une bonne nouvelle à condition qu’elle soit assortie des mesures indispensables à sa réalisation. Reste la question des compétences numériques scolaires pour laquelle une réflexion sérieuse s’impose. Avec la même urgence que celle des contraintes sanitaires.

Jean‑François Cerisier sera l’un des invités de la 18e édition de Ludovia, l’Université d’été du numérique éducatif organisée du 23 août au 26 août 2021 à Ax-les-Thermes, et dont certains débats seront retransmis en ligne.![]()

Jean-François Cerisier, Professeur de sciences de l'information et de la communication, Université de Poitiers

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Décrypter l’info sur écran, ça s’apprend !

![]() Par

blatt-christophe

Le 26/02/2021

Par

blatt-christophe

Le 26/02/2021

Internet ist die moderne AGORA.

Wahrheit und Realität müssen erarbeitet werden.

Das ist der Preis der Demokratie.

Décrypter l’info sur écran, ça s’apprend !

Aurélie Djavadi, The Conversation

In extenso, des podcasts en séries pour faire le tour d’un sujet.

Internet, c’est autant une mine d’infos qu’un dédale d’infox, chacun peut le constater au quotidien en naviguant sur les réseaux sociaux. Alors, comment s’y retrouver ? Quels repères transmettre aux jeunes en matière d’éducation aux médias ? Les stratégies qui valaient sur papier ne suffisent plus dans un monde numérique où l’image est reine.

Dans ce troisième et dernier épisode de notre série « Apprendre, la révolution des écrans », Divina Frau-Meigs, professeure en sciences de l’information et de la communication, nous explique comment les modes de lecture se complexifient sur ordinateur, sur smartphone ou sur tablette, quels sont les outils à mobiliser pour prendre conscience de nos biais cognitifs et mieux gérer la profusion de messages qui nous parviennent.

Conception, Aurélie Djavadi. Production, Romain Pollet.![]()

Aurélie Djavadi, Cheffe de rubrique Education, The Conversation

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

ERASMUS... und wie es weiter geht.

![]() Par

blatt-christophe

Le 05/02/2021

Par

blatt-christophe

Le 05/02/2021

BREXIT. Damit ändert sich die Zukunft für Studenten. Aber welche Chancen entstehen gleichzeitig für die Entwicklung der Raumordnung?

Nordirland und Irland erhalten weiterhin den Zugang von Studenten aus der Europäischen Union und damit entstehen neue Zentren für Wissenschaft und Forschung.

-- Welche Folgen hat das für die Raumordnung?

Fin des séjours Erasmus au Royaume-Uni : les étudiants vont-ils payer le prix du Brexit ?

Alessia Lefébure, École des hautes études en santé publique (EHESP)

L’annonce par le Royaume-Uni du retrait du programme de mobilité Erasmus+ a été accueillie avec consternation et émotion dans tous les pays de l’Union européenne.

Parmi les diverses conséquences du Brexit, cette décision a sans doute une portée symbolique plus forte que d’autres tant, dans l’imaginaire collectif, le Royaume-Uni est indissociable des séjours linguistiques et d’études à l’étranger.

Beaucoup de commentateurs ont exprimé de l’inquiétude quant à l’avenir de la mobilité étudiante, dont on dit qu’elle sera plus chère et plus compliquée vers les universités britanniques.

Le Premier ministre Boris Johnson justifie sa décision par le besoin de réaliser une économie budgétaire en supprimant le coût d’adhésion à un dispositif dont les étudiants britanniques bénéficient peu.

Pourtant, les représentants du monde académique anglais tirent depuis des mois la sonnette d’alarme quant à l’impact économique de la baisse anticipée du nombre d’étudiants européens inscrits, qui serait de 57 % dès la première année selon le think tank HEPI. Le manque à gagner net pour le pays s’estimerait, d’après le groupement d’intérêt University UK, à 243 millions de livres sterling par an.

Vers une destination de niche

Ces estimations se fondent sur l’hypothèse que l’arrêt des bourses Erasmus + donnera un coup d’arrêt de la mobilité vers les universités du Royaume-Uni. En effet, Erasmus – devenu Erasmus+ en 2014 – est un dispositif créé en 1987 précisément pour encourager la circulation des étudiants dans l’espace européen.

En trente-trois ans d’existence, ce programme s’est élargi géographiquement, passant des 11 pays fondateurs (dont le Royaume-Uni) à 34 membres en 2020, incluant des pays qui, comme la Turquie ou l’Islande, ne font pas partie de l’Union.

Erasmus a également étendu son objet au-delà des séjours d’études (d’une durée comprise entre 6 mois et un an) pour inclure les stages, les apprentissages, les échanges de personnel universitaire. Doté d’un budget annuel de 3 milliards d’euros (chiffre 2019), soit près de 1,5 % du budget de l’Union européenne, le dispositif repose sur l’attribution de bourses aux individus et aux universités, ainsi que sur un mécanisme de validation des crédits, reconnus dans le cadre du diplôme dans le pays d’origine.

Plus récemment Erasmus+ a servi à promouvoir l’enseignement et la recherche sur des sujets liés à l’UE, mais aussi à soutenir les doubles diplômes et les formations européennes intégrées dans le cadre de partenariats stratégiques, visant à faire de l’espace économique européen une zone d’attraction des talents du monde entier.

On pourrait se demander si, au lieu de s’arrêter, cette mobilité ne changera pas simplement de bénéficiaires. Aux étudiants boursiers Erasmus se substitueront autant d’étudiants autofinancés, qu’ils soient en provenance de la zone Erasmus + ou plus largement du reste du monde.

De fait, quand on regarde de près la mobilité actuelle, il est légitime de se demander si la fin de la mobilité Erasmus sera réellement la catastrophe annoncée pour l’industrie de l’enseignement supérieur britannique. En nombres absolus, selon les données de l’Unesco, les quatre premiers pays d’origine de ses étudiants internationaux sont la Chine, l’Inde, les États-Unis et Hongkong, loin devant les pays de l’Union européenne. Sa mobilité entrante dépend donc relativement peu de sa participation à Erasmus.

Quant à la mobilité sortante, les étudiants britanniques ont la particularité – commune à beaucoup de pays anglophones – d’être peu nombreux à partir à l’étranger pour leurs études. Les étudiants en mobilité représentent 0,7 % du total de la population étudiante. Le taux net de flux des étudiants en mobilité, c’est-à-dire le rapport entre le nombre des étudiants entrants et sortants, est de 16,74%, l’un des plus élevés de la zone Europe, indiquant par là le fort déséquilibre entre les deux flux (par comparaison ce taux est de 4,9 pour la France).

De plus, lorsqu’ils partent, les étudiants britanniques choisissent massivement une destination hors périmètre Erasmus, à savoir les États-Unis qui accueillent à eux seuls plus de 10.000 étudiants britanniques par an, soit un gros tiers de la mobilité sortante. En cumulé, les pays membres de l’UE en accueillent 17.000 par an.

Un « soft power » menacé ?

Alors, que change vraiment cette décision de « sortie » d’Erasmus ? Outre les aspects symboliques déjà évoqués, elle est porteuse d’un fort message politique adressé aux autres pays européens. Renoncer à Erasmus c’est renoncer au projet de ses fondateurs, à savoir la création d’une identité commune et partagée, au service de la construction européenne et de la vision de paix des origines.

Paradoxalement, le grand perdant de ce choix de retrait d’Erasmus pourrait être le Royaume-Uni lui-même, plus que les étudiants européens qui se tourneront vers d’autres destinations anglophones – notamment l’Irlande et l’Irlande du Nord – ou continueront d’aller au Royaume-Uni s’ils en ont les moyens.

À lire aussi : Etudiants : le programme Erasmus a-t-il démocratisé les séjours à l’étranger ?

Sans bénéficier du programme Erasmus, une année d’études au Royaume-Uni coûte en moyenne entre 10 000 € et 20 000 €, pour certaines filières encore plus, auxquels s’ajoutent les frais de visa, de logement, de couverture médicale. D’autres bourses existent mais elles sont sélectives et réservées aux meilleurs candidats et qui ont déjà un excellent niveau d’anglais certifié par un test tel que l’IELTS. Le pays, qui en 2019 a accueilli près de 143 000 étudiants en provenance de l’Union européenne, pourrait vouloir devenir une destination de niche, réservée aux plus fortunés.

En se privant du flux entrant des boursiers Erasmus+, le Royaume-Uni risque à long terme de perdre l’un de moteurs les plus puissants de son soft power. Boris Johnson l’a souvent rappelé : son pays est un contributeur net d’Erasmus (tout comme l’Irlande, l’Espagne, le Portugal, les pays scandinaves, les Pays-Bas, la Belgique ou l’Autriche). A la différence de l’Italie ou de la France, il accueille donc plus d’étudiants qu’il n’en envoie, signe du succès et de la capacité d’attraction de ses universités.

Ouverte à tous les étudiants du supérieur, à partir de la 2e année jusqu’au doctorat inclus, la mobilité Erasmus intervient généralement au cours du premier cycle d’études. Constituant souvent le première étape d’un parcours international, elle influence les choix ultérieurs. Ainsi, depuis plus de trente ans, de nombreux étudiants ayant goûté au système éducatif d’outre-Manche grâce à Erasmus y reviennent ensuite à leur frais ou avec d’autres bourses pour poursuivre les études en master ou doctorat.

L’influence des établissements britanniques risque de pâtir aussi de l’arrêt de la mobilité des personnels enseignants et administratifs, et surtout de leur éloignement progressif des divers consortiums, coalitions et groupements d’universités européennes qui se constituent de plus en plus nombreux pour bénéficier des financements de recherche européens.

Le Royaume-Uni parie sur sa capacité à maintenir son excellence et son influence mondiale par ses propres moyens, suivant sans doute le modèle des États-Unis. Avec un financement public qui se réduit constamment depuis le début des années 2000 (Marginson, 2018), le pays ne dispose toutefois pas du même potentiel offert par la philanthropie privée qui permet aujourd’hui aux grandes universités américaines d’entretenir leur prééminence par des bourses, des chaires, des postdocs et des programmes de recherche.![]()

Alessia Lefébure, Directrice des études, sociologue des organisations, École des hautes études en santé publique (EHESP)

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Erasmus... plus!

![]() Par

blatt-christophe

Le 27/12/2020

Par

blatt-christophe

Le 27/12/2020

Einen Austausch machen, eine Ausbildung, ein Studium in einem anderen Land machen?

Eine neue, andere Kultur kennen lernen und gleichzeitig neue Freunde finden?

Das ERASMUS-Programm der Europäischen Union bietet diese Möglichkeiten.

Aber ist ein Austausch tatsächlich eine gute Idee, um meinen Beruf und meine Tätigkeit im Berufsleben vorzubereiten?

Alle Arbeit ist Zusammenarbeit und die Europäische Union ist ein Beispiel für den Erfolg von Zusammenarbeit zur Erarbeitung von Frieden und Wirtschaftsentwicklung.

Und die gegenwärtige Krise? Die soziale Krise, die wohl auf die COVID-Krise folgen kann?

Brauchen wir mehr Austausch und internationale Zusammenarbeit oder sollten wir doch besser alle zunächst alle in unseren Regionen, Ländern und Landschaften bleiben?

Alle Arbeit ist... Zusammenarbeit.

Wir brauchen darum mehr Europa, mehr Austausch und eine verstärkte internationale Zusammenarbeit.

Wir brauchen ERASMUS + .

Etudiants : le programme Erasmus a-t-il démocratisé les séjours à l’étranger ?

Alessia Lefébure, École des hautes études en santé publique (EHESP)

Le 21 mars 2019, le rapport annuel de l’agence européenne Erasmus+ a présenté le bilan du célèbre programme européen d’échanges étudiants en faisant apparaître une augmentation du nombre de bénéficiaires (+33 % entre 2014 et 2017 pour la mobilité sortante depuis la France) ainsi qu’une « démocratisation » sociale du dispositif, désormais ouvert aux étudiants en formation professionnelle et en stage.

Si, depuis la création d’Erasmus, le nombre de candidats n’a cessé d’augmenter, l’Union européenne affiche de façon de plus en plus volontariste l’objectif de permettre à un plus grand nombre encore de jeunes de bénéficier d’une mobilité internationale au cours de leur formation. En mai dernier, la Commission européenne a proposé d’ajouter au budget de l’UE 2019 une enveloppe supplémentaire de 20 millions d’euros pour Erasmus+.

À lire aussi : Erasmus : 30 ans de succès, et ensuite ?

En France, l’augmentation des bourses de mobilité Erasmus figurait dans le programme de quasiment toutes les listes créditées de plus de 5 % d’intentions de vote aux élections européennes du 26 mai 2019 : La France insoumise, Républicains, LREM, Parti socialiste et Place publique. Pourquoi cette mobilité intra-européenne demeure-t-elle si importante et consensuelle ?

Objectif politique

Erasmus est le nom d’un programme d’aide à la mobilité étudiante mis en place par la Commission européenne en 1987. C’est à la fois l’acronyme de son nom officiel (« European Community Action Schema for the Mobility of University Students ») et l’hommage à une grande figure de l’humanisme européen du XVIe siècle, Érasme de Rotterdam, qui, par son ouverture d’esprit, sa maîtrise des langues et des savoirs, ses innombrables voyages d’étude fut surnommé « le précepteur de l’Europe ».

À l’époque de la création du programme, l’objectif est éminemment politique. Il s’agit, par un système de bourses et par un mécanisme d’équivalences entre les cursus, d’encourager les étudiants d’un pays membre de l’UE à partir effectuer un séjour dans une université d’un autre pays membre. Objectif : la constitution d’une identité commune européenne.

À l’instar d’Érasme, les fondateurs du programme comptent sur les vertus de la rencontre inter-culturelle et du décentrage pour renforcer les liens et les capacités de dialogue entre jeunes européens, conjurant ainsi intolérance et conflits. Initialement limité à 11 pays participants (Allemagne, Belgique, Danemark, Espagne, France, Grèce, Irlande, Italie, Pays-Bas, Portugal et Royaume-Uni) et progressivement élargi aux universités de 34 pays, ce programme a permis en 32 ans à 4,4 millions d’étudiants d’effectuer une mobilité intra-européenne.

Ce nombre ne représente toutefois qu’un très faible pourcentage du groupe cible (environ 1 % de la population étudiante). Car, en dépit de son immense popularité, Erasmus s’est révélé décevant par rapport aux objectifs attendus. De nombreuses études réalisées auprès des bénéficiaires du programme en ont démontré le caractère élitiste.

Outil de distinction

Erasmus est certes formellement ouvert à tous, l’attribution de bourses, devant lever les freins économiques. Les recherches conduites par la sociologue Magali Ballatore auprès des étudiants de trois universités (Bristol, Turin et Aix-Marseille) ont pourtant mis en évidence que des obstacles persistent lorsque les parents sont issus des catégories socio-professionnelles les moins favorisées et les moins éduquées.

À lire aussi : Faire un séjour Erasmus… Et après ?

Les inégalités socio-économiques entraînent en effet dès le plus jeune âge de fortes inégalités dans le parcours scolaire. L’exposition linguistique, l’acquisition de compétences que Magali Ballatore appelle « migratoires », expliquant ainsi la sur-représentation parmi les étudiants Eramsus des jeunes issus de milieux aisés et éduqués. S’y ajoutent les inégalités d’accès à certaines filières en fonction de leur prestige, de leur classement et de la réputation du système éducatif du pays visé.

Ainsi, la mobilité Erasmus, pensée et conçue pour tous, peut paradoxalement renforcer les clivages socio-culturels lorsqu’elle est l’instrument de stratégies de distinction des élites. Pour les jeunes déjà dotés d’un important capital socio-culturel, l’expérience Erasmus contribue avant tout à renforcer ce qui est de l’ordre du savoir-être dans un contexte international, puisque l’acquisition des connaissances académiques ou linguistiques a déjà eu lieu.

Dans la ligne de ces recherches, une étude récente conduite dans les grandes écoles d’ingénieurs françaises, à partir des enquêtes annuelles sur la mobilité internationale effectuées par la Conférence des grandes écoles (CGE), a confirmé que les inégalités d’origine conditionnent les opportunités internationales des élèves-ingénieurs.

Puisque l’expérience internationale est devenue une ressource essentielle et distinctive dans tous les secteurs d’activité, la compétition pour les séjours les plus valorisants (longs, diplômants, auprès des universités les plus prestigieuses) se joue au profit des élèves issus de milieux favorisés, leur donnant ainsi un atout supplémentaire lors de l’accès au marché du travail.

Compétitivité européenne

Le discours sur la nécessaire démocratisation de la mobilité émerge et s’impose progressivement avec le passage d’Erasmus à Erasmus+ en 2014, symboliquement marqué par l’ouverture du programme à la formation professionnelle, aux stages et aux personnels enseignants et administratifs des universités.

C’est un changement qui s’inscrit dans le contexte actuel européen, caractérisé par un fort mécontentent social, la perte de confiance des populations dans leurs institutions, la déconnexion entre les élites administrativo-politiques et les électeurs, le besoin de « démocratisation » de toutes les politiques publiques.

Mais le changement de nom va de pair avec un changement d’objectif car le paysage de l’enseignement supérieur a sensiblement évolué en trente ans. Le but initial qui était de forger une culture et une identité européenne par l’augmentation de la circulation des étudiants entre pays membres semble aujourd’hui secondaire.