- Accueil

- Blog

Blog

![]() Par

blatt-christophe

Le 16/08/2021

Par

blatt-christophe

Le 16/08/2021

Bilder sind Fenster!

Sie zeigen eine andere Zeit und eine andere Welt. Gleichzeitig bilden sie eine Brücke zwischen Generationen und Kulturen. Ein Kunstmuseum... ist einen Besuch wert.

La véritable invention de Jan van Eyck : une machine à représenter l’espace tel que nous le percevons

Gilles Simon, Université de Lorraine

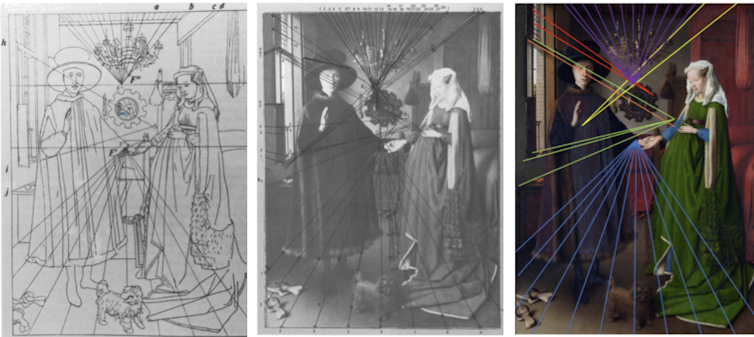

Jan van Eyck (c. 1390-1441) aura mis à rude épreuve les historiens de l’art soucieux de trouver une cohérence géométrique à sa manière de représenter l’espace. L’affaire semblait pourtant entendue dès 1905 : cette année-là, Karl Doehlemann démontrait dans un journal de mathématiques que les lignes fuyantes des Époux Arnolfini ne convergent pas vers un point de fuite unique, comme cela devrait être le cas dans une perspective linéaire, mais vers une zone circulaire de points de fuite : Jan était un expérimentateur dont les « essais-erreurs » ont conduit de la perspective parallèle médiévale à une sorte de perspective empirique, décisivement différente de la solution mathématiquement correcte de Petrus Christus. L’interprétation de Doehlemann est aujourd’hui encore communément acceptée, mais une sorte de doute bergsonien a conduit en leur temps une poignée d’historiens de l’art à chercher un ordre caché derrière le désordre apparent des points de fuite des Époux.

Malheureusement, nous savons depuis Popper que toute activité d’observation est en proie au préjugé, et la nature même du désordre (nombre et positions des points de fuite à considérer) n’a pu faire l’objet d’un consensus.

La solitude de James Elkins

Dans un article publié en 1991 dans la revue The Art Bulletin, l’historien d’art James Elkins déplore un manque d’objectivité et de reproductibilité dans les reconstructions de points de fuite consacrées aux Époux Arnolfini et entrevoit une échappatoire dans les méthodes informatiques naissantes « telles que la méthode des moindres carrés ». Il semble malheureusement qu’Elkins n’ait pas été entendu par les informaticiens spécialistes de vision par ordinateur dont il serait étonnant qu’un seul ait lu son article. La détection automatique de points de fuite a pourtant connu d’importants progrès depuis les années 90. Mais une peinture présente des difficultés propres, dont les algorithmes actuels, essentiellement conçus pour traiter des photographies, ne tiennent pas compte : les fuyantes sont souvent plus limitées en nombre que dans une photographie, et leur représentation par le peintre ou leur extraction par le chercheur peuvent manquer de précision. Aussi les œuvres graphiques ne font-elles pas partie des bancs d’essai habituels de la communauté vision.

Une méthode probabiliste adaptée aux œuvres graphiques

Notre étude, présentée à SIGGRAPH en août 2021 et publiée dans la revue ACM in Computer Graphics and Interactive Techniques, tient compte de l’incertitude inhérente à la connaissance des fuyantes et adopte un raisonnement probabiliste a contrario.

Bien connues en vision par ordinateur, les méthodes a contrario sont inspirées de la théorie psychologique de la forme, et en particulier du principe de Helmholtz qui stipule que « nous percevons immédiatement [traduction mathématique : l’algorithme détectera] ce qui ne peut pas être dû au hasard ».

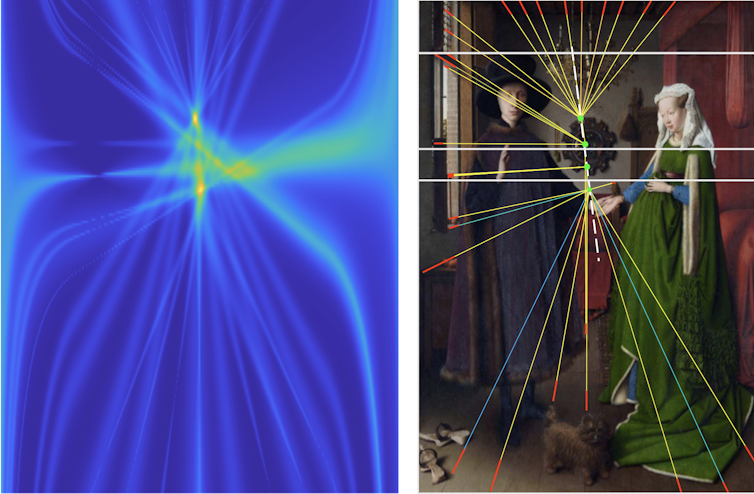

En appliquant le principe de Helmholtz à la carte probabiliste des points de fuite des Époux Arnolfini, nous obtenons une structure étonnamment ordonnée : quatre points principaux alignés périodiquement le long d’un axe vertical légèrement incliné. Et des structures similaires sont obtenues dans d’autres tableaux de Jan van Eyck : Saint Jérôme dans son étude, La Vierge de Lucques, La Vierge de Dresde et La Vierge dans une église. Chacun de ces tableaux peut être partitionné en autant de bandes horizontales qu’il y a de points de fuite, chaque bande regroupant l’ensemble des arêtes associées au même point : les perspectives de Jan sont rigoureusement exactes, par morceaux.

Une précision diabolique

Le cas de la Vierge dans une église est particulièrement intéressant. Dans ce tableau presque aussi petit qu’une miniature (14 x 31 cm), la précision des traits au regard de leur convergence est extrême.

Mais le plus étonnant est que les positions des points de fuite obtenus dans la bande supérieure du tableau sont parfaitement cohérentes avec la géométrie en demi-décagone du chœur de l’église. Cela est inattendu, car personne ne pouvait savoir à cette époque comment placer un point de fuite sur la ligne d’horizon en fonction de sa direction dans l’espace tridimensionnel. La seule explication possible est que Jan utilisait un dispositif optique à travers lequel il représentait l’espace, en superposant méticuleusement ses traits à la réalité.

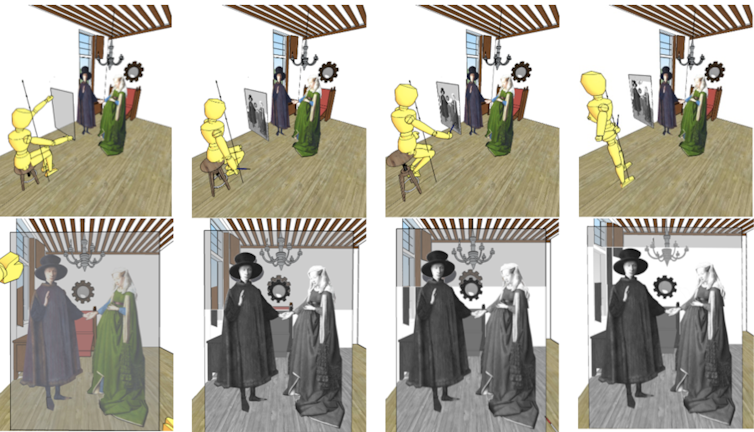

Une « machine à perspective » des plus avant-gardistes

Près d’un demi-siècle après la mort de Jan, Léonard de Vinci dessinera une version simplifiée de cette « machine à perspective ».

Dans le dessin de Léonard, le peintre détoure les objets visibles à travers une vitre, le regard immobilisé derrière un œilleton. Plus élaboré, le dispositif de Jan comportait quatre œilletons répartis équitablement (à l’instar des points de fuite) le long d’un axe de visée incliné. Jan peignait son tableau bande après bande (œilleton après œilleton) de bas en haut ou de haut en bas. La vitre – probablement un miroir – pouvait elle-même être déplacée dans son plan, afin de raccorder au mieux, compte tenu de la parallaxe, le bord de la bande précédemment dessinée à la réalité perçue depuis l’œilleton suivant.

Cette étape cruciale permettait au peintre d’obtenir des transitions douces entre les bandes, difficilement décelables à l’œil nu. De surcroît, elle anticipait de plusieurs siècles le principe de la réalité augmentée.

Au plus près de la perception humaine

Notre reconstruction de l’exécution du portrait des Arnolfini permet de voir ce que Jan lui-même voyait à travers les œilletons, et d’observer par exemple la montée du plafond entre la vue du bas et celle du haut finalement retenue pour le plafond (et inversement pour le sol) : Jan semble avoir été soucieux d’éviter les « déformations latérales ».

L’amplification des déformations perspectives sur les bords du tableau n’est pas incorrecte du point de vue de l’optique, mais nous n’y sommes pas habitués parce que le champ visuel de l’œil humain est plus réduit que celui atteint dans une perspective artificielle à courte distance, ou à travers une vitre lorsque le peintre s’autorise à rouler des yeux et à se contorsionner pour élargir son champ visuel immédiat. Il est probable que Jan ne se satisfaisait pas de ces effets inhabituels, et qu’il ait préféré peindre à l’état naturel de repos les objets situés en face de lui, quitte à relever son tabouret en cours d’exécution et à terminer debout pour atteindre l’ensemble de l’espace visible.

Introduction de la vision binoculaire

L’inclinaison de l’axe de visée n’a sans doute pas été laissée au hasard, dans la mesure où elle était évidente à l’œil nu et compliquait le raccordement des bandes. Pour le portrait des Arnolfini, la distance horizontale entre les œilletons situés aux extrémités de l’axe de visée était égale à la distance interpupillaire d’un homme adulte (d’où cette impression de voir un anaglyphe dans la réflectographie infrarouge des Époux). Chacun décidera s’il s’agit d’une coïncidence, mais l’auteur de ces lignes parierait que non. Il imagine Jan fermant alternativement l’œil gauche et l’œil droit, observant les effets de cette action sur la perception de sa propre main et décidant de doter son dispositif des deux options.

Des chercheurs de la National Gallery ont souligné, à propos du portrait des Arnolfini, combien la représentation des mains et des pieds était importante à cette époque, à la fois sur le plan symbolique et esthétique. Si la plupart des objets présents dans le tableau n’ont été dessinés qu’une seule fois depuis l’œilleton le plus frontal, la main levée et les pieds de Giovanni Arnolfini ont été redessinés depuis d’autres œilletons. Les deux dessins de la main et les trois dessins des pieds sont décalés spatialement en raison de la parallaxe, mais les subtils raccords de Jan permettaient qu’ils ne le soient pas trop. Ce dernier pouvait donc retenir, au moment de peindre, l’une ou l’autre des déclinaisons.

Genèse du tableau

Les autres parties du corps de Giovanni ont également été dessinées plusieurs fois, et le partitionnement du tableau en bandes d’épaisseurs différentes suggère que Jan a focalisé son attention sur quatre régions d’intérêt : le plafond, la tête coiffée de Giovanni, sa main levée et le bas du corps. Un soin particulier semble donc avoir été apporté au portrait du commanditaire, plus encore qu’au cadre architectural. Et ainsi, le dispositif polyscopique de Jan pourrait bien être le fruit de l’évolution d’un dispositif monoscopique (équivalent à celui dessiné par Léonard) concomitante à la nécessité de réaliser un portrait en pied (Adam dans le retable de Gand ?) après avoir réalisé des portraits en buste. Il ne s’agit là que d’une première hypothèse, qui mériterait d’être confrontée à d’autres. Encore faudrait-il que notre article ne connaisse pas le même sort que celui d’Elkins.![]()

Gilles Simon, Maître de conférences HDR en informatique, Université de Lorraine

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

![]() Par

blatt-christophe

Le 01/07/2021

Par

blatt-christophe

Le 01/07/2021

Abstention : au-delà de la crise sanitaire, les vraies raisons de la démobilisation

Tristan Haute, Université de LilleLe premier tour des élections départementales et régionales de 2021 a été marqué par une participation historiquement faible : 32,59 % contre 50,17 % au premier tour des élections départementales de mars 2015 et 49,91 % au premier tour des élections régionales de décembre 2015. Ce recul exceptionnel, assez similaire à celui observé entre les élections municipales de 2014 et de 2020 (-19 points), est-il lié au contexte de crise sanitaire ?

Lors du premier tour des élections municipales de 2020, l’abstention était fortement corrélée au risque épidémique.

En juin, ce risque épidémique semble toutefois être un argument bien insuffisant pour expliquer la hausse de l’abstention, une majorité des adultes en âge de voter ayant reçu une première dose de vaccin.

Pas de démobilisation des personnes âgées

Les recherches relatives à l’abstention au premier tour des élections municipales de 2020 ont montré que les écarts de participation selon l’âge des électeurs s’étaient réduits, les personnes âgées, davantage à risque, s’étant davantage démobilisées. Cependant, dimanche dernier, l’écart de participation entre les 18-24 ans et les 65 ans et plus était bien plus important qu’en 2020, passant de 20 points à 31 points et se rapprochant ainsi des écarts de participation observés en 2015 (voir tableau 1).

Entre 2015 et 2020, ce sont les 65 ans et plus qui se sont le plus démobilisés alors que la participation des moins de 35 ans a stagné. Mais le constat est inverse entre 2020 et 2021 : les personnes âgées de 65 ans et plus se sont quasiment autant mobilisées (-3 points) alors que la participation décline fortement dans toutes les autres classes d’âge (entre – 13 et -17 points). Ce résultat peut expliquer les relatives contre-performances de la gauche et des écologistes dans certaines régions, ces partis ayant des bases électorales significativement plus jeunes.

La démobilisation des personnes âgées en 2020 et la réduction des inégalités de participation selon l’âge ne semblent donc avoir été qu’un épiphénomène lié au risque élevé, pour les personnes âgées en particulier, de développer une forme grave de la maladie. En d’autres termes, l’effet direct du Covid observé en 2020 a disparu en 2021, du fait de la campagne de vaccination et de la moindre circulation du virus.

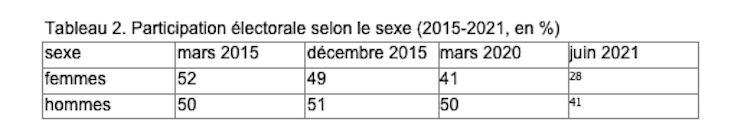

Un nouveau « gender gap » ?

Comme lors des élections municipales de 2020, on constate que les femmes ont moins participé que les hommes en 2021 alors qu’elles s’étaient autant mobilisées que les hommes en 2015 (voir tableau 2). Ce résultat va à rebours des enquêtes réalisées depuis les années 2000 en France.

Une première hypothèse est que les femmes se sont trouvées, davantage que les hommes, à distance de la compétition électorale. En effet, du fait de processus genrés de socialisation, elles ont été plus que les hommes préoccupées par la dimension strictement sanitaire de la crise. De plus, les inégalités de genre, en matière de travail domestique notamment, se sont renforcées durant les confinements successifs.

Une seconde hypothèse est que, la norme participationniste s’affaiblissant, l’intérêt pour la politique et le sentiment de légitimité politique, deux facteurs déjà déterminants en matière de mobilisation électorale, le deviennent de plus en plus.

Or, les femmes restent moins intéressées par la politique et se sentent moins « compétentes » politiquement du fait d’attentes différenciées du champ politique selon le genre et de processus genrés de socialisation politique.

De ce point de vue, le lien avec la crise sanitaire reste donc à préciser.

Tableau 2. Participation électorale selon le sexe (2015-2021, en %)

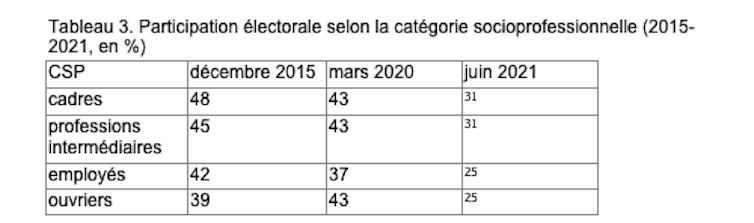

Des inégalités sociales qui persistent

Les inégalités de participation liées au niveau de revenus restent non négligeables : selon l’Ifop, la participation au premier tour des régionales a atteint 22 % au sein des catégories populaires (moins de 900 euros par mois) contre 39 % au sein des catégories supérieurs (plus de 2 500 euros par mois).

De même, comme en 2020, les inégalités liées à la catégorie socioprofessionnelle semblent s’être plutôt maintenues : l’écart de participation entre cadres et ouvriers était de 6 points dimanche dernier contre 9 points en 2015 (voir tableau 3). Ce résultat peut expliquer la bonne « performance » des listes de la droite parlementaire pour laquelle votent massivement les catégories supérieures.

Tableau 3. Participation électorale selon la catégorie socioprofessionnelle (2015-2021, en %)

Des effets sur le temps long

À l’inverse de ce qui avait été observé aux élections municipales de 2020, l’abstention en juin 2021 ne semble donc pas s’expliquer par la crainte de contamination. Alors que la pratique électorale est devenue majoritairement intermittente en France, les effets de la crise sanitaire sont en réalité plus indirects, plus globaux et se jouent sur le temps long.

Ainsi, les candidats ont peiné, en raison du contexte sanitaire, à s’adresser aux électeurs. De même, la parole politique s’est focalisée sur la gestion de la crise sanitaire, limitant fortement l’émergence d’autres enjeux, a fortiori locaux. Enfin, les confinements successifs et le recours massif au télétravail ont induit une réduction des relations sociales. Or, celles-ci sont déterminantes en matière de mobilisation électorale, en particulier au sein des classes populaires.![]()

Tristan Haute, Maître de conférence, Université de Lille

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

![]() Par

blatt-christophe

Le 26/10/2023

Par

blatt-christophe

Le 26/10/2023

Krieg.

Der Krieg in dieser Region ist ein Problem für die Welt, denn aus dieser Region kommen Tradition und Religion, die weltweit Bedeutung haben.

-- Wie kann Frieden entstehen, wenn Gewalt die Beziehungen der Menschen bestimmt?

-- Wie können Konflikt langfristig gelöst werden?

-- Welche Rolle spielt die historische Entwicklung?

Derrière l’attaque du Hamas, le spectre de la guerre de Kippour

Dov Waxman, University of California, Los Angeles

Exactement 50 ans et un jour après avoir été complètement pris au dépourvu par une attaque militaire coordonnée par ses voisins égyptien et syrien, Israël a de nouveau été pris par surprise. Les parallèles sont saisissants et ne relèvent pas seulement de la coïncidence.

Dès l’aube du 7 octobre 2023, les militants du Hamas ont envahi le sud d’Israël par la terre, par la mer et par les airs, et ont tiré des milliers de roquettes à l’intérieur du pays. En quelques heures, des centaines d’Israéliens ont été tués, des otages ont été capturés et la guerre a été déclarée. Des représailles israéliennes féroces ont d’ailleurs déjà coûté la vie à des centaines de Palestiniens à Gaza.

Le premier ministre israélien Benyamin Nétanyahou n’a pas attendu 24 heures après les premières attaques pour déclarer que son pays était en guerre, alors que le décompte des morts israéliens continuait d’augmenter. Tout comme il y a 50 ans.

Et ce ne sont pas là les seuls éléments de comparaison.

Des attaques-surprises lors de jours saints

Ces deux guerres ont commencé par des attaques-surprises lors de jours saints juifs. En 1973, c’était le Yom Kippour, jour d’expiation pour les Juifs. Ce 7 octobre 2023, des milliers d’Israéliens célébraient Sim’hat Torah, dédiée à la célébration de la lecture de la Torah.

Le Hamas, le groupe armé palestinien qui contrôle la bande de Gaza, territoire densément peuplée qui jouxte Israël, espère apparemment envoyer le même message que l’Égypte et la Syrie en octobre 1973 : ils n’accepteront pas le statu quo et la puissance militaire d’Israël ne garantira pas la sécurité des Israéliens.

La guerre de 1973 s’est avérée être un moment décisif non seulement dans le conflit israélo-arabe, mais aussi pour la politique d’Israël.

En sera-t-il de même pour cette guerre ?

Un échec colossal des services de renseignements

Il est certain que le déclenchement soudain de la guerre a de nouveau laissé les Israéliens profondément sous le choc, tout comme il y a 50 ans. Cette guerre, comme celle de 1973, est déjà présentée comme un échec colossal des services de renseignement.

Bien que les services de renseignements militaires israéliens aient prévenu le gouvernement que les ennemis du pays croyaient Israël vulnérable, ils ne s’attendaient pas à ce que le Hamas attaque à ce moment-là.

Les services pensaient plutôt que, dans le contexte présent, le Hamas souhaitait avant tout gouverner la bande de Gaza et non déclencher une guerre avec Israël.

Une hypothèse soutenue par l’idée que le Hamas aurait tout à craindre d’importantes représailles de la part d’Israël, qui provoqueraient indéniablement de nombreux dommages à Gaza. Le territoire, qui abrite 2 millions de Palestiniens, dont beaucoup vivent dans la pauvreté, ne s’est toujours pas remis de la dernière grande série de combats, en mai 2021.

Les services de renseignement et de nombreux analystes pensaient également que le Hamas préférait exporter la violence palestinienne vers la Cisjordanie occupée par Israël, afin de contribuer à saper le peu de pouvoir d’une Autorité palestinienne déjà faible et impopulaire, dirigée par le Fatah, rival politique du Hamas.

Ces postulats se sont révélés terriblement erronés, tout comme l’étaient les évaluations des renseignements avant le déclenchement de la guerre de 1973. À l’époque, comme aujourd’hui, les adversaires d’Israël n’ont pas été dissuadés par sa supériorité militaire.

Échec militaire

Les services de renseignement israéliens ont non seulement mal évalué la volonté de leurs adversaires d’entrer en guerre, mais ils n’ont pas non plus réussi – en 1973 comme aujourd’hui – à identifier les éléments qui signalaient les préparatifs d’une offensive.

Cette fois-ci, l’échec est encore plus flagrant, compte tenu des capacités de collecte de renseignements d’Israël. Le Hamas a dû planifier soigneusement cette attaque pendant de nombreux mois. Il s’agit sans aucun doute du pire échec d’Israël en matière de renseignement depuis la guerre de 1973.

Échec des renseignements, mais aussi échec des militaires, les Forces de défense israéliennes étant massivement déployées en Cisjordanie et manifestement pas préparées à une attaque de cette ampleur du côté de Gaza.

Les hauts gradés de l’armée avaient certes averti Nétanyahou à plusieurs reprises que la réactivité des forces armées avait été diminuée par la vague de réservistes israéliens refusant de servir en signe de protestation contre la tentative de réforme judiciaire du gouvernement. Mais les militaires restaient convaincus que leurs fortifications défensives – en particulier la coûteuse barrière de haute technologie construite autour de la bande de Gaza – empêcheraient les militants du Hamas de pénétrer en Israël, comme cela avait été le cas lors d’un raid en mai 2021.

Mais tout comme la ligne de défense Bar-Lev le long du canal de Suez n’a pas réussi à empêcher les soldats égyptiens de traverser le canal en 1973, la barrière de Gaza n’a pas arrêté les militants du Hamas. Elle a été simplement contournée et détruite au bulldozer.

[Plus de 85 000 lecteurs font confiance aux newsletters de The Conversation pour mieux comprendre les grands enjeux du monde. Abonnez-vous aujourd’hui]

La quête d’un responsable

Après cette guerre, des enquêtes seront sans aucun doute menées afin de déterminer un responsable, après la guerre de 1973. Une commission d’enquête sera probablement créée en Israël, similaire à la commission Agranat de 1973 qui a publié un rapport cinglant, pointant du doigt la responsabilité de l’armée et des services de renseignement israéliens.

Mais concernant cette guerre qui débute, ce ne sont peut-être pas l’armée et le renseignement d’Israël qui sont les plus à blâmer. Si l’on pointe la responsabilité politique, Benyamin Nétanyahou serait potentiellement dans le viseur, lui qui dirige le pays depuis 2009, à l’exception d’une année entre 2021 et 2022.

De fait, la guerre de 1973 était également le fruit d’échecs politiques. Israël, alors gouverné par la première ministre Golda Meir et influencé par son ministre de la Défense Moshe Dayan, avait refusé, dans les années qui ont précédé la guerre, les ouvertures diplomatiques du président égyptien Anouar El Sadate. Le gouvernement israélien était alors déterminé à conserver certaines parties de la péninsule du Sinaï – qu’Israël avait capturée lors de la guerre de 1967 – même au prix de la paix avec l’Égypte.

De la même manière, Nétanyahou a ignoré les efforts récents de l’Égypte visant à négocier une trêve à long terme entre Israël, le Hamas, et le Djihad islamique. L’actuel gouvernement d’extrême droite a préféré conserver la Cisjordanie occupée plutôt que de rechercher la possibilité d’une paix avec les Palestiniens.

En outre, le gouvernement Nétanyahou a été largement préoccupé par sa tentative, fort impopulaire, de réduire le pouvoir et l’indépendance de la Cour suprême d’Israël. Une démarche apparemment destinée à éliminer un obstacle potentiel à l’annexion formelle de la Cisjordanie. Mais l’agitation intérieure et les profondes divisions provoquées par ce projet de réforme permettent d’expliquer en partie pourquoi le Hamas a décidé d’attaquer au moment où il l’a fait.

De manière plus générale, l’attaque montre clairement que la stratégie de Nétanyahou visant à contenir et à dissuader le Hamas a échoué de manière catastrophique. Un échec aux conséquences dramatiques pour les Israéliens, en particulier ceux qui vivent dans le sud du pays, et plus encore pour les civils palestiniens de Gaza.

Le blocus continu de Gaza depuis 16 ans a certes paralysé son économie et emprisonné de fait ses 2 millions d’habitants, mais n’a pas mis le Hamas à genoux.

Au contraire, le contrôle du Hamas sur Gaza n’a fait que se renforcer, et des civils innocents des deux côtés de la frontière ont payé le prix fort pour cet échec.

À la suite de la guerre de 1973, la première ministre Golda Meir a été contrainte de démissionner. Quelques années plus tard, le parti travailliste, qui avait été au pouvoir, sous diverses formes, depuis la fondation du pays en 1948, fut battu par le parti de droite Likoud de Menachem Begin lors des élections générales de 1977. Ce fut un tournant dans la politique intérieure israélienne, qui s’explique en grande partie par la perte de confiance envers le parti travailliste (jusqu’alors dominant) suite à la guerre de 1973.

L’histoire se répétera-t-elle encore ?

L’histoire se répétera-t-elle encore ? Cette guerre sonnera-t-elle enfin le glas de la longue domination de Nétanyahou et du Likoud sur la politique israélienne ? La plupart des Israéliens se sont déjà retournés contre le premier ministre, rebutés par l’ensemble des scandales de corruption qui l’entourent, par ses tentatives de réduire le pouvoir du système judiciaire et par le virage à droite opéré par sa coalition.

L’attaque-surprise du Hamas a mis à mal l’image de Nétanyahou, qui se présente volontiers comme le « Monsieur Sécurité » d’Israël.

Cette guerre sera probablement encore plus traumatisante pour les Israéliens car en 1973, les militaires avaient subi toute la force de l’assaut surprise. Cette fois-ci, ce sont des civils qui ont été capturés et tués sur le territoire national. Un point crucial qui marque une différence capitale avec la guerre de 1973.![]()

Dov Waxman, Rosalinde and Arthur Gilbert Foundation Professor of Israel Studies, University of California, Los Angeles

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Chancengleichheit: gleiche Chancen?

![]() Par

blatt-christophe

Le 15/04/2023

Par

blatt-christophe

Le 15/04/2023

Schule ist ein Teil der demokratischen Gesellschaft und gleiche Chancen sind die Grundlage der Gleichheit vor dem Gesetz..

Aber welche Probleme entstehen?

KI: Künstliche Intelligenz und die Vielfalt von Sprachen und Akzenten.

![]() Par

blatt-christophe

Le 16/01/2023

Par

blatt-christophe

Le 16/01/2023

Wir sprechen. Und wir sprechen nicht alle gleich. Und selbst unsere "Muttersprache", unsere "erste" Sprache, die Sprache die wir als unsere Heimatsprache verstehen, selbst diese Sprache zeigt unsere Herkunft und Geschichte.

Wir haben einen... Akzent oder nicht?

Was nun, wenn man die individuelle Sprachform nicht länger besitzen soll? Wenn die Einheitssprache, die Standardsprache, die Normsprache also alle anderen Varianten ausradiert? Wenn der Computer und die KI eine neue, gleichförmige Sprachnorm erst vorstellt, dann allen Sprechern aufzwingt?

Was ist Sprache? Was ein Akzent? was verstehen Und sich noch verstehen können?

Quand les IA s’attaquent à nos accents

Grégory Miras, Université de Lorraine

Juin 2022, l’entreprise SANAS annonce avoir récolté 32 millions de dollars pour la création d’une technologie basée sur l’intelligence artificielle dont l’objectif est de supprimer les accents. Septembre 2022, la plate-forme voit le jour non sans créer intérêt, curiosité et émoi tant dans le monde anglophone que francophone.

De tels logiciels nous plongent dans une dystopie contemporaine où la technologie vient faire disparaître les différences, les marqueurs de l’identité et les cultures des individus. Cette idée n’est pourtant pas nouvelle : le film « Sorry to bother you » sorti en 2018 abordait déjà la question de l’accent des populations africaines-américaines dans une satire sur les centres d’appel.

Alors comment peut-on réellement supprimer un accent ? Entre utopie et dystopie, pourquoi développer une intelligence artificielle capable de « supprimer » les accents peut-il être un problème plus qu’une solution ? Que supprime-t-on de plus qu’une marque sonore en neutralisant un accent ?

Comment l’intelligence artificielle peut faire taire un accent

L’accent peut être défini comme un faisceau d’indices souvent oraux (les voyelles, les consonnes, l’intonation, etc.) qui participe à l’élaboration plus ou moins consciente d’hypothèses sur l’origine géographique, sociale ou langagière des individus. Cet accent peut être dit, entre autres, « régional » ou « étranger » en renvoyant à des imaginaires différents. La pertinence de l’identification d’un accent réside dans le fait qu’un certain nombre de caractéristiques sonores semblent homogènes chez des locuteurs d’une langue, d’une zone géographique ou d’un groupe social, comme le souligne Philippe Boula de Mareüil.

Ces technologies issues de start-up constituent souvent une boite noire et peu d’informations concrètes sur les outils employés pour « supprimer » l’accent sont disponibles. Toutefois, les moyens sont multiples et ils visent principalement à transformer en partie la structure de l’onde sonore afin de rapprocher certains indices acoustiques vers une norme perceptivement déterminée. On pourra ainsi jouer sur le timbre de certaines voyelles, la réalisation de consonnes ou encore transformer des paramètres comme le rythme, l’intonation ou l’accentuation en fonction de cibles perceptives attendues. Dans le même temps, on maintiendra un maximum de paramètres vocaux permettant d’identifier la voix du locuteur initial à l’image du voice cloning pouvant conduire à des arnaques au deepfake vocal. Ces technologies permettent de dissocier ce qui est de l’ordre de la parole de ce qui tient à la voix.

Le traitement automatique et en temps réel de la parole pose des difficultés technologiques dont la principale réside dans la qualité du signal sonore à traiter. Néanmoins, il existe différentes solutions en s’appuyant sur le deep learning et les réseaux de neurones, ainsi que les grands corpus de parole, qui permettent de mieux gérer les incertitudes dans le signal.

[Près de 80 000 lecteurs font confiance à la newsletter de The Conversation pour mieux comprendre les grands enjeux du monde. Abonnez-vous aujourd’hui]

Dans le cas des langues étrangères, Sylvain Detey, Lionel Fontan et Thomas Pellegrini repèrent quelques enjeux inhérents au développement de ces technologies, à savoir quelle norme retenir pour mener une comparaison avec ce qui est attendu, ou encore le rôle que peuvent avoir les corpus dans la détermination de ces objectifs – sans qu’il se dégage pour le moment de réponses particulièrement prometteuses.

Le mythe de l’accent neutre

Cependant, l’identification d’un accent ne se limite pas aux seuls indices acoustiques. Donald L. Rubin a pu démontrer que des auditeurs peuvent recréer l’impression d’un accent perçu simplement en associant aux voix des visages aux origines supposées différentes. De la même manière, en l’absence de ces autres indices, les locuteurs ne sont pas si bons dans leur capacité à reconnaître des accents qu’ils n’entendent pas régulièrement ou qu’ils se représentent de manière stéréotypée, par exemple l’idée selon laquelle il y aurait beaucoup de consonnes en allemand.

Vouloir supprimer les accents pour contrer les effets sociaux d’une discrimination sur l’accent revient à poser la question de ce qu’est un accent « neutre ». Or, toutes les variations de prononciation impliquent des représentations. Médéric Gasquet-Cyrus, « spécialiste du marseillais » selon les médias, rappelle que même l’accent dit « parisien » est un accent. En français, l’accent que l’on qualifie de « standard » a évolué en s’appuyant sur des groupes sociologiquement dominants : haute bourgeoisie parisienne, médias (radio, TV), classes moyennes favorisées par exemple.

Depuis plusieurs années, des chercheurs et chercheuses regroupées dans un collectif tentent de déterminer les contours d’un français de référence en s’appuyant sur les similitudes qui existent entre tous les parlers de la francophonie. Le projet « Phonologie du français contemporain » a ainsi permis de mettre à disposition du grand public des accents à entendre.

Il faut également noter que la valeur que l’on attribue à un accent (fort, doux, romantique, dur) dépend largement des individus, des époques et des groupes sociaux. Toutefois, Iván Fónagy, philologue hongrois, a mis en évidence que les individus ont tendance à attribuer les mêmes propriétés à des sons dans son ouvrage La vive voix : Essais de psychophonétique : le /r/ un son bagarreur, le /i/ comme petit, le /u/ (la graphie « ou ») comme opulent, etc.

Supprimer ou garder, l’œuf ou la poule ?

En sociologie, Wayne Brekhus pose la question de la nécessité de porter un regard sur l’invisible et de traiter en même temps le marqué et le non marqué – l’accent et ce que l’on considère être un non-accent. Cela amène à revoir les rapports de pouvoir qui existent entre les individus et la manière dont on homogénéise le marqué : celui ou celle qui a (selon les autres) un accent.

Aussi, nous sommes amenés à questionner comment les technologies émergentes peuvent nous rendre plus « acteur » ou « actrice » qu’« automate », selon Catherine Pascale, en participant à la création d’un cadre éco-éthique. Supprimer un accent, c’est valoriser un type d’accent dominant tout en négligeant le fait que d’autres co-facteurs participeront à la perception de cet accent tout autant que l’émergence de discriminations sur la langue. Supprimer l’accent ne supprime pas les discriminations. Au contraire, l’accent fait entendre l’identité participant ainsi à des phénomènes d’humanisation, d’adhésion au groupe voire d’empathie : l’accent est bien altéritaire.

Si l’évolution des technologies par l’intelligence artificielle et le deep learning proposent à la société des potentialités encore inexplorées, elles peuvent également conduire à une dystopie où la déshumanisation conduit à reléguer au second plan le rôle politique et social, pourtant majeur, sur le vivre ensemble et la diversité dont fait écho la Déclaration universelle de l’Unesco sur la diversité culturelle.

Plutôt que de les cacher, il semble nécessaire de sensibiliser les recruteurs à la manière dont les accents peuvent participer à la satisfaction client et que les politiques se saisissent de cette question. Si l’Assemblée nationale avait fait un pas fort en votant, en 2020, un texte interdisant les discriminations à l’accent, La Provence rappelle que le Sénat ne semble pas s’en saisir puisqu’il n’apparaît toujours pas à son ordre du jour, deux ans plus tard.![]()

Grégory Miras, Professeur des Universités en didactique des langues, Université de Lorraine

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.