Sprachen lernen

KI: Künstliche Intelligenz und die Vielfalt von Sprachen und Akzenten.

![]() Par

blatt-christophe

Le 16/01/2023

Par

blatt-christophe

Le 16/01/2023

Wir sprechen. Und wir sprechen nicht alle gleich. Und selbst unsere "Muttersprache", unsere "erste" Sprache, die Sprache die wir als unsere Heimatsprache verstehen, selbst diese Sprache zeigt unsere Herkunft und Geschichte.

Wir haben einen... Akzent oder nicht?

Was nun, wenn man die individuelle Sprachform nicht länger besitzen soll? Wenn die Einheitssprache, die Standardsprache, die Normsprache also alle anderen Varianten ausradiert? Wenn der Computer und die KI eine neue, gleichförmige Sprachnorm erst vorstellt, dann allen Sprechern aufzwingt?

Was ist Sprache? Was ein Akzent? was verstehen Und sich noch verstehen können?

Quand les IA s’attaquent à nos accents

Grégory Miras, Université de Lorraine

Juin 2022, l’entreprise SANAS annonce avoir récolté 32 millions de dollars pour la création d’une technologie basée sur l’intelligence artificielle dont l’objectif est de supprimer les accents. Septembre 2022, la plate-forme voit le jour non sans créer intérêt, curiosité et émoi tant dans le monde anglophone que francophone.

De tels logiciels nous plongent dans une dystopie contemporaine où la technologie vient faire disparaître les différences, les marqueurs de l’identité et les cultures des individus. Cette idée n’est pourtant pas nouvelle : le film « Sorry to bother you » sorti en 2018 abordait déjà la question de l’accent des populations africaines-américaines dans une satire sur les centres d’appel.

Alors comment peut-on réellement supprimer un accent ? Entre utopie et dystopie, pourquoi développer une intelligence artificielle capable de « supprimer » les accents peut-il être un problème plus qu’une solution ? Que supprime-t-on de plus qu’une marque sonore en neutralisant un accent ?

Comment l’intelligence artificielle peut faire taire un accent

L’accent peut être défini comme un faisceau d’indices souvent oraux (les voyelles, les consonnes, l’intonation, etc.) qui participe à l’élaboration plus ou moins consciente d’hypothèses sur l’origine géographique, sociale ou langagière des individus. Cet accent peut être dit, entre autres, « régional » ou « étranger » en renvoyant à des imaginaires différents. La pertinence de l’identification d’un accent réside dans le fait qu’un certain nombre de caractéristiques sonores semblent homogènes chez des locuteurs d’une langue, d’une zone géographique ou d’un groupe social, comme le souligne Philippe Boula de Mareüil.

Ces technologies issues de start-up constituent souvent une boite noire et peu d’informations concrètes sur les outils employés pour « supprimer » l’accent sont disponibles. Toutefois, les moyens sont multiples et ils visent principalement à transformer en partie la structure de l’onde sonore afin de rapprocher certains indices acoustiques vers une norme perceptivement déterminée. On pourra ainsi jouer sur le timbre de certaines voyelles, la réalisation de consonnes ou encore transformer des paramètres comme le rythme, l’intonation ou l’accentuation en fonction de cibles perceptives attendues. Dans le même temps, on maintiendra un maximum de paramètres vocaux permettant d’identifier la voix du locuteur initial à l’image du voice cloning pouvant conduire à des arnaques au deepfake vocal. Ces technologies permettent de dissocier ce qui est de l’ordre de la parole de ce qui tient à la voix.

Le traitement automatique et en temps réel de la parole pose des difficultés technologiques dont la principale réside dans la qualité du signal sonore à traiter. Néanmoins, il existe différentes solutions en s’appuyant sur le deep learning et les réseaux de neurones, ainsi que les grands corpus de parole, qui permettent de mieux gérer les incertitudes dans le signal.

[Près de 80 000 lecteurs font confiance à la newsletter de The Conversation pour mieux comprendre les grands enjeux du monde. Abonnez-vous aujourd’hui]

Dans le cas des langues étrangères, Sylvain Detey, Lionel Fontan et Thomas Pellegrini repèrent quelques enjeux inhérents au développement de ces technologies, à savoir quelle norme retenir pour mener une comparaison avec ce qui est attendu, ou encore le rôle que peuvent avoir les corpus dans la détermination de ces objectifs – sans qu’il se dégage pour le moment de réponses particulièrement prometteuses.

Le mythe de l’accent neutre

Cependant, l’identification d’un accent ne se limite pas aux seuls indices acoustiques. Donald L. Rubin a pu démontrer que des auditeurs peuvent recréer l’impression d’un accent perçu simplement en associant aux voix des visages aux origines supposées différentes. De la même manière, en l’absence de ces autres indices, les locuteurs ne sont pas si bons dans leur capacité à reconnaître des accents qu’ils n’entendent pas régulièrement ou qu’ils se représentent de manière stéréotypée, par exemple l’idée selon laquelle il y aurait beaucoup de consonnes en allemand.

Vouloir supprimer les accents pour contrer les effets sociaux d’une discrimination sur l’accent revient à poser la question de ce qu’est un accent « neutre ». Or, toutes les variations de prononciation impliquent des représentations. Médéric Gasquet-Cyrus, « spécialiste du marseillais » selon les médias, rappelle que même l’accent dit « parisien » est un accent. En français, l’accent que l’on qualifie de « standard » a évolué en s’appuyant sur des groupes sociologiquement dominants : haute bourgeoisie parisienne, médias (radio, TV), classes moyennes favorisées par exemple.

Depuis plusieurs années, des chercheurs et chercheuses regroupées dans un collectif tentent de déterminer les contours d’un français de référence en s’appuyant sur les similitudes qui existent entre tous les parlers de la francophonie. Le projet « Phonologie du français contemporain » a ainsi permis de mettre à disposition du grand public des accents à entendre.

Il faut également noter que la valeur que l’on attribue à un accent (fort, doux, romantique, dur) dépend largement des individus, des époques et des groupes sociaux. Toutefois, Iván Fónagy, philologue hongrois, a mis en évidence que les individus ont tendance à attribuer les mêmes propriétés à des sons dans son ouvrage La vive voix : Essais de psychophonétique : le /r/ un son bagarreur, le /i/ comme petit, le /u/ (la graphie « ou ») comme opulent, etc.

Supprimer ou garder, l’œuf ou la poule ?

En sociologie, Wayne Brekhus pose la question de la nécessité de porter un regard sur l’invisible et de traiter en même temps le marqué et le non marqué – l’accent et ce que l’on considère être un non-accent. Cela amène à revoir les rapports de pouvoir qui existent entre les individus et la manière dont on homogénéise le marqué : celui ou celle qui a (selon les autres) un accent.

Aussi, nous sommes amenés à questionner comment les technologies émergentes peuvent nous rendre plus « acteur » ou « actrice » qu’« automate », selon Catherine Pascale, en participant à la création d’un cadre éco-éthique. Supprimer un accent, c’est valoriser un type d’accent dominant tout en négligeant le fait que d’autres co-facteurs participeront à la perception de cet accent tout autant que l’émergence de discriminations sur la langue. Supprimer l’accent ne supprime pas les discriminations. Au contraire, l’accent fait entendre l’identité participant ainsi à des phénomènes d’humanisation, d’adhésion au groupe voire d’empathie : l’accent est bien altéritaire.

Si l’évolution des technologies par l’intelligence artificielle et le deep learning proposent à la société des potentialités encore inexplorées, elles peuvent également conduire à une dystopie où la déshumanisation conduit à reléguer au second plan le rôle politique et social, pourtant majeur, sur le vivre ensemble et la diversité dont fait écho la Déclaration universelle de l’Unesco sur la diversité culturelle.

Plutôt que de les cacher, il semble nécessaire de sensibiliser les recruteurs à la manière dont les accents peuvent participer à la satisfaction client et que les politiques se saisissent de cette question. Si l’Assemblée nationale avait fait un pas fort en votant, en 2020, un texte interdisant les discriminations à l’accent, La Provence rappelle que le Sénat ne semble pas s’en saisir puisqu’il n’apparaît toujours pas à son ordre du jour, deux ans plus tard.![]()

Grégory Miras, Professeur des Universités en didactique des langues, Université de Lorraine

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Was ist... ZEIT?

![]() Par

blatt-christophe

Le 11/12/2022

Par

blatt-christophe

Le 11/12/2022

Was ist ZEIT?

Dieser Artikel analysiert diese alte, uralte und immer neue Frage:

Théophile : « Pourquoi le temps ne va que vers le futur et jamais vers le passé ? »

Michel Tytgat, Université Libre de Bruxelles (ULB)

Tu touches là à une question vieille comme le monde et qui reste dans une large mesure un mystère, riche en paradoxes et en controverses. « Qu’est-ce que donc le temps ? Si personne ne me le demande, je le sais. Si quelqu’un pose la question et que je veux l’expliquer, je ne sais plus ». Dans sa quête du temps, Augustin d’Hippone (Algérie) ira bien sûr plus loin, mais le dilemme qu’il soulève au IVe siècle reste d’actualité.

Sauf à souffrir d’une des multiples formes de pertes de mémoire, nous pouvons plus ou moins bien nous souvenir du passé, mais, et c’est regrettable, nous ne pouvons plus agir dessus. Aussi, si nous pouvons avoir une vague idée de notre futur immédiat, de ce que nous ferons dans une heure, voire lors de nos prochaines vacances, l’avenir reste indécis.

Quelle est donc l’origine de cette « flèche du temps », comme l’a appelée l’astrophysicien Eddington ? Pour lui, un des paradoxes de la physique est que la flèche du temps est absente des lois fondamentales de la Nature. Pour rester dans un cadre simple, considérons les lois de Newton ou lois de la mécanique classique. Elles permettent de déterminer le mouvement d’objets simples lorsqu’ils sont soumis à des forces, par exemple la gravité. Ces lois sont réversibles. Cela veut dire que si on filmait le mouvement d’une particule sous l’action d’une force, il nous serait impossible de dire si le film nous est projeté à l’endroit ou à l’envers. Et il en ainsi pour toutes les lois fondamentales connues et vérifiées, et ce y compris en mécanique quantique. Le temps peut s’écouler dans un sens ou dans un autre, peu importe.

Très bien, mais c’est clairement en contradiction avec notre expérience quotidienne ! Si une bouteille de jus de fruits en verre m’échappe des mains et tombe – en suivant pour le coup les lois de Newton – elle a toutes les chances de voler en éclats en touchant le sol. Si une personne devait filmer ce moment embarrassant, elle n’aurait aucun problème à faire la différence entre une projection de ce film à l’endroit ou à l’envers car personne n’a jamais vu des débris de verre et des gouttes de jus se regrouper pour spontanément reconstituer la bouteille. C’est regrettable, mais c’est comme ça.

Or, dans une large mesure, notre bouteille de jus est soumise aux mêmes lois que les objets simples. La grande différence est que lorsqu’elle casse (et que son jus se répand), elle se décompose en une myriade d’objets simples (débris de verre et gouttes). C’est là une clé de l’irréversibilité.

Alors que notre bouteille est un objet ordonné et structuré, dont la chute est simple et déterminée, ses débris sont grandement désordonnés et ont de multiples manières de se répandre dans l’espace : il y a une seule bouteille mais d’innombrables versions de la bouteille cassée. Alors que chacun des débris est soumis à des lois déterminées et réversibles, tenter de suivre leur évolution un à un deviendrait rapidement impraticable. En outre, si tant est que nous ayons cette capacité, la moindre altération provoquée par un élément extérieur – une goutte s’évaporant, un petit coup de balai sur les morceaux de verre – rendrait la tâche réellement impossible. Le futur est hautement contingent : une chose peut se produire… ou pas.

Cette évolution vers le désordre est une des lois de la nature. Mais ce n’est pas une loi fondamentale. C’est ce qu’on appelle une loi émergente. Elle existe parce qu’il y a une nouvelle distinction à faire dans le comportement de la matière lorsque l’on passe d’un petit à un grand nombre de constituants. En principe, rien n’empêcherait que notre bouteille ne puisse se reconstituer. En pratique, c’est infaisable car il faudrait pour ce faire maîtriser un grand nombre de paramètres et ce avec une très précision infinie. Dès lors, cela devient hautement improbable. Cette nouvelle loi, valable lorsqu’il y a un grand nombre de constituants, est caractérisée par une nouvelle quantité physique qu’on appelle l’entropie.

La flèche du temps, phénomène macroscopique et émergent, est associée à la tendance qu’a l’entropie d’augmenter, cette tendance naturelle qu’à l’ordre à évoluer vers le désordre.

Dès lors, une question clé est de savoir comment l’ordre peut exister s’il ne s’agit de l’état le plus probable ? Dans le cas de la bouteille, la réponse est claire. C’est un produit manufacturé qui a nécessité de l’énergie sous des formes diverses et variées pour devenir un objet structuré (la bouteille et son jus). Reste que son destin est de se dégrader à plus ou moins court terme et il en est ainsi pour toute chose ordonnée, à commencer par les corps vivants et, voyons large, l’Univers dans son ensemble.

Dès lors, l’origine de la flèche du temps de l’Univers (pour rappel, notre Univers est en expansion et aurait un âge d’environ 13,6 milliards d’années) revient à se demander pourquoi il est apparu « ordonné ». Les anciens ne s’y trompaient pas. Cosmos est issu du grec κόσμος, kósmos, « bon ordre, ordre de l’Univers ». La science propose une réponse partielle qui repose sur l’hypothèse de l’inflation, une expansion rapide qui aurait eu lieu au tout début de l’Univers. Son lien avec l’émergence de la flèche du temps reste matière à débat et touche à la nature même du temps en Relativité générale, mais ceci est une autre histoire.

Si toi aussi tu as une question, demande à tes parents d’envoyer un mail à : tcjunior@theconversation.fr. Nous trouverons un·e scientifique pour te répondre.![]()

Michel Tytgat, Physicien, Directeur de Recherches FNRS, Professeur ULB, Université Libre de Bruxelles (ULB)

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Sprachen lernen!

![]() Par

blatt-christophe

Le 14/06/2022

Par

blatt-christophe

Le 14/06/2022

Wir lernen Sprachen, wenn wir eine Sprache lernen wollen.

Pourquoi autoriser le mélange des langues à l’école ?

Grégory Miras, Université de Rouen NormandieDepuis la fin des années 1960, les travaux qui portent sur l’acquisition des langues, tant chez l’enfant que chez l’adulte, s’intéressent à la manière dont les humains sont capables de développer une ou plusieurs langues initiales (la langue « maternelle » qui se conjugue souvent au pluriel) puis d’autres langues additionnelles (les langues « étrangères »).

Ces travaux ont mis en évidence le caractère complexe de ces processus, dont le phénomène d’attrition – le fait de perdre totalement ou partiellement sa compétence dans une langue (parfois sa langue « maternelle ») sous l’effet d’un manque d’actualisation de cette dernière, par la pratique par exemple.

Rappelons que, loin de la vision monolingue française, la grande majorité des humains sur terre est plurilingue. Une situation régulièrement soulignée à l’occasion de la journée européenne des langues.

Si les premiers travaux sur le plurilinguisme ont longtemps considéré le cerveau comme modulaire – c’est-à-dire que le cerveau classerait les langues indépendamment les unes des autres – les avancées en neurocognition tout autant que celles portant sur l’acquisition d’une troisième langue ont ouvert la porte à une compréhension plus complexe de la production du discours.

Pratiques pédagogiques

La manière de considérer le recours à plusieurs langues a évolué au fur et à mesure des avancées scientifiques du domaine. Dans un premier temps, il a été question de considérer les compétences plurilingues comme la capacité à mobilier plusieurs langues de manière superposée et cumulative donc indépendante. Ensuite, cette même compétence a été considérée sous l’angle d’un entrelacement temporaire entre deux ou plusieurs langues – « certains mots transparents ou des faux amis en français se glissent quand je parle en anglais ». Enfin, des travaux plus récents décrivent une approche transversale des langues du répertoire des individus qui transcendent les frontières entre les langues.

Les fondements du « translanguaging » s’inscrivent dans l’école britannique, pour ne pas dire galloise (Trawsieithu), avec les travaux de Cen Williams, dans les années 1980. À ce moment-là, l’objectif pédagogique était de valoriser, à l’école, les langues locales confrontées à l’anglais britannique comme langue d’enseignement. Pour ce faire, la mobilisation et la valorisation des deux langues, pour des objectifs conjoints en production et en perception, étaient légitimées.

Des pratiques de ce type peuvent être identifiées dans d’autres espaces. Ainsi, en Argentine la lecture-compréhension, où les apprenants lisent un texte en langue étrangère et en produisent une synthèse en espagnol, est bien institutionnalisée.

Dans les années 2000, l’école américaine du « translanguaging », incarnée par Ofelia García, élargit ce principe pédagogique vers une compréhension des processus cognitifs transversaux de la maîtrise des langues. Dans son contexte, il s’agissait de réfléchir à l’accompagnement des enfants hispanophones dans le sud des États-Unis d’Amérique où l’anglais américain, comme langue d’enseignement, est un facteur d’échec scolaire. Il s’agit ainsi de reconnaître que les individus ne segmentent pas les langues de leur répertoire mais qu’ils développent des pratiques sociales transversales spécifiques en fonction des contextes de production du discours.

Dans un dispositif pédagogique, les apprenants peuvent lire des ressources dans les langues qu’ils maîtrisent, puis collaborent de manière plurilingue dans la production d’une synthèse dans la langue et la norme visées (le français académique, par exemple) puis terminent par la rédaction d’un texte synthétique dans l’une de leurs langues initiales. Ce principe dépasse le simple fait de « mélanger » des langues comme le font des sketches humoristiques sur l’apprentissage des langues ou des publicités pour des cours d’anglais.

Il est à noter que le terme de « translanguaging » a été traduit et prend des acceptions très différentes dans la recherche francophone comme le précise Guillaume Gentil, professeur en linguistique appliquée à Carleton University. Les principes définis par le « translanguaging » peuvent également apparaître dans d’autres concepts contemporains et francophones comme « la compétence plurilingue » théorisée par Coste, Moore et Zarate et reprise dans le Cadre Européen Commun de Références en Langues (CECRL).

Vers un activisme translingue

Au-delà de la simple description de pratiques pédagogiques ou de processus cognitifs, le « translanguaging » convoque un activisme translingue selon Alastair Pennycook, professeur à l’université de technologie de Sydney. En effet, reconnaître l’existence de cette conception transversale des compétences langagières conduit à des transformations sociétales ayant des répercussions sur les politiques linguistiques.

Le chercheur s’intéresse notamment aux pays où l’anglais a minoré la pratique des langues régionales endogènes et aux formes de libéralisme linguistique (le globish, par exemple).

Cette vision impacte également les politiques éducatives en langues et le cloisonnement des langues étrangères dans les « salles de classe ». Il est question d’ouvrir ces dernières au monde en favorisant une approche par tâches permettant de mieux reconnaître la réalité des pratiques (trans)langagières effectives.

Cependant, il est important de noter que les travaux qui vont dans ce sens suggèrent de reconnaître l’intérêt de valoriser les usages complexes des individus quand il s’agit de « manipuler » plusieurs langues pour réaliser une tâche. Cette reconnaissance ne conduit pas au fait de penser que tout doit se mélanger et l’on pourra attendre des individus qu’ils soient capables, au terme de ce processus translingue, de réaliser une production selon les attendus sociaux, dans la langue étudiée (une dissertation académique, une lettre de motivation, un texte poétique, etc.).

Pour ce faire, Marie-Françoise Narcy-Combes, professeure émérite en didactique des langues, et ses co-auteurs proposent dix principes fondamentaux dont les principaux sont les suivants.

Pour l’apprenant, il s’agit de l’accueillir comme un être unique, complexe et multi-facettes qui ramène avec lui ses connaissances, ses aptitudes et ses expériences culturelles et émotionnelles. Cela conduit à valoriser (et avoir recours) à toutes les langues qu’il parle. Il n’y a pas de « sous-langue » dans un dispositif pédagogique. Cela aura d’autant plus de sens si l’enseignant fait en sorte que l’apprenant soit amené à communiquer dans la langue visée avec des personnes d’autres pays. L’investissement de l’enfant sera d’autant plus important que le travail se fait en faveur du développement de sa créativité, en favorisant un cadre d’apprentissage stimulant.

Pour l’enseignant, il est toujours plus efficace d’être bienveillant et encourageant en proposant des objectifs d’apprentissage clairs et réalistes pour s’assurer que les apprenants les comprennent. Il est pertinent de mettre en place des tâches en lien avec le monde social en dehors de l’école et d’adapter les étapes de travail en fonction des besoins qui émergent au fil de la réalisation de l’exercice.

L’enseignant ne peut avoir toutes les solutions. Il est donc primordial d’encourager la collaboration entre pairs et les interactions sociales (notamment pour l’évaluation par des membres extérieurs au dispositif) mais aussi d’identifier tous les outils facilement disponibles qui permettront aux apprenants de devenir acteurs dans la langue étudiée. Alors comparons nos langues !![]()

Grégory Miras, Maitre de conférences en didactique des langues et prononciation, Université de Rouen Normandie

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

IA: Künstliche Intelligenz?!?

![]() Par

blatt-christophe

Le 19/05/2022

Par

blatt-christophe

Le 19/05/2022

L'intelligence artificielle dans nos vies, au travail: s'adapter ou périr?

Nadia Naffi, Concordia University

À l’ère de la quatrième révolution industrielle, entreprises et travailleurs courent le même risque d’extinction. Pour y faire face, ils doivent faire preuve d’initiative et savoir s’adapter.

À la suite de mes recherches sur le passage de l’état de témoin passif à celui d’agent de changement, j’avance qu'une formation permettant de développer nos connaissances et notre savoir-faire est nécessaire à l’adaptation à l’âge de l’intelligence artificielle (IA).

Mais elle ne suffira pas. Un milieu empathique et empreint de soutien ainsi qu’un apprentissage de soi sont également cruciaux.

La révolution de l’IA est là

La révolution de l’IA est amorcée. La technologie évolue à une vitesse remarquable. La question n’est plus de savoir si l’on s’en sert ou non, mais plutôt comment mieux collaborer avec elle.

Les technologies ambiantes, telles que Siri, Alexa ou Cortana, s’intègrent sans heurt dans nos interactions. Et ce n’est qu’un début.

L’IA émotionnelle apprend aux robots à éprouver de l’empathie. Les articles sur Google AI révèlent la manière dont l’IA aide les gens à résoudre divers problèmes. Les experts s’empressent de prédire comment nous vivrons avec l’IA dans un avenir rapproché, comment il interagira dans le domaine de la santé.

On observe à Montréal une convergence de l’expertise en matière d’IA. Ainsi, le Centre hospitalier de l’Université de Montréal a fondé l’École de l’intelligence artificielle en santé. Quant à Mila, l’Institut québécois d’intelligence artificielle mené par Yoshua Bengio – plus grand spécialiste mondial de l’apprentissage machine et lauréat du prix Turing –, il accélérera le développement de l’IA au Québec.

En France, le gouvernement veut faire du pays « la première terre d’accueil des centres de données en Europe », et les intervenants de l’AI France Summit discutent des « potentialités de l’écosystème France en matière d’intelligence artificielle ». L’Agenda de l’intelligence artificielle prévoit par ailleurs nombre d’événements.

Une tâche qui dépasse l’humain

Les technologies de rupture progressent, la démographie évolue, le pouvoir des consommateurs et l’économie à la demande augmentent, les marchés de talents mondiaux sont en plein essor. L’avenir du travail s’en trouve façonné dans tous les domaines, notamment l’éducation, la cybersécurité, le transport, les soins de santé, la musique et l’agriculture.

Les travailleurs « humains+ » sont ceux qui œuvrent aux côtés des machines pour parvenir à une intelligence collaborative. Ils consolident leurs connaissances, leurs compétences et leurs expériences individuelles au moyen d’un ensemble de capacités technologiques pour améliorer leur rendement.

Enseigner l’adaptabilité

Le 12 février 2019, à l’occasion du CIO Montreal Summit, j’ai abordé la manière de composer avec les technologies de rupture et la diversité, facteurs qui transforment le milieu de travail. Après la table ronde, une participante m’a posé une question clé : comment enseigner l’adaptabilité, soit la capacité de s’accommoder à de nouvelles conditions et de s’épanouir dans de nouveaux environnements, aux dinosaures humains?

« S’adapter ou périr » demeure un mantra du monde des affaires. L'adaptabilité des employés constitue pour eux la clé d’un avenir où nombre des tâches ne peuvent encore être imaginées.

Les employés de la prochaine génération devront être formés comme des humains+ avant d’entrer sur le marché du travail, et la main-d’œuvre actuelle devra se soumettre à une mise à niveau et à un renouvellement continus de ses compétences.

Or, on a peu fait pour repenser la formation et le perfectionnement nécessaires au milieu de travail de l’avenir. Certes, comme la créativité, une autre compétence générale recherchée, l’adaptabilité se révèle plus complexe qu’il n’y paraît.

Elle va au-delà des connaissances et du savoir-faire. Elle exige un changement d’attitude qui ne se produit qu’en révisant nos construits, en tenant compte de nouvelles perspectives et en comprenant que les technologies s’ajoutent à nos propres capacités plutôt que de les remplacer.

Humain contre machine

Beaucoup associent l’IA aux récits de science-fiction, comme la série de films Terminator, où le principal objectif de la technologie est de contrôler, voire d’exterminer la race humaine.

D’autres sont influencés par les mises en garde répétées d’experts du monde entier contre l’IA et la domination technologique. Ainsi, le fondateur de Tesla, Elon Musk, a déclaré à plusieurs reprises que l’IA est plus dangereuse que les armes nucléaires et peut devenir un dictateur immortel. Quant à James Barrat, il s’emploie à mettre en lumière la course à l’intelligence qui se dessine selon lui non pas entre géants de la technologie, mais entre humains et machines.

La technologie a éliminé des emplois dans le passé et en éliminera d’autres dans un avenir rapproché. Les emplois de demain exigeront de la main-d’œuvre actuelle qu’elle s’engage à pratiquer un apprentissage continu.

Par ailleurs, les problèmes éthiques de l’IA n’ont pas encore été résolus, et l’établissement d’un code en la matière s’avère complexe.

Depuis la présentation de la Déclaration de Montréal pour un développement responsable de l’intelligence artificielle, en novembre 2017, jusqu'à son adoption, en décembre 2018, 1 130 citoyens et 28 organismes signataires se sont engagés à favoriser le développement et la mise en œuvre socialement responsables d’une IA qui sert la société et lui profite.

Une évolution empathique

Les dinosaures humains peuvent-ils s’adapter? Je dirais qu’ils le peuvent, mais qu’ils auront besoin du soutien empathique de tout un village.

Les entreprises qui veulent voir leur main-d’œuvre prête pour l’avenir du travail doivent adopter une approche proactive et aider leurs employés à trouver leur place dans le milieu de travail de demain. Surtout, elles doivent comprendre d’où vient la résistance au changement afin d’y remédier.

Simultanément, les entreprises doivent mettre à profit les capacités de leur main-d’œuvre qui ne sont pas propres à un contexte particulier et en faire usage de manière efficace. Avant tout, elles doivent trouver des moyens de préserver les emplois de leurs travailleurs. La peur d’être remplacés peut en effet rendre les dinosaures humains encore moins disposés à changer.

La dynamique d’équipe devrait fonctionner de manière empathique pour faciliter les collaborations entre humains ainsi qu’entre humains et machines, et appuyer chacun dans son processus d’adaptation.

À l’échelle individuelle, nous devons développer notre capacité mentale et émotionnelle ainsi que nos connaissances et compétences pour embrasser notre identité et notre attitude d’humain+. Enfin, nous devons vouloir nous adapter, ce qui exige de changer la manière dont nous voyons le monde. Une fois que nous avons défini et analysé l’essence de notre résistance au changement, nous pouvons élaborer des stratégies qui nous permettront de faire face aux incertitudes et d’expérimenter activement de nouvelles possibilités.

Grâce à cette expérimentation, nous pourrons repenser notre collaboration avec les technologies de rupture et modifier notre conception du milieu de travail de demain.

Le premier World Summit AI Americas, qui a lieu à Montréal le 10 et 11 avril 2019, rassemblera des sommités de l’intelligence artificielle. Outre les fascinantes discussions prévues sur le concept d’AI4Good, les solutions appliquées pour les entreprises, les ateliers pratiques et l’élaboration de plans de mise en œuvre de l’IA au cours de l’année à venir, j’encourage vivement les influenceurs qui seront présents à discuter de l’adaptation de la main-d’œuvre ainsi que de stratégies concrètes pour l’appuyer et la faciliter.![]()

Nadia Naffi, Assistant Professor in the Department of Education (Educational Technology), Concordia University

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Probleme lösen? Algorithmus!

![]() Par

blatt-christophe

Le 12/12/2021

Par

blatt-christophe

Le 12/12/2021

Wir wollen Probleme definieren und wir wollen Lösunge finden. Damit stellt sich die Frage: Wie kann ich ein bestimmtes Problem lösen? Welche Schritte, welche Prozeduren sind notwendig, um in einer gegebenen Situation Lösungen zu erarbeiten?

Ein Algorithmus ist eine Definition von Schritten, um Lösungen methodisch zu erarbeiten.

Qu’est-ce qu’un algorithme ?

Jean Cardinal, Université Libre de Bruxelles (ULB)

Le mot « algorithme » est utilisé couramment dans la presse pour désigner le fonctionnement opaque des moteurs de recherche et des réseaux sociaux.

Mais de quoi parlons-nous exactement ? Qu’est-ce qu’un algorithme ? Cette notion a traversé l’histoire, depuis Euclide jusqu’aux algorithmes des GAFAM. Les algorithmes peuvent-ils résoudre n’importe quel problème ? Quelles garanties a-t-on sur leur comportement ? Quels sont leurs impacts sociétaux ?

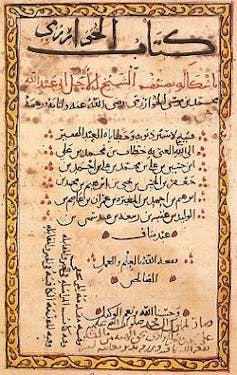

Au IXe siècle, en Perse

L’étymologie fait remonter l’histoire des algorithmes au savant persan Muhammad Ibn Mūsā al-Khuwārizmī, qui aux alentours de l’an 800 a publié les premiers manuels de résolution d’équations. Ses méthodes, à l’origine de l’algèbre, concernent typiquement des problèmes de calcul pratiques : des questions d’héritage ou de mesure.

Ses ouvrages sont traduits en latin au cours du XIIe siècle et popularisés par des personnalités telles que le mathématicien italien Leonardo Fibonacci. C’est son nom, latinisé en « algoritmi » ou « algorismi », qui est à l’origine du terme « algorithme ». Près d’un millénaire avant lui, Euclide avait décrit dans les Éléments une méthode pour calculer le plus grand diviseur commun de deux nombres.

Au XXe siècle, la notion d’algorithme construit des branches des mathématiques

Il faut pourtant attendre le début du XXe siècle pour que la notion d’algorithme soit formalisée. Dans son célèbre discours au deuxième congrès international des mathématiciens à Paris en 1900, le mathématicien allemand David Hilbert propose 23 problèmes ouverts, 23 défis à relever pour la communauté mathématique, dont les énoncés auront une influence considérable sur le développement des mathématiques dans les décennies suivantes. Le dixième problème porte sur l’existence d’une « méthode par laquelle, au moyen d’un nombre fini d’opérations, on pourra déterminer l’existence d’une solution en nombres entiers à une équation polynomiale à coefficients entiers » (les équations « Diophantiennes »). C’est bien de l’existence d’un algorithme qu’il s’agit.

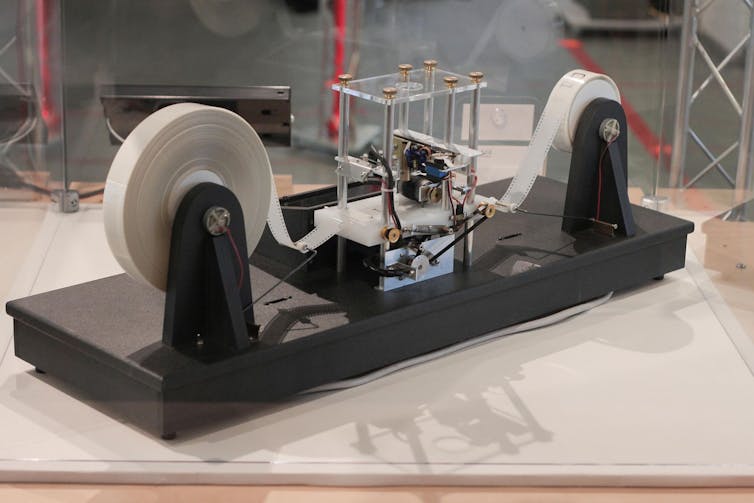

C’est par les travaux fondateurs d’Alan Turing et d’Alonzo Church, entre autres, que les algorithmes deviennent des objets mathématiques à part entière. Dans son article de 1936, Alan Turing donne sa définition de la « calculabilité » d’une fonction : il doit exister une machine qui donne sa valeur en un nombre fini d’étapes élémentaires, guidées par un système de transitions et le contenu d’un ruban, qui joue le rôle de mémoire. C’est la célèbre « machine de Turing ».

Alan Turing comprend le lien entre la calculabilité d’une fonction et le caractère démontrable d’une assertion mathématique dans un système d’axiomes. L’informatique théorique devient une branche des mathématiques.

On circonscrit la puissance des algorithmes, et certains problèmes sont démontrés indécidables : aucun algorithme n’existe pour les résoudre. En 1970, Julia Robinson et Youri Matiiassevitch résolvent finalement le dixième problème de Hilbert : la résolution des équations diophantiennes est un problème indécidable !

Au cours des années 1970, on établit des hiérarchies de problèmes en fonction du temps et de l’espace qu’un algorithme requiert pour les résoudre : c’est la théorie de la complexité.

Comment se présente un algorithme ?

Les algorithmes sont souvent comparés à des recettes de cuisine : une suite d’instructions précises permettant d’obtenir un résultat en un nombre fini d’étapes.

Cette image est juste, mais occulte sans doute un aspect fondamental, le fait qu’un algorithme reçoit des données à traiter (nombres, texte, relations), et certaines instructions sont conditionnelles : les étapes suivies dépendent de ces données, et les exécutions peuvent suivre un cours difficilement prévisible. On peut donner ces instructions sous différentes formes bien définies (organigramme, langage de description), ou même, avec les précautions de rigueur, en langage naturel.

Nous avons tous appris l’algorithme de multiplication de deux nombres à l’école primaire, sans l’aide d’un formalisme avancé. Les algorithmes sont en principe destinés à être mis en œuvre sous forme de programme, dans un langage de programmation compréhensible par un ordinateur. Mais l’algorithme existe indépendamment de cette traduction.

Pour cerner la portée des algorithmes dans nos vies modernes, il faut distinguer leurs familles

Pour mieux comprendre les enjeux et les défis actuels autour des algorithmes, il est important de cerner leur portée et les propriétés que nous sommes à même de garantir sur leurs résultats et leurs comportements. Une typologie des algorithmes est indispensable à cette compréhension.

On peut d’abord distinguer une famille d’algorithmes tellement omniprésents dans notre quotidien qu’ils y sont presque devenus invisibles. Il s’agit d’algorithmes exacts pour des tâches parfaitement bien définies, dont le résultat est facilement vérifiable : multiplier deux nombres, trier une liste de noms par ordre alphabétique, stocker et retrouver efficacement une information, effectuer la conversion d’un signal analogique vers un signal numérique, interpréter un programme.

Il s’agit là des algorithmes fondamentaux étudiés depuis les balbutiements des sciences informatiques. Ils ne font pas moins pour autant l’objet de recherches actuelles, tant des mystères subsistent autour de la complexité de certaines opérations fondamentales. La complexité exacte du problème de multiplication de deux nombres entiers, par exemple, est d’un point de vue théorique encore ouverte : nous sommes actuellement incapables de démontrer que la multiplication prend nécessairement plus de temps que l’addition ! Le meilleur algorithme de multiplication connu n’a été publié que très récemment.

Les algorithmes d’optimisation constituent une deuxième famille importante. Ils résolvent des problèmes dans lesquels on cherche à identifier des paramètres ou une configuration qui maximise ou minimise une valeur, appelée « fonction objectif ». Les applications concrètes consistent par exemple en la recherche d’un chemin le plus court entre deux points, l’ordonnancement des phases d’un projet pour en minimiser la durée, le choix des emplacements d’antennes pour couvrir à moindre coût une zone donnée, ou celui des paramètres des routeurs d’un réseau pour en minimiser la latence.

Les objectifs des algorithmes de ces deux familles sont quantifiables et leurs résultats sont mathématiquement garantis. Les méthodes formelles permettent de vérifier rigoureusement les propriétés d’un algorithme. Les algorithmes d’optimisation linéaire sont bien compris.

Une troisième famille d’algorithmes, plus spécialisés, est celle des algorithmes cryptographiques, destinés à garantir la sécurité des communications et transactions. Cette sécurité repose souvent sur des hypothèses liées à la complexité de problèmes algorithmiques. Le célèbre algorithme RSA (du nom de ses inventeurs : Ronald Rivest, Adi Shamir et Leonard Adleman), par exemple, fait reposer la sécurité des transactions commerciales électroniques sur l’hypothèse qu’il n’existe pas d’algorithme efficace pour décomposer un nombre en ses facteurs premiers.

Certaines procédures issues des recherches en intelligence artificielle, en revanche, ne se soumettent pas facilement à une analyse rigoureuse.

Les algorithmes changent de nature avec l’intelligence artificielle

Parmi ceux-ci, les algorithmes de classification cherchent à placer les données reçues en entrée dans une catégorie correspondant à une réalité extérieure. Un algorithme de reconnaissance d’animaux, par exemple, recevra en entrée une image sous forme d’un tableau de pixels, et devra déterminer si cette image représente plutôt un chat ou un dauphin. Cette tâche n’est pas formellement bien définie : on peut probablement trouver une image ambiguë pour laquelle les réponses fournies par des humains pourraient être différentes. Le caractère correct de ces algorithmes dépend d’une réalité extérieure, qui n’est pas formalisée, et leur exactitude, ou précision, ne peut être établie qu’expérimentalement.

De la même manière, les algorithmes de prédiction cherchent à anticiper l’évolution de certaines quantités mesurées dans le monde physique, ou des comportements dans une population. Ils sont utilisés par exemple en finance pour prédire l’évolution des marchés, ou en marketing, pour présenter aux visiteurs d’un site web les produits ou publicités les plus susceptibles d’attirer leur attention. La pertinence des résultats est ici encore validée empiriquement, et non mathématiquement. À tel point qu’en 2006, la société Netflix a lancé un concours pour améliorer les performances de son algorithme de prédiction d’évaluations de films, avec un prix d’un million de dollars à la clé.

Le développement des ces algorithmes fait massivement appel à des modèles probabilistes, mais aussi à des structures difficilement analysables rigoureusement. C’est le cas en particulier pour les algorithmes de réseaux de neurones artificiels utilisés dans ce qu’on appelle désormais l’« apprentissage profond », en référence au nombre de couches utilisées dans ces réseaux. Ces réseaux encodent implicitement la mémoire des données fournies lors d’une phase d’apprentissage, et permettent de classifier de nouvelles données en entrée.

Que pouvons-nous exiger des algorithmes ?

L’omniprésence des algorithmes fait légitimement l’objet de craintes. Quelles sont les garanties que nous pouvons exiger ?

Un premier type de garantie porte sur l’efficacité. Combien de temps doit-on attendre pour avoir une réponse ? De quelle quantité de mémoire doit-on disposer ? Ces questions sont bien étudiées et ont des formulations et des réponses rigoureuses, mais partielles. Les lacunes dans notre compréhension de la complexité algorithmique laissent en particulier ouverte la possibilité d’attaques inédites mettant en péril la cryptographie basée sur l’algorithme RSA.

La question traditionnelle des performances est intimement liée aux questions de consommation de ressources, qui ont des impacts écologiques. On peut donner à cette question un cadre plus large, et s’interroger sur les ressources consommées par les logiciels, les serveurs. Dans le domaine des algorithmes cryptographiques, certains mécanismes au cœur du fonctionnement des cryptomonnaies, en particulier le principe de la « preuve de travail », ont un impact énergétique dramatique.

Lorsque les objectifs sont facilement vérifiables, comme dans le cas d’un algorithme de tri, ou quantifiés explicitement, comme dans le cas d’un algorithme d’optimisation, il existe une mesure objective de la qualité de la solution. Dans le cas des algorithmes d’optimisation, cependant, le choix de la fonction objectif, la quantité que l’on optimise, peut avoir un impact humain considérable.

Des questions d’éthique

Les questions d’équité et de transparence des algorithmes de classification et de prédiction deviennent pressantes. Dans un ouvrage devenu classique, Cathy O’Neil alerte sur les dérives des systèmes de prise de décision dans les domaines de la justice, de l’action policière, des assurances, de l’évaluation des enseignants, entre autres.

L’algorithme de Gale-Shapley, utilisé par la plate-forme Parcoursup satisfait des propriétés d’optimalité, mais garantit également qu’un comportement stratégique de la part des postulants est impossible.

Les méthodes d’apprentissage supervisé pour la classification consistent classiquement en une collection d’exemples, de paires « entrée-sortie », dont on espère qu’ils peuvent être généralisés, de façon qu’une nouvelle donnée en entrée puisse être associée à une réponse en sortie qui fasse sens. En ne fournissant que des exemples connus lors de ces phases d’apprentissage, on inculque au système tous les biais présents de facto dans les exemples dont on dispose, et l’on apprend ainsi à la machine à les reproduire. C’est le thème du documentaire Coded Bias, relatant l’expérience d’une étudiante du MIT avec les algorithmes de reconnaissance faciale.

Le caractère parfois inexplicable des résultats termine d’expliquer le glissement sémantique récent du mot algorithme : de simple méthode de calcul, l’algorithme est perçu comme une boîte noire omnipotente, dont le fonctionnement interne est inaccessible, et dont les réponses finissent par se substituer à la réalité. Cette perception s’explique notamment par la résurgence des méthodes de réseaux de neurones, dont la complexité défie toute analyse formelle. Les succès expérimentaux dans les tâches confiées aux réseaux profonds sont indéniables et fascinants. Mais certaines expériences mettent en évidence leur fragilité : des chercheurs ont montré qu’en modifiant de manière imperceptible quelques pixels bien choisis d’une image, on peut changer du tout au tout la réponse fournie. En l’absence d’explicitation de la réponse (« c’est un chat, car il a des oreilles pointues et des moustaches »), les questions de confiance et de responsabilités se posent.

La communauté de recherche en intelligence artificielle et en apprentissage automatique s’est emparée des questions d’équité et d’explicabilité : le développement de méthodes d’apprentissage incluant des critères d’équité (fairness in AI) est en plein essor, tandis que le domaine de l’intelligence artificielle « explicable » (explainable AI) traite de la justification des résultats et de la confiance.

Al-Khuwārizmī aurait sûrement été surpris de la postérité de son patronyme !![]()

Jean Cardinal, Professeur, Département d'informatique, Faculté des Sciences, Université Libre de Bruxelles (ULB)

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Aber dieser Ansatz schafft neue Probleme.

Entsteht die Lösung des Problems durch die dabei genutzte Methode?

Werden mögliche Lösungen etwa durch die benutzte Methode verdeckt?

Oder ist die Erarbeitung des Werkzeugs, des Algorithmus, das zentrale Problem, um Lösungen zu erarbeiten?

Allgemeinbildung und " Culture G ".

![]() Par

blatt-christophe

Le 08/12/2021

Par

blatt-christophe

Le 08/12/2021

Was ist... Allgemeinbildung? Was muss ich wissen?

Wenn ich alles wissen würde, würde ich alles wissen?

Ist Bildung ein Katalog von Wissen oder ist Bildung Neugier und die Freunde am Dazulernen, am Lernen, am Studium, um etwas zu verstehen? Das ist eine... gute Frage.

À quoi sert la culture générale en 2021 ?

Cécile Dutriaux, IAE Paris – Sorbonne Business School

À l’heure d’Internet, des réseaux sociaux et de l’accessibilité de tout pour tous en un simple « clic », il devient légitime – quoiqu’un peu effrayant pour un intellectuel – de se demander à quoi peut bien servir, de nos jours, la culture générale. Qu’est donc devenue cette notion, jadis si centrale dans l’éducation, dans la formation des jeunes esprits ? « L’homme sans culture est un arbre sans fruit », disait poétiquement Rivarol. « La culture, ce qui a fait de l’homme autre chose qu’un accident de la nature », déclarait philosophiquement Malraux. Mais plus récemment, cela s’est un peu gâté. Entre le constat fataliste de Bernard Pivot affirmant que « Commercialement, la culture est pénalisante » ou, plus provocant, un ancien chef d’État (en fonction au moment des faits) dénonçant « Un sadique ou un imbécile, choisissez, avait mis dans le programme d’interroger les concurrents d’un concours d’attaché d’administration sur la Princesse de Clèves », le moins que l’on puisse dire, c’est que la culture générale est chahutée..

Alors cette fameuse « culture générale », que devons-nous en penser ? Est-elle toujours un bastion que certains qualifieraient d’élitiste et que l’on chercherait (ou pas) à conquérir ? Ou, au contraire, se serait-elle dissoute dans un populisme rampant ? Ou encore, aurait-elle muté vers de nouvelles formes moins lettrées et plus adaptées à un environnement devenu, au quotidien, plus pragmatique ?

Qu’est-ce que la culture générale ?

La culture générale devrait pouvoir, globalement, se définir comme un ensemble de connaissances culturelles, sans domaine de spécialisation précis. Mais, en France, cette définition n’est pas tout à fait exacte. En réalité, la culture n’est « générale » que par le nom qu’elle porte, tant des pans de connaissances entiers ne sont pas – ou peu – reconnus par cette expression qui se veut pourtant explicitement englobante. En effet, l’univers du savoir qu’elle recouvre se limite souvent quasi exclusivement à des domaines dits « littéraires », à savoir la philosophie, la littérature, l’histoire, les arts et la religion et concerne peu les domaines scientifiques, qu’il s’agisse de sciences dites « exactes » ou naturelles, mais aussi de savoirs techniques, ou plus éloignés encore, d’autres domaines telles l’économie ou la santé.

Et à cette discrimination des « types » de savoirs, on peut également ajouter une autre restriction importante : celle du degré de « consensus intellectuel » accordé – ou non – aux références et qui font que celles-ci appartiennent – ou non – à la fameuse Culture générale, et ce, à un moment donné et pour une population géographiquement circonscrite. Par exemple, reconnaître les premières mesures de la Sarabande d’ Haendel, savoir déclamer la « Tirade des nez » de Cyrano de Bergerac d’Edmond Rostand ou encore connaître, dans l’ordre, les Présidents de la IIIe république française, tout cela fait partie sans nul doute possible de la liste. En revanche, reconnaître une chanson de l’Astre de l’Orient, Oum Kalthoum, reproduire le schéma d’un moteur à quatre temps ou encore énumérer la liste des scores de l’Équipe de France de football à la Coupe de monde 2018, en fait-il partie ? Rien n’est moins sûr…

Quelle finalité pour la culture générale ?

Si l’on considère qu’il s’agit d’une simple accumulation, depuis la prime enfance, de données diverses et variées sans autre but que celui d’additionner des références pour avoir les « codes » bien-pensants d’un milieu élitiste, c’est, en grande partie, désavouer son but originel. En effet, si l’on reprend l’idéal de « l’honnête homme », tel qu’il a été défini au XVIIe siècle, la notion de « culture générale » s’entendait plutôt comme un « premier pas » dans une logique de dépassement de soi. C’est l’équilibre qu’incarne l’aimable, le tempéré et cultivé Philinthe dans Le Misanthrope de Molière : ni inculte (horreur !), ni pédant (horreur aussi !).

Certes, dans un premier temps, se cultiver consistait à acquérir de multiples savoirs, mais surtout, dans l’objectif de les confronter. Et ainsi permettre à l’homme cultivé de passer au-delà de sa notion de nature pour atteindre une nouvelle dimension de son être. Aujourd’hui, cette notion est fortement battue en brèche, bafouée, déviée de ses buts initiaux, voire combattue. Au mieux, on apprend des « bouts » de culture, que l’on replace si nécessaire (examens, soirées jeux entre amis). Au pire, on se détourne de la « culture générale » pour revendiquer uniquement une culture identitaire.

Devant la dérive contemporaine du rapport à la culture non comme moyen mais comme finalité, comment ne pas approuver les réticences de plus en plus nombreuses des prestigieux établissements d’enseignement supérieur et autres concours d’État vis-à-vis de l’exigence de culture générale au moment des épreuves d’entrée ? Que dire des rapports du concours de l’ENA qui, avec un peu plus d’insistance chaque année, déplorent le manque de culture et surtout d’originalité des candidats ? Ce qui était censé faire la différence entre les élèves fait désormais leur ressemblance : mêmes références, mêmes citations, même chemin unique de pensée… Régurgité à partir de fiches toutes préparées par thème, sans la moindre once de pensée individuelle mais avec tous les passages obligés de… culture générale ! Cela pose donc directement la question du conformisme. Et, par ailleurs, comment imaginer et manager une société toujours en mouvement avec des références… toujours à l’arrêt ? Et non seulement à l’arrêt, mais bien également représentatives du mode de pensée de la classe dirigeante.

C’est ainsi que, dès 2013, l’IEP de Paris – dit Sciences Po – a « résolu le problème » de la culture générale, en choisissant purement et simplement de supprimer l’épreuve de la dissertation de culture G de son concours d’entrée, jugeant celle-ci discriminatoire, en s’appuyant sur le raisonnement, maintes fois prouvé depuis, qu’elle était, en grande partie, le fait d’un héritage culturel. D’autres grandes écoles ont suivi la même voie : IEP de province, ENS Lyon, etc.

Vers une culture générale populaire ?

Et pourtant, les Français aiment la culture générale. Ils le disent. Ils le revendiquent parfois. Plaisir personnel, plaisir d’échanger, mais aussi marqueur d’un milieu et donc du « groupe de référence » auquel nous nous identifions, la culture générale connaît, depuis quelques années déjà – mais toujours avec le même succès – un tournant populaire notamment via la télévision et les nombreuses émissions de quiz ouvent même en prime time : citons seulement « Le grand quiz des animateurs » (TF1) « Tout le monde joue – avec… l’Histoire/la France/le Brevet » (France 2). Et, plus récemment, la nouvelle série de ce que l’on pourrait appeler des magazines divertissants, « La fabuleuse histoire de… » proposée là aussi en soirée, avec un grand succès.

Dernier argument de cette popularisation : le choix inattendu de Sylvie Tellier, présidente du comité Miss France, de mettre en place, en 2013, un test de culture générale pour les candidates. Certaines des questions peuvent, certes, prêter à sourire : « Qu’a-t-on célébré en France le 11 novembre dernier ? », « Quel est l’accent du deuxième “e” sur le mot fenetre ? », « À quel animal l’adjectif hippique se rapporte-t-il ? », mais le besoin de reconnaissance, exprimé par cette nouvelle « épreuve » qui apparaît si décalée par rapport à son objet initial montre toujours ce besoin si naturel d’entrer dans une histoire commune.

Ainsi, en 2021, que ce soit en famille, entre amis, à l’école ou dans le monde du travail, la culture générale apparaît toujours et plus que jamais comme un pont essentiel contre les ravages de l’hyperspécialisation. Que ce soit en médecine ou en éducation, ces tendances sont aujourd’hui à la fois très présentes dans la réalité et très contestées dans ce qu’elles promettent pour le futur. Car si elles offrent, à l’instant X, une solution efficace, elles ne permettent pas d’embrasser une vision d’ensemble, ni d’entremêler des connaissances qui n’ont a priori pas de lien entre elles, ce qui fait pourtant tout le sel de la personnalité et le terreau de la créativité.

En puisant ses racines dans des domaines multiples – qui gagneraient certainement à être élargis à des formes de connaissances nouvelles – la culture générale permet d’envisager une approche systémique, c’est-à-dire au-delà de son propre univers, seule façon pour tenter de comprendre, humainement, un monde devenu extrêmement complexe et technique.![]()

Cécile Dutriaux, Doctorante, chaire EPPP, IAE Paris – Sorbonne Business School

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

EMC: Qu'est-ce que l'enseignement moral et civique ?

![]() Par

blatt-christophe

Le 13/10/2021

Par

blatt-christophe

Le 13/10/2021

Rechtsstaat und Demokratie brauchen den mündigen Bürger.

-- Demokratie ist ein Prozess der Zusammenarbeit und diese Zusammenarbeit kann man, muss man, darf man ... lernen.

Qu'est-ce que l'enseignement moral et civique ?

Pierre Kahn, Université de Caen Normandie

C’est à la suite d’un cours d’enseignement moral et civique (EMC) sur la liberté d’expression, où il avait travaillé avec ses élèves à partir de caricatures, dont celles de Mahomet publiées dans Charlie Hebdo, que Samuel Paty, professeur d’histoire-géographie en région parisienne, a été sauvagement assassiné le 16 octobre 2020, près de son collège, à Conflans-Sainte-Honorine. Ce tragique événement a ainsi focalisé l’attention des médias sur la nature de cet enseignement : en quoi consiste-t-il ? Depuis quand existe-t-il ? Quelles sont ses finalités ? Expose-t-il particulièrement les enseignants ? Ceux-ci sont-ils suffisamment formés pour l’assurer ?

Il faut d’abord noter que l’enseignement moral et civique s’inscrit une tradition ancienne, et même originaire, dans la mesure où la préoccupation d’une « instruction morale et civique » (c’était alors l’intitulé officiel d’un tel enseignement) existe depuis les commencements de l’école républicaine.

Portée par Jules Ferry, la loi du 28 mars 1882 – outre l’obligation d’instruction qu’elle impose pour tous les enfants jusqu’à 13 ans – a rendu laïque l’école primaire en remplaçant « l’instruction morale et religieuse » (qui existait depuis la loi Guizot de 1833) par « l’instruction morale et civique » : le « civique » remplaçait le religieux, la formation du citoyen républicain celle du croyant. « Le premier devoir d’une république est de faire des républicains ; et l’on ne fait pas un républicain comme on fait un catholique » déclarait en 1903 Ferdinand Buisson, grande figure de l’école de la République, au congrès du parti radical-socialiste.

Les nouveautés de la rentrée 2015

À travers des dénominations différentes, qui sont certes loin d’être sans signification, ce type d’enseignement (qui n’a été du temps de Jules Ferry instauré que pour l’école primaire, mais fut à partir de la Libération, en 1945, étendu à tous les niveaux de la scolarité) n’a depuis lors pratiquement jamais cessé d’exister.

Intitulé « instruction morale et civique » ou « éducation morale et civique », conservant ou supprimant la référence à la morale, éventuellement transformé en « initiation à la vie économique et sociale » (pour les collèges en 1977) ou encore « éducation civique, juridique et sociale » (pour les lycées, en 1999), il est devenu « enseignement moral et civique », du cours préparatoire aux classes terminales des lycées, par la volonté de Vincent Peillon, ministre de l’Éducation nationale du premier gouvernement issu de l’élection de François Hollande en 2012.

Revenir à l’inspiration première du projet républicain, puiser notamment à la source de la pensée de Ferdinand Buisson, redonner souffle et vie à cet enseignement, telle était d’ailleurs l’intention explicite de Vincent Peillon. Mais si le ministre voulait ainsi lui redonner souffle et vie, c’est que sa légitimité avait perdu de son évidence auprès des familles comme des enseignants.

De ce point de vue, l’EMC, qui a été inscrit dans les programmes à partir de la rentrée 2015, représente une nouveauté dans le paysage scolaire de la fin du XXe siècle et du début du XXIe siècle. Nouveau, il l’est d’abord par son intitulé : la référence dans les programmes à la « morale » avait été abandonnée depuis les années 1960 (en 1961 au collège, en 1965 dans les lycées et en 1969 à l’école primaire, son lieu d’élection pourtant, d’où elle avait disparu avec l’éducation civique elle-même).

Si l’éducation civique est revenue assez vite dans les programmes, en 1985, la morale n’a pas bénéficié de ce retour avant 2008 pour l’école primaire (programmes Darcos) et, surtout, avant que Peillon ne la promeuve à nouveau en 2012. La première nouveauté de l’EMC est donc celle-ci : l’éducation civique n’est pas que civique. La morale elle-même, nommément désignée comme telle, devient, ou redevient, un objet d’enseignement ; elle s’intègre de façon constitutive à un enseignement qui doit donc pleinement assumer sa dimension normative.

À lire aussi : La laïcité, un principe au fondement de l’école de la République

Cela signifie par exemple qu’une leçon d’EMC sur les droits de l’homme ne peut se réduire à transmettre un certain nombre de connaissances (historiques, juridiques, philosophiques…) sur ces droits. Elle doit essayer d’en faire comprendre la valeur et de susciter chez les élèves une adhésion. C’est aussi bien entendu le cas d’une leçon sur la liberté d’expression, et l’on comprend dès lors que des enseignants peuvent, dans leurs cours d’EMC, s’exposer (et parfois s’autocensurer), lorsqu’ils sont amenés à les assurer devant des élèves qui s’identifient, pour des motifs religieux ou idéologiques, à des valeurs opposées.

L’EMC face au pluralisme des valeurs ?

Cela renvoie au problème majeur auquel se heurte l’EMC aujourd’hui : comment rendre compatible la transmission de valeurs communes avec le pluralisme moral, religieux et philosophique qu’une société démocratique reconnaît comme légitime ? L’univers moral contemporain est devenu pluriel, et donc problématique. Comme l’écrit le philosophe Paul Ricœur « nous ne vivons pas dans un consensus global de valeurs qui seraient comme des étoiles fixes ». De ce point de vue, la différence est considérable entre l’enseignement moral et civique (EMC) actuel et l’instruction morale et civique de l’école républicaine des origines.

Dans sa fameuse « lettre aux instituteurs » de 1883, Jules Ferry pouvait parier sur la possibilité d’enseigner une morale commune indépendante des religions (mais non contraires à elles), parce que l’homogénéité morale et culturelle alors existante rendait ce pari raisonnable. C’est cette homogénéité qui semble aujourd’hui faire défaut et qui place l’enseignement moral et civique dans une situation délicate, quand sa légitimité n’est plus nécessairement reconnue par l’ensemble des élèves et des familles.

Comment, dans ces conditions, asseoir davantage cette légitimité ? Deux conditions semblent minimalement requises. La première condition est d’éviter que l’EMC soit le lieu d’une transmission trop dogmatique. Éviter, autrement dit, la reconstitution des « catéchismes républicains » qui fleurissaient dans la deuxième moitié du XIXe siècle. L’EMC est né de la volonté de Vincent Peillon de promouvoir ce qu’il a d’abord appelé la « morale laïque », qui ne prétendait à rien moins, disait-il, qu’à enseigner « le bien et le mal, le juste et l’injuste ».

Tel qu’il était ainsi formulé, ce projet n’était guère de nature à prendre en compte la pluralité des valeurs. Remplacer la référence à la « morale laïque » par « enseignement moral et civique », c’est-à-dire par un intitulé moins lourdement chargé de moralisme, ne pouvait que davantage favoriser cette prise en compte.

L’EMC n’a une chance d’être éducatif que s’il permet de définir en classe un espace de discussion au sein duquel les élèves sont amenés à pouvoir justifier de façon raisonnée et argumentée leurs préférences morales et civiques et s’il leur permet ainsi, pour parler encore comme Paul Ricœur, de pouvoir s’orienter dans un univers problématique.

D’où l’importance, pour l’enseignement moral et civique, de passer par la médiation de savoirs (historiques, littéraires, scientifiques…) : un « enseignement » moral et civique est autre chose qu’une simple « éducation » morale et civique. D’où également l’importance, pour un tel enseignement d’avoir pour ressort pédagogique des dispositifs rendant effectif et profitable cet espace de discussion (institution de conseils, débats réglés, discussion à visée philosophique, jeux de rôles…). Cela suppose bien entendu une formation spécifique des enseignants, et peut-être est-ce là une des faiblesses dont souffre encore aujourd’hui l’EMC.

La deuxième condition à laquelle l’EMC doit s’astreindre, c’est de se penser comme un enseignement pour tous. On ne doit pas le comprendre comme une sorte d’enseignement « de combat », spécialement dirigé contre des idéologies intégristes. Ce n’est pas un enseignement spécialement destiné aux zones urbaines ghettoïsées ni à ce qu’un succès de librairie, en 2012, a appelé « les territoires perdus de la République ».

La transmission des « valeurs de la République » sur laquelle le ministère de l’Éducation nationale a insisté après les attentats de 2015 n’a pas toujours réussi, compte tenu des circonstances mêmes qui ont motivé cette insistance, à éviter l’ambiguïté. Apprendre à réfléchir de façon raisonnée, critique et instruite sur les croyances et préjugés, qui sont si souvent propres à l’enfance, est une finalité éducative d’ordre général. C’est cette finalité d’ordre général qui justifie la présence de l’EMC dans les programmes nationaux.![]()

Pierre Kahn, Professeur des universités émérite, Université de Caen Normandie

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

PASCH: Eine Initiative für ... Zusammenarbeit.

![]() Par

blatt-christophe

Le 05/10/2021

Par

blatt-christophe

Le 05/10/2021

Grundgesetz!

![]() Par

blatt-christophe

Le 13/09/2021

Par

blatt-christophe

Le 13/09/2021

Demokratie braucht Freiheit. Freiheit braucht Regeln. Diese Regeln müssen Ausdruck von allgemeinen, universellen Werten sein. Und diese Werte sind das Fundament einer internationalen Zusammenarbeit. Das Grundgesetz der Bundesrepublik Deutschland definiert diese Werte.

Demokratie braucht Bürger. Demokratie braucht... Demokraten.

Warum sprechen wir verschiedene Sprachen?

![]() Par

blatt-christophe

Le 25/08/2021

Par

blatt-christophe

Le 25/08/2021

Warum sprechen wir verschiedene Sprachen? Und welche Folgen hat das für die Gesellschaften?

-- Sprachen haben eine Geschichte, sie sind Teil einer Familie und sie verändern sich in der Zeit.

Wir müssen oder dürfen oder können uns mit Übersetzungen verstehen. Wir müssen das Übersetzen ... lernen.

Oscar : « Pourquoi n’y a-t-il pas qu’une langue parlée sur Terre ? »

Cameron Morin, Université de Paris

Merci, Oscar, sache que c’est une question plus compliquée qu’on ne le croit et qui a interrogé l’humanité depuis bien des années !

À première vue, on a souvent envie de penser que la grande diversité de langues qui peuplent notre monde remonte aux origines de l’humanité elle-même.

Une des histoires les plus connues qui a tenté de répondre à cette question, c’est celle de la Tour de Babel, dans la Bible. Je te raconte : au commencement du monde, tous les humains parlaient la même langue. C’était une situation vue comme idéale, car ainsi tout le monde se comprenait : moins de risques de malentendus entre les communautés, une communication plus simple, universelle, et propice à la paix. Seulement, les humains utilisèrent cet outil à de mauvaises fins : ils voulurent construire une ville dont la tour principale serait si haute qu’elle toucherait le ciel, le domaine de Dieu. Ce dernier, voyant cette démesure, décida de disperser les bâtisseurs aux quatre coins de la Terre et de brouiller leur langue, afin que chaque groupe en parle une différente et qu’ils ne puissent plus se comprendre. Ainsi naquirent les langues.

Bien sûr, il s’agit d’une histoire, mais elle souligne un certain nombre de problèmes lorsqu’on pense à l’origine du langage et sa diversification sous forme de langues. Les disciplines qui étudient ces questions sont la linguistique (l’étude du langage) et l’anthropologie (l’étude de l’espèce humaine). Beaucoup de scientifiques étudient ces deux domaines depuis le XIXe siècle, mais il reste encore de nombreuses controverses (des débats compliqués) dans les théories. Elles étudient des périodes de l’histoire humaine si anciennes qu’on y trouve très peu d’indices sur les langues parlées à l’époque. Il faut dire que l’écriture n’avait pas encore été inventée, encore moins les cassettes audio !

Tout d’abord, est-ce que l’humanité a démarré avec une et une seule langue ? Ce problème concerne l’évolution du langage : les étapes biologiques qui nous ont permis de communiquer avec des systèmes d’expression de plus en plus créatifs et de plus en plus complexes, qu’on pourrait appeler provisoirement la « grammaire ». Tout comme pour l’origine de la vie, les scientifiques débattent depuis longtemps de la source du langage : a-t-elle émergé à un seul endroit sur Terre ou à plusieurs endroits en même temps ?

Si c’est la première réponse, alors oui, l’humanité a peut-être démarré avec une seule langue, mais sans doute une langue partagée par un tout petit groupe, et qui a très vite changé par la suite. Si c’est la deuxième réponse, alors le langage aurait émergé au sein de plusieurs groupes humains distincts, et donc il y aurait eu, dès le départ, plusieurs langues parlées sur Terre. Les deux positions semblent se défendre et il y a un vrai débat, à cause du manque de données et de preuves issues de notre Préhistoire… Mais dans les deux cas, il semble improbable que tous les humains, au sein d’une grande population allant de l’Europe à l’Asie, aient pu parler une seule et même langue partout, comme dans l’histoire de la Tour de Babel.

Pourquoi c’est improbable ? Parce que la langue a la caractéristique unique de changer en permanence, et très vite, lorsqu’elle est parlée par des groupes de plus en plus nombreux, et dans un espace géographique de plus en plus grand.

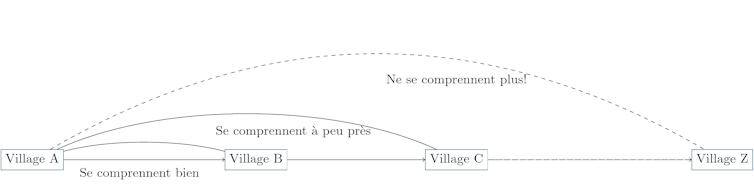

Lorsque nous parlons une langue, nous nous mettons d’accord sur les mots que nous utilisons et les règles grammaticales qui vont les organiser dans des phrases. Mais ces mots et ces règles ne sont jamais exactement les mêmes entre deux individus ni entre deux groupes. Cette variation a pour résultat de faire changer les langues, et d’en créer des nouvelles. Par exemple : prenons le village A, qui parle une langue. Le village B, qui est juste à côté, parle presque la même langue, avec peut-être quelques mots qui changent. Le village C, un peu plus loin, parle une langue similaire, mais avec certaines règles qui diffèrent… Et ainsi de suite, jusqu’au village Z, qui est si loin du village A qu’ils ne se sont jamais rencontrés, et qu’ils parlent une langue si différente qu’ils ne se comprendraient pas !

Notre exemple des villages souligne la variation des langues dans l’espace, mais une autre dimension importante, c’est le changement au cours du temps : par exemple, si tu compares ta manière de parler avec celle de tes parents, tu remarqueras sans doute que vous utilisez des mots un peu différents. En principe, ces différences devraient être encore plus remarquables entre ta manière de parler et celle de tes grands-parents. Tu peux faire le test !

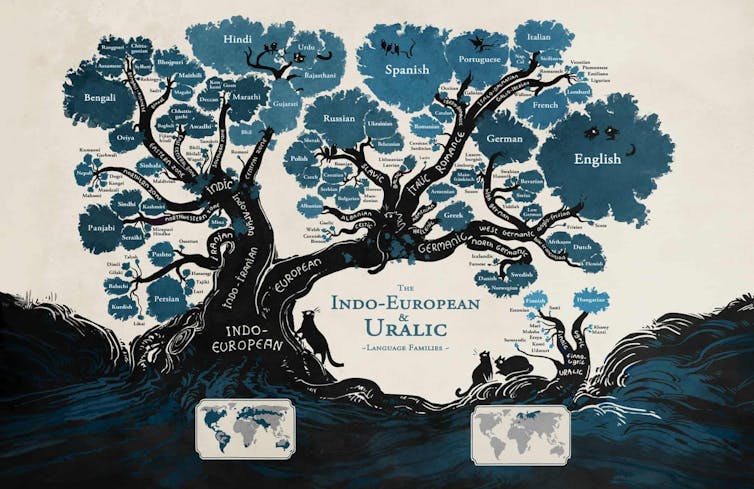

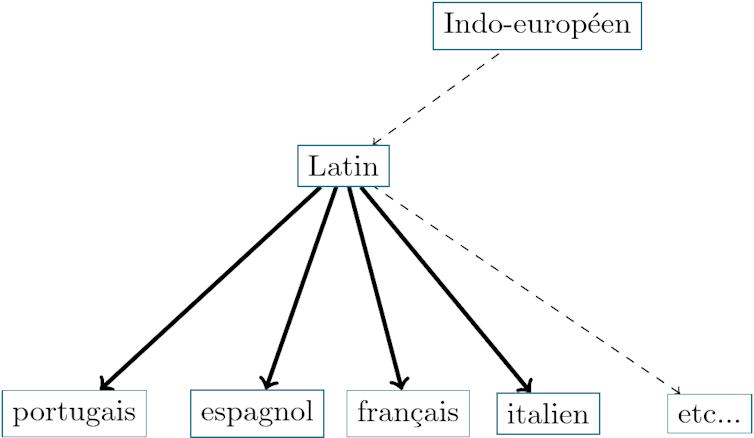

Cette variabilité fondamentale du langage nous donne l’immense nombre de langues qui s’est développé au cours de l’Histoire : aujourd’hui, on les estime à environ 7000 dans le monde – un nombre qui malheureusement décline, à cause d’un phénomène contemporain d’extinction des langues. Chacune de ses langues s’inscrit dans une famille, avec des « frères et sœurs » contemporains (par exemple, le français, l’italien et l’espagnol) et un parent antérieur (le latin). Au XIXe siècle, les linguistes et anthropologues firent une découverte majeure sur les plus de 200 langues parlées en Europe. Une grande partie de celles-ci seraient issues d’une langue commune et très ancienne, répandue en Eurasie : l’indo-européen ! Au fur et à mesure des années, et avec les mouvements de populations qui se sont séparés dans des pays de plus en plus éloignés, l’indo-européen s’est subdivisé en plusieurs familles et sous-familles : parmi les plus connues, les langues slaves (russe, tchèque, croate), celtiques (gaélique, gallois, breton), germaniques (allemand, anglais, scandinave), romanes, et bien d’autres.

Voilà certaines raisons pour expliquer qu’il n’y ait pas qu’une langue parlée sur Terre. Mais est-ce que c’est une mauvaise chose, comme le sous-entend l’histoire de Babel ? Bien que les langues du monde soient très différentes les unes des autres, elles ont en commun de refléter les étonnantes compétences du langage chez les humains, et en cela, elles sont toutes égales. De plus, la diversité des langues est l’image d’une diversité des cultures du monde, d’une richesse de l’humanité répandue aux quatre coins de notre planète. Nous sommes à une époque où la mondialisation tend à réduire cette diversité, et à mettre de nombreuses langues en voie d’extinction, un peu comme les espèces vivantes, animales et végétales, de la nature. Il est urgent de préserver cette diversité, et de peut-être rejeter l’idéal biblique d’une langue « unique et universelle ». Après tout, nous sommes aussi très forts en traduction !

Si toi aussi tu as une question, demande à tes parents d’envoyer un mail à : tcjunior@theconversation.fr. Nous trouverons un·e scientifique pour te répondre.![]()

Cameron Morin, Doctorant en linguistique, Université de Paris

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Arbeiten mit dem Computer...

![]() Par

blatt-christophe

Le 24/08/2021

Par

blatt-christophe

Le 24/08/2021

Arbeiten mit dem Computer... muss man lernen. Internet und Informatik schaffen neue Möglichleiten, aber gleichzeitig braucht man neue Kompetenzen. Die Frage stellt sich: was sollen wir denn noch alles lernen? Kommen denn immer neue Programme und Prüfungen hinzu?

Wie kann man darum den Computer nutzen, um die Arbeit schneller und besser, einfacher zu organisieren?

-- Das wollen wir auch in der Schule lernen.

Débat : Pourquoi le numérique doit s’apprendre à l’école

La crise sanitaire a été un révélateur de l’état de l’école. Le numérique, longtemps aux marges des préoccupations des institutions éducatives, a montré son importance pour le maintien d’une relation pédagogique quand l’accès aux salles de classe n’est plus possible.

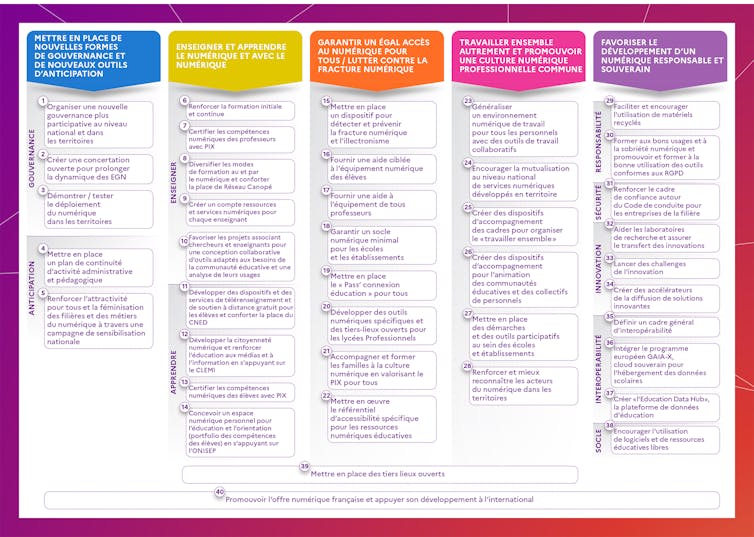

Très marginale au sein de l’enseignement scolaire auparavant, essentiellement réservée aux enfants empêchés (en cas de maladie, d’expatriation familiale), la formation à distance est devenue le cinquième argument d’importance en faveur de la transition numérique de l’école. Elle s’ajoute aux quatre enjeux suivants :

l’efficacité qu’offre le numérique pour certaines activités d’apprentissage ;

l’aide que peuvent apporter les moyens informatiques dans la gestion des parcours d’apprentissage ;

l’apprentissage des sciences du numérique en tant que connaissances académiques ;

enfin, et certainement l’enjeu plus important alors que les réseaux sociaux font partie du quotidien des jeunes, l’éducation citoyenne au numérique.

L’expérience du confinement a eu le mérite d’induire un changement d’échelle dans l’appropriation que les enseignants et leurs élèves ont réalisée du numérique. Pour autant, ce recours contraint aux techniques numériques a également fait apparaître à tous de nombreuses déficiences que les États généraux du numérique, organisés en novembre 2020 par la Direction du numérique pour l’Éducation (DNE), ont relevées.

En réalité, la plupart des enjeux identifiés sont connus de longue date mais restent en suspens en raison d’une politique éducative qui n’a jamais encore donné au numérique la place qu’il devrait y avoir.

L’illusion du concept de « digital natives »

Parmi ces problèmes, il en est un pourtant bien documenté par la recherche depuis une vingtaine d’années, mais encore contre-intuitif à beaucoup. Il s’agit des compétences que les enfants et adolescents ont quant à l’usage des techniques numériques. Aux yeux de beaucoup d’adultes, et en particulier à ceux d’une partie des acteurs de l’école (enseignants, parents d’élèves, décideurs politiques ou responsables institutionnels), les jeunes sont très compétents.

Il faut reconnaître que les pratiques intensives et la dextérité dont la plupart d’entre eux font preuve dans l’utilisation de leurs smartphones nourrissent efficacement une illusion d’expertise. Pour ceux qui les observent, comme pour eux d’ailleurs. Une analyse plus fine de leurs pratiques atteste la réalité de cette expertise mais montre qu’elle se limite aux nécessités techniques de leurs pratiques (utilisation de réseaux sociaux, jeux, entre autres…).

À lire aussi : « In extenso » : Décrypter l’info sur écran, ça s’apprend !

De nombreux témoignages, recueillis dans le cadre de recherches conduites par le laboratoire Techné de l’université de Poitiers durant le confinement, permettent une première identification de compétences de mise en œuvre des techniques numériques, apparemment basiques, qui manquent pourtant aux élèves et font obstacle aux usages scolaires du numérique.

À titre d’exemples, on peut signaler les compétences relatives à l’organisation du stockage des fichiers, celles liées à la manipulation des principaux formats de fichier ou à la maîtrise élémentaire des principales fonctionnalités d’une application d’édition de texte. C’est ainsi que l’on a pu observer des élèves réduits à photographier l’écran de leur ordinateur avec un smartphone pour adresser à leur enseignant le résultat de leur travail, faute d’avoir su l’enregistrer depuis l’application utilisée ou d’avoir su réaliser une copie d’écran.

Ainsi, les compétences numériques des jeunes, essentiellement acquises par l’expérience, ne correspondent pas toujours à celles requises pour une utilisation scolaire. Deux problèmes de formation des jeunes au numérique sont ainsi mis en évidence, aussi importants l’un que l’autre. Le premier concerne l’éducation citoyenne au numérique et le deuxième, plus circonscrit, la formation aux compétences numériques mobilisées à l’École.

Les limites de l’apprentissage par l’expérience

Ce constat milite clairement pour un apprentissage de l’utilisation du numérique à finalité scolaire à l’école. C’est d’autant plus nécessaire quand l’usage des équipements et services numériques par les élèves s’effectue hors de la supervision et de l’accompagnement des enseignants. Ce qui est le cas en situation de confinement.

Aujourd’hui, l’évolution de la quatrième vague pandémique laisse malheureusement craindre que les mesures de restriction d’accès aux locaux scolaires annoncées par le ministre de l’Éducation nationale dans sa circulaire de rentrée ne doivent être activées au long des mois à venir. Certains formulent l’hypothèse que l’expérience acquise par les élèves durant le premier confinement leur a permis de maîtriser l’ensemble des compétences d’utilisation scolaire du numérique. La réalité est autre.

Certaines compétences se construisent relativement aisément dans l’usage, d’autres requièrent le support d’activités d’apprentissage spécifiques. L’utilisation répétée d’une plate-forme de classe virtuelle, par exemple, aura permis à la plupart des élèves d’en découvrir les fonctionnalités principales et de se les approprier. Pour autant, l’instauration de temps de formation explicites permet de progresser plus rapidement, ouvre souvent d’autres perspectives d’utilisation et, surtout, réduit fortement les inégalités face au numérique.

Le développement des compétences numériques par l’expérience trouve ici ses limites. Il semble raisonnable de demander à l’École qu’elle forme systématiquement les élèves aux gestes techniques dont elle attend par ailleurs la maîtrise dans les activités d’apprentissage qu’elle organise. Sinon risquent de se creuser encore les carences éducatives imputables à différents déterminants individuels et sociaux.

L’enjeu des référentiels de compétences