Nachhaltigkeit

KI: Künstliche Intelligenz und die Vielfalt von Sprachen und Akzenten.

![]() Par

blatt-christophe

Le 16/01/2023

Par

blatt-christophe

Le 16/01/2023

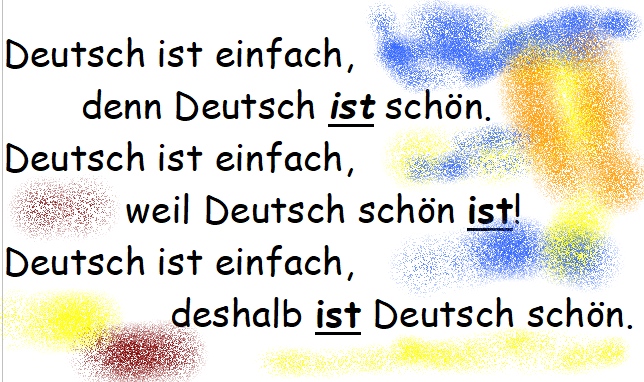

Wir sprechen. Und wir sprechen nicht alle gleich. Und selbst unsere "Muttersprache", unsere "erste" Sprache, die Sprache die wir als unsere Heimatsprache verstehen, selbst diese Sprache zeigt unsere Herkunft und Geschichte.

Wir haben einen... Akzent oder nicht?

Was nun, wenn man die individuelle Sprachform nicht länger besitzen soll? Wenn die Einheitssprache, die Standardsprache, die Normsprache also alle anderen Varianten ausradiert? Wenn der Computer und die KI eine neue, gleichförmige Sprachnorm erst vorstellt, dann allen Sprechern aufzwingt?

Was ist Sprache? Was ein Akzent? was verstehen Und sich noch verstehen können?

Quand les IA s’attaquent à nos accents

Grégory Miras, Université de Lorraine

Juin 2022, l’entreprise SANAS annonce avoir récolté 32 millions de dollars pour la création d’une technologie basée sur l’intelligence artificielle dont l’objectif est de supprimer les accents. Septembre 2022, la plate-forme voit le jour non sans créer intérêt, curiosité et émoi tant dans le monde anglophone que francophone.

De tels logiciels nous plongent dans une dystopie contemporaine où la technologie vient faire disparaître les différences, les marqueurs de l’identité et les cultures des individus. Cette idée n’est pourtant pas nouvelle : le film « Sorry to bother you » sorti en 2018 abordait déjà la question de l’accent des populations africaines-américaines dans une satire sur les centres d’appel.

Alors comment peut-on réellement supprimer un accent ? Entre utopie et dystopie, pourquoi développer une intelligence artificielle capable de « supprimer » les accents peut-il être un problème plus qu’une solution ? Que supprime-t-on de plus qu’une marque sonore en neutralisant un accent ?

Comment l’intelligence artificielle peut faire taire un accent

L’accent peut être défini comme un faisceau d’indices souvent oraux (les voyelles, les consonnes, l’intonation, etc.) qui participe à l’élaboration plus ou moins consciente d’hypothèses sur l’origine géographique, sociale ou langagière des individus. Cet accent peut être dit, entre autres, « régional » ou « étranger » en renvoyant à des imaginaires différents. La pertinence de l’identification d’un accent réside dans le fait qu’un certain nombre de caractéristiques sonores semblent homogènes chez des locuteurs d’une langue, d’une zone géographique ou d’un groupe social, comme le souligne Philippe Boula de Mareüil.

Ces technologies issues de start-up constituent souvent une boite noire et peu d’informations concrètes sur les outils employés pour « supprimer » l’accent sont disponibles. Toutefois, les moyens sont multiples et ils visent principalement à transformer en partie la structure de l’onde sonore afin de rapprocher certains indices acoustiques vers une norme perceptivement déterminée. On pourra ainsi jouer sur le timbre de certaines voyelles, la réalisation de consonnes ou encore transformer des paramètres comme le rythme, l’intonation ou l’accentuation en fonction de cibles perceptives attendues. Dans le même temps, on maintiendra un maximum de paramètres vocaux permettant d’identifier la voix du locuteur initial à l’image du voice cloning pouvant conduire à des arnaques au deepfake vocal. Ces technologies permettent de dissocier ce qui est de l’ordre de la parole de ce qui tient à la voix.

Le traitement automatique et en temps réel de la parole pose des difficultés technologiques dont la principale réside dans la qualité du signal sonore à traiter. Néanmoins, il existe différentes solutions en s’appuyant sur le deep learning et les réseaux de neurones, ainsi que les grands corpus de parole, qui permettent de mieux gérer les incertitudes dans le signal.

[Près de 80 000 lecteurs font confiance à la newsletter de The Conversation pour mieux comprendre les grands enjeux du monde. Abonnez-vous aujourd’hui]

Dans le cas des langues étrangères, Sylvain Detey, Lionel Fontan et Thomas Pellegrini repèrent quelques enjeux inhérents au développement de ces technologies, à savoir quelle norme retenir pour mener une comparaison avec ce qui est attendu, ou encore le rôle que peuvent avoir les corpus dans la détermination de ces objectifs – sans qu’il se dégage pour le moment de réponses particulièrement prometteuses.

Le mythe de l’accent neutre

Cependant, l’identification d’un accent ne se limite pas aux seuls indices acoustiques. Donald L. Rubin a pu démontrer que des auditeurs peuvent recréer l’impression d’un accent perçu simplement en associant aux voix des visages aux origines supposées différentes. De la même manière, en l’absence de ces autres indices, les locuteurs ne sont pas si bons dans leur capacité à reconnaître des accents qu’ils n’entendent pas régulièrement ou qu’ils se représentent de manière stéréotypée, par exemple l’idée selon laquelle il y aurait beaucoup de consonnes en allemand.

Vouloir supprimer les accents pour contrer les effets sociaux d’une discrimination sur l’accent revient à poser la question de ce qu’est un accent « neutre ». Or, toutes les variations de prononciation impliquent des représentations. Médéric Gasquet-Cyrus, « spécialiste du marseillais » selon les médias, rappelle que même l’accent dit « parisien » est un accent. En français, l’accent que l’on qualifie de « standard » a évolué en s’appuyant sur des groupes sociologiquement dominants : haute bourgeoisie parisienne, médias (radio, TV), classes moyennes favorisées par exemple.

Depuis plusieurs années, des chercheurs et chercheuses regroupées dans un collectif tentent de déterminer les contours d’un français de référence en s’appuyant sur les similitudes qui existent entre tous les parlers de la francophonie. Le projet « Phonologie du français contemporain » a ainsi permis de mettre à disposition du grand public des accents à entendre.

Il faut également noter que la valeur que l’on attribue à un accent (fort, doux, romantique, dur) dépend largement des individus, des époques et des groupes sociaux. Toutefois, Iván Fónagy, philologue hongrois, a mis en évidence que les individus ont tendance à attribuer les mêmes propriétés à des sons dans son ouvrage La vive voix : Essais de psychophonétique : le /r/ un son bagarreur, le /i/ comme petit, le /u/ (la graphie « ou ») comme opulent, etc.

Supprimer ou garder, l’œuf ou la poule ?

En sociologie, Wayne Brekhus pose la question de la nécessité de porter un regard sur l’invisible et de traiter en même temps le marqué et le non marqué – l’accent et ce que l’on considère être un non-accent. Cela amène à revoir les rapports de pouvoir qui existent entre les individus et la manière dont on homogénéise le marqué : celui ou celle qui a (selon les autres) un accent.

Aussi, nous sommes amenés à questionner comment les technologies émergentes peuvent nous rendre plus « acteur » ou « actrice » qu’« automate », selon Catherine Pascale, en participant à la création d’un cadre éco-éthique. Supprimer un accent, c’est valoriser un type d’accent dominant tout en négligeant le fait que d’autres co-facteurs participeront à la perception de cet accent tout autant que l’émergence de discriminations sur la langue. Supprimer l’accent ne supprime pas les discriminations. Au contraire, l’accent fait entendre l’identité participant ainsi à des phénomènes d’humanisation, d’adhésion au groupe voire d’empathie : l’accent est bien altéritaire.

Si l’évolution des technologies par l’intelligence artificielle et le deep learning proposent à la société des potentialités encore inexplorées, elles peuvent également conduire à une dystopie où la déshumanisation conduit à reléguer au second plan le rôle politique et social, pourtant majeur, sur le vivre ensemble et la diversité dont fait écho la Déclaration universelle de l’Unesco sur la diversité culturelle.

Plutôt que de les cacher, il semble nécessaire de sensibiliser les recruteurs à la manière dont les accents peuvent participer à la satisfaction client et que les politiques se saisissent de cette question. Si l’Assemblée nationale avait fait un pas fort en votant, en 2020, un texte interdisant les discriminations à l’accent, La Provence rappelle que le Sénat ne semble pas s’en saisir puisqu’il n’apparaît toujours pas à son ordre du jour, deux ans plus tard.![]()

Grégory Miras, Professeur des Universités en didactique des langues, Université de Lorraine

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Was ist... ZEIT?

![]() Par

blatt-christophe

Le 11/12/2022

Par

blatt-christophe

Le 11/12/2022

Was ist ZEIT?

Dieser Artikel analysiert diese alte, uralte und immer neue Frage:

Théophile : « Pourquoi le temps ne va que vers le futur et jamais vers le passé ? »

Michel Tytgat, Université Libre de Bruxelles (ULB)

Tu touches là à une question vieille comme le monde et qui reste dans une large mesure un mystère, riche en paradoxes et en controverses. « Qu’est-ce que donc le temps ? Si personne ne me le demande, je le sais. Si quelqu’un pose la question et que je veux l’expliquer, je ne sais plus ». Dans sa quête du temps, Augustin d’Hippone (Algérie) ira bien sûr plus loin, mais le dilemme qu’il soulève au IVe siècle reste d’actualité.

Sauf à souffrir d’une des multiples formes de pertes de mémoire, nous pouvons plus ou moins bien nous souvenir du passé, mais, et c’est regrettable, nous ne pouvons plus agir dessus. Aussi, si nous pouvons avoir une vague idée de notre futur immédiat, de ce que nous ferons dans une heure, voire lors de nos prochaines vacances, l’avenir reste indécis.

Quelle est donc l’origine de cette « flèche du temps », comme l’a appelée l’astrophysicien Eddington ? Pour lui, un des paradoxes de la physique est que la flèche du temps est absente des lois fondamentales de la Nature. Pour rester dans un cadre simple, considérons les lois de Newton ou lois de la mécanique classique. Elles permettent de déterminer le mouvement d’objets simples lorsqu’ils sont soumis à des forces, par exemple la gravité. Ces lois sont réversibles. Cela veut dire que si on filmait le mouvement d’une particule sous l’action d’une force, il nous serait impossible de dire si le film nous est projeté à l’endroit ou à l’envers. Et il en ainsi pour toutes les lois fondamentales connues et vérifiées, et ce y compris en mécanique quantique. Le temps peut s’écouler dans un sens ou dans un autre, peu importe.

Très bien, mais c’est clairement en contradiction avec notre expérience quotidienne ! Si une bouteille de jus de fruits en verre m’échappe des mains et tombe – en suivant pour le coup les lois de Newton – elle a toutes les chances de voler en éclats en touchant le sol. Si une personne devait filmer ce moment embarrassant, elle n’aurait aucun problème à faire la différence entre une projection de ce film à l’endroit ou à l’envers car personne n’a jamais vu des débris de verre et des gouttes de jus se regrouper pour spontanément reconstituer la bouteille. C’est regrettable, mais c’est comme ça.

Or, dans une large mesure, notre bouteille de jus est soumise aux mêmes lois que les objets simples. La grande différence est que lorsqu’elle casse (et que son jus se répand), elle se décompose en une myriade d’objets simples (débris de verre et gouttes). C’est là une clé de l’irréversibilité.

Alors que notre bouteille est un objet ordonné et structuré, dont la chute est simple et déterminée, ses débris sont grandement désordonnés et ont de multiples manières de se répandre dans l’espace : il y a une seule bouteille mais d’innombrables versions de la bouteille cassée. Alors que chacun des débris est soumis à des lois déterminées et réversibles, tenter de suivre leur évolution un à un deviendrait rapidement impraticable. En outre, si tant est que nous ayons cette capacité, la moindre altération provoquée par un élément extérieur – une goutte s’évaporant, un petit coup de balai sur les morceaux de verre – rendrait la tâche réellement impossible. Le futur est hautement contingent : une chose peut se produire… ou pas.

Cette évolution vers le désordre est une des lois de la nature. Mais ce n’est pas une loi fondamentale. C’est ce qu’on appelle une loi émergente. Elle existe parce qu’il y a une nouvelle distinction à faire dans le comportement de la matière lorsque l’on passe d’un petit à un grand nombre de constituants. En principe, rien n’empêcherait que notre bouteille ne puisse se reconstituer. En pratique, c’est infaisable car il faudrait pour ce faire maîtriser un grand nombre de paramètres et ce avec une très précision infinie. Dès lors, cela devient hautement improbable. Cette nouvelle loi, valable lorsqu’il y a un grand nombre de constituants, est caractérisée par une nouvelle quantité physique qu’on appelle l’entropie.

La flèche du temps, phénomène macroscopique et émergent, est associée à la tendance qu’a l’entropie d’augmenter, cette tendance naturelle qu’à l’ordre à évoluer vers le désordre.

Dès lors, une question clé est de savoir comment l’ordre peut exister s’il ne s’agit de l’état le plus probable ? Dans le cas de la bouteille, la réponse est claire. C’est un produit manufacturé qui a nécessité de l’énergie sous des formes diverses et variées pour devenir un objet structuré (la bouteille et son jus). Reste que son destin est de se dégrader à plus ou moins court terme et il en est ainsi pour toute chose ordonnée, à commencer par les corps vivants et, voyons large, l’Univers dans son ensemble.

Dès lors, l’origine de la flèche du temps de l’Univers (pour rappel, notre Univers est en expansion et aurait un âge d’environ 13,6 milliards d’années) revient à se demander pourquoi il est apparu « ordonné ». Les anciens ne s’y trompaient pas. Cosmos est issu du grec κόσμος, kósmos, « bon ordre, ordre de l’Univers ». La science propose une réponse partielle qui repose sur l’hypothèse de l’inflation, une expansion rapide qui aurait eu lieu au tout début de l’Univers. Son lien avec l’émergence de la flèche du temps reste matière à débat et touche à la nature même du temps en Relativité générale, mais ceci est une autre histoire.

Si toi aussi tu as une question, demande à tes parents d’envoyer un mail à : tcjunior@theconversation.fr. Nous trouverons un·e scientifique pour te répondre.![]()

Michel Tytgat, Physicien, Directeur de Recherches FNRS, Professeur ULB, Université Libre de Bruxelles (ULB)

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Klimawandel? Klimawandel!

![]() Par

blatt-christophe

Le 06/09/2022

Par

blatt-christophe

Le 06/09/2022

Es ist soweit... der Klimawandel ist da.

Daraus entstehen neue Faktoren für die Raumordnung.

Welche Folgen entstehen lokal? Was können, müssen wir unternehmen?

Allgemeinbildung und " Culture G ".

![]() Par

blatt-christophe

Le 08/12/2021

Par

blatt-christophe

Le 08/12/2021

Was ist... Allgemeinbildung? Was muss ich wissen?

Wenn ich alles wissen würde, würde ich alles wissen?

Ist Bildung ein Katalog von Wissen oder ist Bildung Neugier und die Freunde am Dazulernen, am Lernen, am Studium, um etwas zu verstehen? Das ist eine... gute Frage.

À quoi sert la culture générale en 2021 ?

Cécile Dutriaux, IAE Paris – Sorbonne Business School

À l’heure d’Internet, des réseaux sociaux et de l’accessibilité de tout pour tous en un simple « clic », il devient légitime – quoiqu’un peu effrayant pour un intellectuel – de se demander à quoi peut bien servir, de nos jours, la culture générale. Qu’est donc devenue cette notion, jadis si centrale dans l’éducation, dans la formation des jeunes esprits ? « L’homme sans culture est un arbre sans fruit », disait poétiquement Rivarol. « La culture, ce qui a fait de l’homme autre chose qu’un accident de la nature », déclarait philosophiquement Malraux. Mais plus récemment, cela s’est un peu gâté. Entre le constat fataliste de Bernard Pivot affirmant que « Commercialement, la culture est pénalisante » ou, plus provocant, un ancien chef d’État (en fonction au moment des faits) dénonçant « Un sadique ou un imbécile, choisissez, avait mis dans le programme d’interroger les concurrents d’un concours d’attaché d’administration sur la Princesse de Clèves », le moins que l’on puisse dire, c’est que la culture générale est chahutée..

Alors cette fameuse « culture générale », que devons-nous en penser ? Est-elle toujours un bastion que certains qualifieraient d’élitiste et que l’on chercherait (ou pas) à conquérir ? Ou, au contraire, se serait-elle dissoute dans un populisme rampant ? Ou encore, aurait-elle muté vers de nouvelles formes moins lettrées et plus adaptées à un environnement devenu, au quotidien, plus pragmatique ?

Qu’est-ce que la culture générale ?

La culture générale devrait pouvoir, globalement, se définir comme un ensemble de connaissances culturelles, sans domaine de spécialisation précis. Mais, en France, cette définition n’est pas tout à fait exacte. En réalité, la culture n’est « générale » que par le nom qu’elle porte, tant des pans de connaissances entiers ne sont pas – ou peu – reconnus par cette expression qui se veut pourtant explicitement englobante. En effet, l’univers du savoir qu’elle recouvre se limite souvent quasi exclusivement à des domaines dits « littéraires », à savoir la philosophie, la littérature, l’histoire, les arts et la religion et concerne peu les domaines scientifiques, qu’il s’agisse de sciences dites « exactes » ou naturelles, mais aussi de savoirs techniques, ou plus éloignés encore, d’autres domaines telles l’économie ou la santé.

Et à cette discrimination des « types » de savoirs, on peut également ajouter une autre restriction importante : celle du degré de « consensus intellectuel » accordé – ou non – aux références et qui font que celles-ci appartiennent – ou non – à la fameuse Culture générale, et ce, à un moment donné et pour une population géographiquement circonscrite. Par exemple, reconnaître les premières mesures de la Sarabande d’ Haendel, savoir déclamer la « Tirade des nez » de Cyrano de Bergerac d’Edmond Rostand ou encore connaître, dans l’ordre, les Présidents de la IIIe république française, tout cela fait partie sans nul doute possible de la liste. En revanche, reconnaître une chanson de l’Astre de l’Orient, Oum Kalthoum, reproduire le schéma d’un moteur à quatre temps ou encore énumérer la liste des scores de l’Équipe de France de football à la Coupe de monde 2018, en fait-il partie ? Rien n’est moins sûr…

Quelle finalité pour la culture générale ?

Si l’on considère qu’il s’agit d’une simple accumulation, depuis la prime enfance, de données diverses et variées sans autre but que celui d’additionner des références pour avoir les « codes » bien-pensants d’un milieu élitiste, c’est, en grande partie, désavouer son but originel. En effet, si l’on reprend l’idéal de « l’honnête homme », tel qu’il a été défini au XVIIe siècle, la notion de « culture générale » s’entendait plutôt comme un « premier pas » dans une logique de dépassement de soi. C’est l’équilibre qu’incarne l’aimable, le tempéré et cultivé Philinthe dans Le Misanthrope de Molière : ni inculte (horreur !), ni pédant (horreur aussi !).

Certes, dans un premier temps, se cultiver consistait à acquérir de multiples savoirs, mais surtout, dans l’objectif de les confronter. Et ainsi permettre à l’homme cultivé de passer au-delà de sa notion de nature pour atteindre une nouvelle dimension de son être. Aujourd’hui, cette notion est fortement battue en brèche, bafouée, déviée de ses buts initiaux, voire combattue. Au mieux, on apprend des « bouts » de culture, que l’on replace si nécessaire (examens, soirées jeux entre amis). Au pire, on se détourne de la « culture générale » pour revendiquer uniquement une culture identitaire.

Devant la dérive contemporaine du rapport à la culture non comme moyen mais comme finalité, comment ne pas approuver les réticences de plus en plus nombreuses des prestigieux établissements d’enseignement supérieur et autres concours d’État vis-à-vis de l’exigence de culture générale au moment des épreuves d’entrée ? Que dire des rapports du concours de l’ENA qui, avec un peu plus d’insistance chaque année, déplorent le manque de culture et surtout d’originalité des candidats ? Ce qui était censé faire la différence entre les élèves fait désormais leur ressemblance : mêmes références, mêmes citations, même chemin unique de pensée… Régurgité à partir de fiches toutes préparées par thème, sans la moindre once de pensée individuelle mais avec tous les passages obligés de… culture générale ! Cela pose donc directement la question du conformisme. Et, par ailleurs, comment imaginer et manager une société toujours en mouvement avec des références… toujours à l’arrêt ? Et non seulement à l’arrêt, mais bien également représentatives du mode de pensée de la classe dirigeante.

C’est ainsi que, dès 2013, l’IEP de Paris – dit Sciences Po – a « résolu le problème » de la culture générale, en choisissant purement et simplement de supprimer l’épreuve de la dissertation de culture G de son concours d’entrée, jugeant celle-ci discriminatoire, en s’appuyant sur le raisonnement, maintes fois prouvé depuis, qu’elle était, en grande partie, le fait d’un héritage culturel. D’autres grandes écoles ont suivi la même voie : IEP de province, ENS Lyon, etc.

Vers une culture générale populaire ?

Et pourtant, les Français aiment la culture générale. Ils le disent. Ils le revendiquent parfois. Plaisir personnel, plaisir d’échanger, mais aussi marqueur d’un milieu et donc du « groupe de référence » auquel nous nous identifions, la culture générale connaît, depuis quelques années déjà – mais toujours avec le même succès – un tournant populaire notamment via la télévision et les nombreuses émissions de quiz ouvent même en prime time : citons seulement « Le grand quiz des animateurs » (TF1) « Tout le monde joue – avec… l’Histoire/la France/le Brevet » (France 2). Et, plus récemment, la nouvelle série de ce que l’on pourrait appeler des magazines divertissants, « La fabuleuse histoire de… » proposée là aussi en soirée, avec un grand succès.

Dernier argument de cette popularisation : le choix inattendu de Sylvie Tellier, présidente du comité Miss France, de mettre en place, en 2013, un test de culture générale pour les candidates. Certaines des questions peuvent, certes, prêter à sourire : « Qu’a-t-on célébré en France le 11 novembre dernier ? », « Quel est l’accent du deuxième “e” sur le mot fenetre ? », « À quel animal l’adjectif hippique se rapporte-t-il ? », mais le besoin de reconnaissance, exprimé par cette nouvelle « épreuve » qui apparaît si décalée par rapport à son objet initial montre toujours ce besoin si naturel d’entrer dans une histoire commune.

Ainsi, en 2021, que ce soit en famille, entre amis, à l’école ou dans le monde du travail, la culture générale apparaît toujours et plus que jamais comme un pont essentiel contre les ravages de l’hyperspécialisation. Que ce soit en médecine ou en éducation, ces tendances sont aujourd’hui à la fois très présentes dans la réalité et très contestées dans ce qu’elles promettent pour le futur. Car si elles offrent, à l’instant X, une solution efficace, elles ne permettent pas d’embrasser une vision d’ensemble, ni d’entremêler des connaissances qui n’ont a priori pas de lien entre elles, ce qui fait pourtant tout le sel de la personnalité et le terreau de la créativité.

En puisant ses racines dans des domaines multiples – qui gagneraient certainement à être élargis à des formes de connaissances nouvelles – la culture générale permet d’envisager une approche systémique, c’est-à-dire au-delà de son propre univers, seule façon pour tenter de comprendre, humainement, un monde devenu extrêmement complexe et technique.![]()

Cécile Dutriaux, Doctorante, chaire EPPP, IAE Paris – Sorbonne Business School

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Essen + Trinken.

![]() Par

blatt-christophe

Le 16/11/2021

Par

blatt-christophe

Le 16/11/2021

Essen + Trinken: Das sind die Grundlagen unseres Lebens...oder nicht?

Gesellschaften, wenn Menschen in Gemeinschaften leben, organisieren sich um die "Grunddaseinsbedürfnisse, um die Daseinsgrundbedürfnisse...", Essen, Dach über dem Kopf, Arbeit und ... Gesundheit der Kinder.

Wie und was Menschen essen und essen können, wie das Essen zubereitet wird, das definiert eine Gesellschaft.

Energie? Die ERDE hat Energie.

![]() Par

blatt-christophe

Le 12/11/2021

Par

blatt-christophe

Le 12/11/2021

Nachhaltige Entwicklung und Klimawandel und gleichzeitig sind wir auf der Suche nach nachhaltigen Formen der Energieproduktion.

Atomenergie als Lösung für die Energieprobleme der Welt?

Gibt es Alternativen? Was fehlt uns heute? Ist es die Technik? Sind es die Ideen? Ist es Energie?

Dominique : « Si le noyau de la Terre est plus chaud que le soleil, pourquoi la terre ne brûle pas ? »

Yaël Nazé, Université de Liège

Le cœur de la Terre est chaud, très chaud : environ 5400 °C. Cette température est proche de celle qu’on retrouve à la surface du Soleil. Par contre, il faut préciser que le cœur du Soleil, lui, est bien plus chaud : environ 15 millions de degrés ! En comparaison, avec une température de 1000 à 2000 °C, la plupart des flammes sont plus froides.

Pourtant, malgré ces températures élevées, ni le cœur de la Terre, ni le Soleil ne brûle. Brûler, c’est un concept très spécifique, en fait : une réaction chimique dite d’oxydoréduction (impliquant généralement un gaz : l’oxygène) qui libère de la chaleur.

Au cœur du Soleil se produisent des réactions très différentes : celles de la fusion nucléaire. Les noyaux d’un élément appelé hydrogène se combinent pour former un élément un peu plus complexe : l’hélium. Cette réaction libère aussi de l’énergie, qui parvient petit à petit à la surface, d’où elle nous parvient grâce à la lumière.Bien qu’il évacue ainsi la chaleur produite, le Soleil ne se refroidit pas parce que les réactions continuent en son cœur.

À lire aussi : Hugo, 5 ans : « Pourquoi les étoiles brillent-elles ? »

Pour la Terre, les choses sont un peu différentes : la température élevée vient de la chaleur initiale (la Terre était chaude quand elle s’est formée et se refroidit depuis doucement) et de la désintégration des éléments radioactifs (qui ne sont pas éternels).

Le cœur de la Terre est donc chaud, et la chaleur s’évacue là aussi vers la surface. Notre planète s’est donc refroidie petit à petit. Ainsi, il y a plusieurs milliards d’années, la surface est devenue si froide qu’elle s’est solidifiée – c’est le sol sur lequel tu marches. Bien sûr, cette croûte fait un peu comme un couvercle sur une casserole et cela complique le refroidissement, mais il continue à se faire, notamment via les éruptions volcaniques.

Une différence importante avec le Soleil, c’est que notre planète se refroidit petit à petit… Dans un lointain futur, notre Terre n’aura plus de cœur chaud, et cela changera la planète : la dynamo qui s’y produit et génère le champ magnétique s’arrêtera, les plaques de la croûte terrestre ne bougeront plus… Mais en attendant, cette chaleur interne peut être utilisée : c’est la géothermie. Ainsi, l’eau chaude des profondeurs sert pour le chauffage urbain de plusieurs villes…

À lire aussi : Arthur, 6 ans : « Qui a mis du feu au centre de la Terre ? » ![]()

Yaël Nazé, Astronome FNRS à l'Institut d'astrophysique et de géophysique, Université de Liège

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Le 11 Septembre a bouleversé nos mémoires.

![]() Par

blatt-christophe

Le 11/09/2021

Par

blatt-christophe

Le 11/09/2021

Der 11. September 2001 verändert die Welt. Eine neue Weltordnung ist dabei zu entstehen.

-- Was müssen wir lernen? -- Und wie können wir die Situation politisch gestalten?

Aber zuerst: Welche Folgen hat der 11. September für die jungen Menschen heute?

Comment le 11 Septembre a bouleversé nos mémoires

Deux décennies ont passé, mais les souvenirs du 11 septembre 2001 semblent toujours aussi vivaces dans les esprits de ceux qui ont assisté, de près ou de loin, à ces terribles attentats. Directeur de l’unité de recherche « Neuropsychologie et imagerie de la mémoire humaine » à l’Université Caen Normandie, Francis Eustache nous explique pourquoi, et revient sur ce que les recherches des vingt dernières années nous ont appris sur les processus de mémorisation.

The Conversation : En quoi le 11 Septembre a-t-il marqué un tournant dans la recherche sur le traumatisme et la mémoire ?

Francis Eustache : L’impact du 11 Septembre a été majeur, dans nos sociétés, mais aussi dans le monde de la recherche. Après ces attentats, de nombreux travaux ont été menés pour comprendre non seulement la mémoire traumatique, mais aussi la façon dont la mémoire évolue au cours du temps.

Ces travaux ont contribué à modifier de notre perception de la mémoire, en particulier dans ses aspects malléables, dynamiques. Ils ont aussi permis de mieux comprendre les relations entre mémoire individuelle et mémoire collective. Après ces attentats, la notion de trouble de stress post-traumatique a également diffusé beaucoup plus largement dans le grand public.

On peut en effet distinguer plusieurs grandes étapes dans la compréhension de ce syndrome, décrit dès le milieu du XIXe siècle chez les victimes de grandes catastrophes ferroviaires : les deux guerres mondiales, la guerre du Vietnam, la prise de conscience au niveau sociétal de l’impact des violences faites aux femmes et aux enfants dans les années 1970… Mais jusqu’au 11 Septembre, ces informations circulaient surtout dans certains milieux spécialisés. Après cette date, le grand public a pris conscience que le psychotraumatisme entraînait différents symptômes et en particulier des troubles de la mémoire.

TC : Par leur ampleur, par la profusion des images, par le suivi quasi minute par minute du déroulé des événements, ces attentats ont marqué durablement les esprits, bien au-delà des personnes qui ont vécu un psychotraumatisme. Chacun a l’impression de se souvenir très précisément de ce qu’il faisait au moment de l’attaque. Comment cela s’explique-t-il ?

FE : Ce phénomène s’appelle « souvenir flash » (« flash bulb memory » en anglais) : cette expression désigne un souvenir détaillé et vivace qui fixe précisément les circonstances dans lesquelles nous sommes informés de la survenue d’un événement collectif inattendu, surprenant et empreint d’émotion. Une autre dimension importante intervenant dans la formation du souvenir flash est que nous percevons immédiatement que l’information reçue va avoir d’importantes conséquences, pour nous-mêmes et pour la société (quand bien même nous n’en appréhendons pas la portée exacte). En revanche, nous ne participons pas directement à l’événement qui survient ; nous sommes spectateurs à distance, sans possibilité d’action efficace.

Typiquement, après le 11 Septembre, les connaissances sur le souvenir flash ont fait l’objet d’un renouvellement majeur. Avant cette date, le débat était de savoir si le souvenir flash appartenait à une catégorie spéciale de souvenir, plus précis, moins susceptible de s’altérer dans le temps, qui aurait été produite par des mécanismes particuliers. Selon certains, il se serait agi d’un souvenir permanent et indélébile.

Or, les recherches post-11 Septembre (en particulier celles de l’équipe de William Hirst, à la New School de New York, avec qui nous avons aussi collaboré) ont montré que ce n’est pas le cas. En réalité, le souvenir flash est un souvenir comme les autres, qui lui aussi se modifie au fil du temps. Il est juste en quelque sorte « augmenté », plus vivace, par rapport à d’autres souvenirs autobiographiques.

TC : C’est-à-dire ?

FE : Quand on mémorise un souvenir, on encode également son contexte : on sait où l’on est, qui nous donne l’information, le moment où se passe la scène, ce que l’on est en train de faire. À mesure que le temps passe, le souvenir évolue, devient moins précis. Dans le cas du souvenir flash, étant donné qu’il s’agit d’un souvenir qui se forme dans un contexte émotionnel intense, ledit contexte est très fortement mémorisé, y compris en cas d’une activité aussi banale que d’éplucher des légumes dans sa cuisine.

On en vient donc naturellement et inconsciemment à se dire « si je me souviens tellement précisément qu’à ce moment je faisais quelque chose d’aussi trivial, le reste aussi doit être vrai ». On est tellement sûr de se souvenir du contexte qu’on est également certain du contenu du souvenir. Mais ce n’est pas vrai : comme les autres souvenirs, le souvenir flash a pu évoluer avec le temps. Ce qui peut mener à de faux souvenirs dont on ne veut pas démordre…

TC : Comment s’en est-on aperçu ?

FE : Pour déterminer si le souvenir flash avait une spécificité ou s’il s’agissait d’un souvenir autobiographique « normal », les scientifiques ont étudié quatre paramètres : sa précision (qui fait référence à la véracité des détails mémorisés), sa vivacité (qui correspond à la richesse de l’expérience phénoménologique associée au rappel du souvenir), la confiance en sa recollection (qui concerne le sentiment de certitude qu’ont les individus en leur remémoration), et sa stabilité dans le temps.

William Hirst et ses collaborateurs ont par exemple interrogé 3 246 Américains vivant dans sept villes des États-Unis sur leurs souvenirs des attentats du 11 septembre 2001. Leurs résultats indiquent que le taux d’oubli des détails associés au souvenir flash était important la première année (30 %) puis diminuait les deux années suivantes (entre 5 et 10 %) avant de devenir négligeable jusqu’à la dixième année. Cette évolution suit la même courbe que celle d’un souvenir classique.

Nous avons nous-mêmes analysé les mots utilisés par 206 personnes à qui nous avons demandé d’évoquer leurs souvenirs du 11 septembre 2001 une semaine, un an, deux ans et dix ans après les attentats. Nos travaux, publiés cette année, révèlent que dans les premiers temps, le registre émotionnel prédomine, ainsi que la précision temporelle. Les gens décrivent avec exactitude le déroulé des événements, les horaires. Puis au bout de quelque temps, assez rapidement, cette précision s’estompe, et les témoignages se focalisent sur les références spatiales. En outre, l’évolution du souvenir flash de l’attentat est très influencée par la façon dont l’événement est rapporté par les médias.

Tous ces résultats indiquent que le souvenir flash, comme les autres souvenirs, se transforme au fil du temps. C’est un souvenir puissant au plan émotionnel, mais ce n’est pas un souvenir indélébile. Cela peut parfois être difficile à entendre, mais c’est aujourd’hui clairement démontré.

TC : Cette conclusion concerne le souvenir flash, mais n’a rien à voir avec le souvenir traumatique, tel que celui qui peut survenir chez certaines victimes d’attentats…

FE : Effectivement, souvenir flash et souvenir traumatique sont deux représentations mnésiques très différentes. D’ailleurs, le « souvenir traumatique » n’est pas un souvenir à proprement parler.

Contrairement au souvenir flash, dans le cas d’une situation potentiellement traumatique, l’individu se trouve directement confronté avec l’événement. Il perçoit un risque immédiat pour son intégrité physique (ou pour l’intégrité physique de quelqu’un situé à proximité, avec qui il est en empathie), mais sans pouvoir agir avec efficacité. Dans ce cas, l’encodage du souvenir se fait très différemment, sans renforcement contextuel. Le souvenir traumatique présente un profil presque inverse du souvenir flash, de ce point de vue.

Cependant, il existe entre les deux une forme de continuum, en ce sens que l’on monte en intensité émotionnelle. Chez certaines personnes, dans ce « no man’s land » entre souvenir flash et souvenir traumatique se trouve un point de rupture émotionnelle au-delà duquel peut se produire un basculement.

TC : Cela signifie-t-il que l’on peut développer un trouble de stress post-traumatique, même si l’on ne s’est pas trouvé à proximité des tours jumelles le 11 septembre 2001 ? Simplement en étant exposé aux images de l’attentat, par exemple ?

FE : Oui, même si ce n’est bien sûr pas la règle. C’est aujourd’hui un fait bien documenté, et cela a malheureusement été confirmé lors des attentats qui sont survenus par la suite.

Quant à savoir quel est le rôle joué par les images à proprement parler, c’est une question complexe. Bien entendu, chez l’être humain le canal visuel est très prégnant, c’est un vecteur important pour la fabrication des mémoires en général. Quand on évoque un souvenir, ce sont souvent d’abord les images qui reviennent en mémoire. Néanmoins, un point est probablement plus important qu’une éventuelle hiérarchie des sensorialités : c’est le fait que ce qui est perçu soit décontextualisé, encore une fois. Cette absence de contexte mime la situation traumatique.

C’est un point intéressant que l’on a observé dans le cas des attentats du 13 novembre 2015 à Paris : les images qui ont tourné en boucle sur les chaînes d’information en continu, souvent hors de tout contexte (bandeaux défilants mentionnant des informations sans lien avec les images, son coupé dans les lieux publics privant les spectateurs de commentaires, etc.), ont contribué au développement de troubles de stress post-traumatique chez certaines personnes. Ces chaînes n’existaient pas au moment des attentats du 11 Septembre 2001, mais les images en boucles sur toutes les télévisions du monde ont pu avoir le même effet.

TC : À nouveau, on voit que le collectif influence la mémoire individuelle…

FE : C’est un point important : les études menées sur le 11 Septembre ont contribué à établir les liens entre la mémoire des individus et la mémoire collective. Celle-ci se construit de diverses façons, via la narration des médias, la création de mémoriaux, l’organisation de commémorations, l’éducation…

À partir de cette date tragique, on a également réalisé l’importance de la mémoire communicative. Notre mémoire ne se construit pas uniquement dans notre intimité subjective, mais aussi via nos échanges : quand nous enregistrons un souvenir, nous le faisons dans un cadre social, et il en est de même quand nous l’évoquons avec les autres, que nous en parlons. Dès 1926, le sociologue Maurice Halbwachs avait pressenti l’importance de ce qu’il nommait « les cadres sociaux de la mémoire ».

Le trouble de stress post-traumatique survient justement en raison de ce manque de cadre social. La personne qui en souffre mémorise des éléments disparates, très sensoriels et fortement émotionnels, de la scène vécue sans assemblage par le contexte qui permettrait de les unifier et de les faire évoluer dans le temps comme d’autres souvenirs.

Dans le trouble de stress post-traumatique, ces éléments disparates peuvent se transformer en images intrusives qui envahissent la conscience de la personne qui en est victime ; elle les vit comme de nouveaux événements surgissant dans son présent.

TC : Les relations sociales jouent aussi un rôle important dans la prise en charge des blessés psychiques…

FE : Tout à fait. Il y a bien entendu les cellules d’urgence médico-psychologiques, des dispositifs précoces faisant intervenir psychologues, psychiatres, soignants spécifiquement formés pour prendre en charge les blessés psychiques immédiatement après l’événement traumatisant. Mais par la suite, le soutien social est également primordial.

Les blessés psychiques sont très sensibles à l’entourage de leurs proches et de la société. Même ceux qui ne le montrent pas, et donnent l’impression de vouloir s’isoler. Dans cette situation, il est essentiel de maintenir le contact. Et surtout, il faut avoir conscience que les échelles de temps peuvent être très longues. Trop souvent, les proches aimeraient que les personnes traumatisées passent rapidement « à autre chose », qu’elles reprennent leurs activités. Mais c’est souvent difficile.

Nous avons évoqué le traumatisme du 11 Septembre et, plus largement, celui des attentats. Il s’agit, le plus souvent, d’un événement unique dans la vie de l’individu. Mais les situations sont très différentes d’une personne à l’autre. Je pense en particulier aux personnes endeuillées qui ont perdu un proche ou encore à celles qui conservent des séquelles physiques. Le traumatisme peut aussi entraîner d’autres complications, comme une dépression.

Toutefois, nous avons aujourd’hui une meilleure connaissance du traumatisme. Les recherches qui sont menées, y compris au plan thérapeutique, modifient notre regard et les pratiques. Aujourd’hui, des thérapies innovantes sont proposées, qui prennent en compte non seulement la personne souffrant de trouble de stress post-traumatique, mais également son environnement familial.![]()

Francis Eustache, Directeur de l'unité Neuropsychologie et imagerie de la mémoire humaine, Inserm, Ecole Pratique des Hautes Etudes, Université de Caen Normandie, Inserm

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Die CC-Lizenzen im Überblick

![]() Par

blatt-christophe

Le 19/08/2021

Par

blatt-christophe

Le 19/08/2021

Die CC-Lizenzen im Überblick – Welche Lizenz für welche Zwecke?

Zur passenden Lizenz mit vier einfachen Fragen und einer Infografik

Gute Nachricht! Alles ist...in guter Schokolade!

![]() Par

blatt-christophe

Le 06/04/2021

Par

blatt-christophe

Le 06/04/2021

Diese COVID-Zeiten sind reich an schlechten Nachrichten und deshalb macht es Spaß, wenn man auch einmal eine gute Nachricht findet.

Was? Schokolade ist gut für die Gesundheit? Na Prima!

Dann brauchen wir nur noch... Nachhaltige Entwicklung, gerechte Preise

... und gute Arbeitsbedingungen für die Landarbeiter, die diesen wunderbaren Kakao herstellen.

Une brève histoire du chocolat et de ses surprenantes vertus pour la santé

Liam Corr, University of Huddersfield

Le chocolat sous toutes ses formes est un plaisir, que comme beaucoup, je m’octroie presque quotidiennement. Mais le chocolat tel qu’on le déguste aujourd’hui est très différent de celui qui était disponible en Europe, en provenance d’Amérique du Sud, vers le XVIe siècle.

Pour le peuple aztèque, le cacao était consommé sous forme de boisson et revêtait une grande importance culturelle et médicinale. Il était presque considéré comme une panacée qui pouvait guérir diverses affections, notamment la fièvre, la diarrhée, la fatigue, l’angine et la carie dentaire.

La croyance aztèque selon laquelle le cacao était un élixir divin était probablement due à l’idée qu’il était un cadeau de Quetzalcoatl, le dieu aztèque du vent et de la sagesse. C’est peut-être la raison pour laquelle le botaniste suédois Carl Linnaeus a nommé la plante Theobroma cacao, d’après les mots grecs anciens « theos » signifiant dieu et « broma » signifiant nourriture – « nourriture des dieux ».

Il est cependant plus probable que la raison de tout bénéfice potentiel soit due à la forte concentration de polyphénols trouvés dans le cacao naturel – connus sous le nom de flavanols de cacao. Les polyphénols sont des composés antioxydants présents dans les fruits et légumes qui protègent l’organisme contre les radicaux libres, dont un excès a été lié à diverses maladies. Ainsi, même si le cacao n’est pas la panacée, les recherches montrent qu’il est plus qu’un simple plaisir coupable.

Un passé riche

Le responsable présumé de l’intégration du cacao en Europe est Hernan Cortes, un conquistador espagnol (soldat et explorateur) de retour du « Nouveau Monde ».

En 1518, Cortes et ses hommes arrivèrent dans ce qui est aujourd’hui le Mexique et se sont dirigés vers la capitale aztèque de Tenochtitlan. Pendant leur séjour au Mexique, les Espagnols ont dégusté une boisson amère appelée « chikolatl ». Cette boisson contenait des fèves de cacao torréfiées qui étaient écrasées, puis bouillies dans de l’eau avec des épices et du piment.

La première exposition à la boisson n’a pas été une réussite pour les Espagnols, qui l’ont jugée trop amère et presque désagréable. Mais ayant vu Montezuma II, roi des Aztèques, consommer la boisson environ 50 fois par jour, Cortes s’est intéressé au potentiel du cacao et a cherché à le ramener en Espagne après sa conquête.

Une fois en Europe, les fèves de cacao ont été broyées et mélangées à du miel et du sucre, devenant ainsi une boisson populaire parmi l’élite. Finalement, au XIXe siècle, la première tablette de chocolat a été fabriquée par Joseph Fry and Sons, créant ce que nous connaissons aujourd’hui sous le nom de chocolat.

De la fève à la tablette

Alors que les fèves de cacao sous leur forme naturelle contiennent une grande quantité de composés antioxydants, les processus impliqués dans la transformation des fèves en barres chocolatées réduisent la teneur en flavanol du cacao, diminuant ainsi les propriétés antioxydantes du cacao.

En effet, la recherche montre que la poudre de cacao naturelle contient presque dix fois plus de flavanols que le cacao qui a subi ce processus.

Quant aux tablettes de chocolat, le chocolat noir contient presque toujours une plus grande concentration de flavanols que le chocolat au lait. Par exemple, une portion de 25 g de chocolat noir à fort pourcentage (plus de 75 %) peut contenir plus de 80 mg de flavanols de cacao, contre environ 10 mg ou moins par 25 g pour une barre de chocolat au lait.

Les vertus du chocolat pour la santé

Des recherches ont montré que le chocolat noir et les produits à base de cacao contenant au moins 200 mg de flavanols de cacao peuvent améliorer l’élasticité des vaisseaux sanguins, ce qui favorise la circulation sanguine. Et la consommation régulière de flavanols de cacao – même à des doses de 80 mg par jour – améliore la capacité des vaisseaux sanguins à se dilater ou à s’étendre, ce qui aide le corps à réguler la pression sanguine et le flux sanguin vers les organes.

On pense que cela est dû au fait que les flavanols de cacao augmentent la concentration d’oxyde nitrique bioactif. Il s’agit d’une molécule impliquée dans l’élargissement des vaisseaux sanguins qui a également des propriétés anti-inflammatoires et réduit la formation de caillots sanguins, ce qui peut avoir des effets bénéfiques sur la pression sanguine.

Les flavanols de cacao peuvent également augmenter le flux sanguin vers le cerveau, ce qui peut améliorer les performances cognitives. Et ils pourraient contribuer à réduire le déclin cognitif en protégeant le cerveau des dommages causés par les radicaux libres.

Outre leurs avantages cardiovasculaires et cognitifs, les flavanols de cacao pourraient également contribuer à améliorer la récupération musculaire après un exercice physique intense, grâce à leurs puissants effets antioxydants et anti-inflammatoires. Une étude récente a montré qu’une seule dose élevée de 1245 mg de flavanols de cacao (15 g de poudre de cacao à forte teneur en flavanols) améliorait légèrement la récupération musculaire.

La prochaine fois que vous aurez envie de chocolat, choisissez une variété noire à fort pourcentage ou une poudre de cacao naturelle pour ses bienfaits potentiels sur la santé.![]()

Liam Corr, PhD Researcher in the Department of Health Sciences, University of Huddersfield

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Was ist ... Bildung?

![]() Par

blatt-christophe

Le 25/03/2021

Par

blatt-christophe

Le 25/03/2021

Wissenschaft braucht die Zusammenarbeit, den Austausch zwischen den Disziplinen. Sozialwissenschaften und Naturwissenschaften brauchen Kultur.

Kultur ohne Anfrage an die Natur ist leer.

Was ist Bildung? Hat Alexander von Humboldt die richtigen Ideen?

À l’école, faire dialoguer les disciplines scientifiques, c’est important !

Cet article est publié dans le cadre du Forum national « Activons les sciences en classe ! » organisé en ligne par la Fondation La main à la pâte le 27 mars 2021, dont The Conversation France est partenaire. Retrouvez toutes les informations sur cet événement sur le site activons-les-sciences.fr.

L’interdisciplinarité est présentée depuis plusieurs années comme moteur essentiel de créativité, comme une approche qui permet de sortir du carcan de sa discipline pour relever les défis du monde contemporain. Différentes initiatives témoignent d’une telle volonté de faire du lien entre différentes disciplines au service de la formation pour accompagner les jeunes dans la pratique d’une pensée complexe. On peut citer par exemple l’ouverture d’une licence « sciences et humanité » à l’Université d’Aix-Marseille qui associe une expertise disciplinaire approfondie dans différentes disciplines, un rapport critique aux savoirs et le développement d’un esprit de synthèse.

Mais qu’en est-il à l’école ? L’école française est organisée autour d’enseignements qui se structurent progressivement en disciplines scolaires. Cette structuration est nécessaire pour circonscrire des domaines et organiser les connaissances. Elle permet de répartir le travail (entre enseignants notamment) et programmer la manière dont vont se succéder les contenus à enseigner.

Cependant, cette organisation classique de l’enseignement rend difficiles des approches liées aux grands enjeux actuels qui nécessitent de dépasser aujourd’hui un enseignement thématique cloisonné : développement durable, changement climatique, préservation de la biodiversité, diffusion de l’informatique et des technologies numériques, intelligence artificielle, soulignés notamment dans un rapport des Académies des sciences et des technologies sur l’enseignement des sciences.

Nouvelles approches

Depuis plusieurs années, le décloisonnement des disciplines scolaires est encouragé en France comme à l’étranger. Au Québec, depuis près de 20 ans, c’est vu comme un moyen d’aborder, avec les élèves, des situations ancrées dans leur réalité, susceptibles de stimuler leurs intérêts. Yves Lenoir insiste ainsi sur le rôle de l’école pour accompagner les élèves à porter un autre regard sur les questions complexes qu’ils rencontrent dans leur vie, à partir de démarches à caractère scientifique qui impliquent le raisonnement, la recherche systématique et explicite de solutions objectives, la communication, l’esprit critique, etc.

En France, une expérimentation a été lancée au collège en 2006, à l’initiative de La main à la pâte. Il s’agissait d’encourager l’émergence d’approches intégratives de l’enseignement des sciences et technologie et de faciliter un travail collectif entre plusieurs enseignants chacun spécialiste de sa discipline (Physique-chimie, technologie et SVT). Nous avons étudié systématiquement les organisations pédagogiques proposées par les enseignants qui ont participé à cette expérimentation. Nous avons ainsi relevé que l’enjeu principal pour ces enseignants résidait dans leur volonté de motiver leurs élèves aussi bien envers les sciences et la technologie, que pour l’école en général.

Autre élément remarquable, la majorité des équipes enseignantes a choisi de développer des projets en lien avec des questions d’éducation au développement durable, souvent associées à des problématiques locales (mobilité écoresponsable dans ma ville ; composteur et espaces verts du collège, abris à oiseaux et à insectes en partenariat avec la communauté de commune ; la vigne, le vin et le patrimoine local, etc).

C’est lors de la réforme de 2016 que les programmes scolaires ont été restructurés, mettant en avant un continuum des apprentissages et, en particulier, le rapprochement de la classe de 6e avec celles de CM1 et CM2 constituant ainsi le cycle 3. Les programmes scolaires évoluent par le regroupement des notions de différentes disciplines scientifiques et technologiques avec un seul intitulé « sciences et technologie ». Le recours à des approches interdisciplinaires est aussi renforcé, en cycle 4 (à partir de la classe de 5e), par la création d’Enseignements Pratiques Interdisciplinaires (EPI). Par ailleurs, au sein de la Fondation La main à la pâte, un réseau de collèges pilotes s’est développé pour favoriser le travail en équipe et impulser des approches créatives et expérimentales de l’enseignement des sciences et technologie.

Oser l’interdisciplinarité

Cependant, s’aventurer aux frontières de sa discipline d’enseignement ne s’improvise pas. Les enseignants de l’école primaire, dont l’essence même du métier est fondée sur la polyvalence, ne sont pas à l’aise avec des approches interdisciplinaires. Même si des évolutions de la formation sont en cours, la formation initiale des professeurs des écoles a tendance à s’appuyer sur des contenus disciplinaires différenciés, empruntés à l’enseignement secondaire, et donnant une place très réduite à aux sciences et technologie.

De leur côté, les enseignants du secondaire trouvent leur légitimité dans les savoirs acquis pendant leurs études universitaires et leur professionnalité se construit avant tout dans l’enseignement de ces savoirs. La mise en œuvre d’approches interdisciplinaires implique une collaboration entre plusieurs enseignants de disciplines différentes. Ces enseignants n’ont pas les mêmes références, n’utilisent pas les mêmes mots et ne se comprennent pas toujours. Ils sont pourtant poussés vers des modalités de travail collectif, voire même collaboratif.

Cette approche est déstabilisante pour des enseignants qui ont l’habitude d’agir seuls dans leur classe, avec leurs élèves. C’est probablement d’autant plus critique en France où les enseignants exercent leur métier de manière solitaire, avec un tiers des enseignants qui déclarent ne jamais participer à des réunions d’équipe contre moins de 2 % dans la majorité des autres pays de l’OCDE. Développer des pratiques interdisciplinaires à l’école pose ainsi des questions structurelles, sur l’organisation du travail d’équipe.

Mais nous souhaitons souligner aussi que la mise en œuvre d’approches interdisciplinaires engage chacun dans un travail intellectuel complexe. Il est nécessaire d’acquérir une connaissance fine de sa discipline, et une connaissance étendue dans des disciplines différentes. Il est indispensable de développer un esprit de synthèse, d’interroger les savoirs dans leur portée épistémologique, afin de reconstruire un sens à partir de connaissances qui ont été circonscrites pour être définies plus précisément. Enfin, il est nécessaire d’avoir recours à un esprit d’analyse systémique pour concevoir les problèmes dans leur globalité, de penser une réelle démarche de problématisation questionnant les enjeux actuels au travers de démarches scientifiques collaboratives.

Il y a ainsi des défis majeurs de formation et de recherche sur les approches interdisciplinaires qui sont encore trop peu explorés bien qu’ils paraissent urgents dans le contexte actuel. Pour comprendre les problèmes complexes posés par la crise sanitaire que nous traversons, nous sommes amenés à faire la synthèse d’informations scientifiques glanées parmi un flux d’informations plus ou moins fondées.

Les discours scientifiques sont parfois mis à mal au profit de systèmes de croyances aux apparences plus rassurants. Plus que jamais, il semble essentiel de permettre aux enseignants de prendre toute la mesure des enjeux d’une éducation scientifique et technologique citoyenne allant au-delà des cadres disciplinaires traditionnels.![]()

Alice Delserieys, Maîtresse de conférences en didactique des sciences, Aix-Marseille Université (AMU) et Patrice Bonnet, Professeur agrégé de Sciences de la Vie et de la Terre, Aix-Marseille Université, Aix-Marseille Université (AMU)

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Soziale Mobilität? Deutsch lernen!

![]() Par

blatt-christophe

Le 12/02/2021

Par

blatt-christophe

Le 12/02/2021

Die soziale Mobilität beschreibt die Möglichkeit von Menschen in einer Gesellschaft eine andere Position, als die von den Eltern bestimmte, einnehmen zu können.

Kann die Tochter oder der Sohn von einem Arbeiter eine wichtige Stellung erreichen?

Können die Kinder durch Arbeit und Ausbildung einen besseren Verdienst als ihre Eltern erarbeiten?

Was zählt am Ende für den sozialen Aufstieg: Intelligenz, Arbeit und Fähigkeit, Kompetenzen oder ... das Elternhaus?

Die Frage nach der "Sozialen Mobilität" ist aber auch gleichzeitig die Frage nach der Natur einer Gesellschaft und die Soziologie hat ein weites Arbeitsfeld.

Was bedeutet denn "Sozialer Aufstieg", wie kann man "Erfolg im Leben, Erfolg im Beruf" definieren? Reicht eine Definition nach dem Jahreseinkommen aus?

Die "Soziale Mobilität" steht in einem engen Zusammenhang mit der Möbilität der Menschen im Raum und damit entstehen Folgen für die Raumordnung.

Eine Gesellschaft ist ein soziales System, das sich in der Zeit ständig entwickeln muss.

Wie wollen wir morgen leben? Welche Ziele wollen wir in unserer Gesellschaft verfolgen?

Wie kann man "soziale Gerechtigkeit" definieren? Und was bedeutet das für das Problem der "Sozialen Mobilität"?

Démocratiser les grandes écoles : pourquoi ça coince ?

Marie Duru-Bellat, Sciences Po

Alors que les élites françaises, économiques et politiques, sont volontiers critiquées pour la base très étroite de leur recrutement – 84 % d’anciens des grandes écoles parmi les dirigeants des entreprises du CAC 40, par exemple –, les grandes écoles sont l’objet, notamment depuis une vingtaine d’années, de diverses Chartes ou dispositifs qui visent à en élargir le recrutement.

Car aujourd’hui, les deux tiers de leurs étudiants (et même presque 80 % dans les 10 % des écoles les plus sélectives) sont d’origine sociale très favorisée (cadres, chefs d’entreprise, professions libérales et intellectuelles). Ceci correspond, si on se cale sur les élèves de troisième, à des chances d’accéder à une grande école 9 à 10 fois supérieures, pour ces élèves, par rapport à ceux de milieu défavorisé.

Ces constats interrogent : ces élites sont bien monolithiques et on peut s’interroger sur la pertinence de la formation en grande école pour nombre de ces positions de pouvoir… Mais après tout, si l’on était certain qu’accéder à une grande école ne fait que refléter le mérite, il n’y aurait là rien de choquant, dans une société qui rejette l’hérédité des positions sociales au profit d’une sélection des plus méritants, tâche qu’est censée assurer l’institution scolaire.

Alors que le caractère très typé socialement des diplômés des grandes écoles fait soupçonner une entorse au jeu méritocratique, le rapport très fourni de l’Institut des Politiques Publiques, documente les facteurs qui viennent le contrarier, à savoir, outre l’origine sociale, le genre et l’origine géographique. Et ce alors que les diverses actions mises en place depuis les années 2000 n’empêchent pas une grande stabilité !

Une ségrégation sociale massive

Concernant l’impact très fort de l’origine sociale, les auteurs notent que les inégalités sociales de réussite en amont n’expliquent pas tout, environ 50 % si on se cale sur le niveau en fin de troisième. Cela dit, les scolarités jusqu’en troisième sont de moins en moins sélectives, et les filières où l’on accède au lycée le sont, elles, de plus en plus.

Depuis 30 ans, la réelle démocratisation de l’accès au bac s’est accompagnée d’une diversification des bacs, avec notamment le bac professionnel. Cette évolution s’est faite à telle enseigne que les chances d’accéder à un bac général – porte d’accès incontournable pour une grande école – n’ont pas augmenté ces dernières années pour les enfants des milieux les plus défavorisés. Ils sont aspirés par la filière professionnelle, tandis que les probabilités d’obtenir un bac scientifique varient presque de 1 à 10 selon les milieux.

Ces inégalités sociales de réussite sont très précoces : les chances d’obtenir un bac général ou technologique sont elles-mêmes extrêmement inégales selon le niveau scolaire à l’entrée en sixième, lui-même lié au niveau à l’entrée à l’école élémentaire.

On ne saurait donc espérer démocratiser l’accès au sommet de l’élite scolaire – par des bourses au mérite distribuées à 18 ans par exemple – si dès le cours préparatoire des inégalités sociales de réussite s’accumulent, que l’école ne parvient pas à contrer.

Des facteurs culturels et matériels

Cependant, la réussite scolaire ne fait pas tout. Alors que globalement, les filles réussissent mieux leurs études secondaires, et représentent 55 % des effectifs de niveau bac + 3 à bac+5, elles ne comptent que pour seulement 42 % des effectifs des grandes écoles et 37 % des plus sélectives.

Mais là aussi, on ne peut se contenter d’une approche globale calée sur le niveau en fin de troisième. En effet, au lycée, les choix d’options et de filières, qui anticipent les orientations dans le supérieur et la vie professionnelle, sont sexués. À ce stade, les filles n’évitent pas tant les maths que la physique et veillent à rester relativement polyvalentes, ce qui facilitera leur accès aux écoles de commerce ou à Sciences Po.

De fait, leur sous-représentation concerne avant tout les écoles d’ingénieurs (26 %), alors que des filières comme Sciences Po Paris ou, à un degré moindre, les écoles de commerce, sont largement féminisées.

Ici intervient d’une part le poids des stéréotypes qui connotent comme masculines ou féminines les disciplines scolaires, et qui, notamment parce qu’ils marquent inconsciemment les attentes des enseignants, canalisent très tôt le sentiment d’efficacité et les projets des élèves. D’autre part, il faut compter avec l’anticipation d’un monde du travail loin d’être mixte, où il semble plus ou moins facile de se projeter, selon son genre, dans telle ou telle profession. Seules des évolutions sociales de longue haleine peuvent ici atténuer ces freins.

À lire aussi : Pourquoi l’égalité entre les sexes n’efface-t-elle pas les ségrégations dans les filières scientifiques ?

Les grandes écoles sont également très parisiennes : 30 % des étudiants de grande école ont passé leur bac à Paris ou en Île-de-France (contre 19 % des bacheliers), un chiffre qui monte à 41 % dans les 10 écoles les plus sélectives. Ces inégalités sont clairement contraires à l’idéal méritocratique : peu expliquées (20 %) par les inégalités de réussite en 3e, c’est avant tout l’inégale distribution sur le territoire des classes préparatoires et des écoles qui doit être incriminée, tant on sait que l’« offre » éducative locale impacte les choix des lycéens.

Si on ne choisit pas la région où l’on grandit, certaines familles bien informées essaient de choisir le lycée optimal et y parviennent. La moitié des effectifs des écoles les plus sélectives proviennent de seulement 8 % des lycées.

Il faudrait alors, si on ne veut pas supprimer les possibilités de choix d’un lycée, contrôler plus strictement le profil des lycéens mutants, et favoriser une implantation d’établissements dans les villes moyennes. C’est ce qui a été fait par les classes préparatoires privées (et aussi les classes préparatoires ouvertes aux bacheliers technologiques), mais ce sont surtout les élèves des classes moyennes qui en ont profité.

Les inégalités géographiques traduisent aussi le fait que la mobilité a un coût pour les familles. Si les questions de logement sont essentielles, le fait que ce soit pour les écoles de commerce que les inégalités scolaires soient le moins à même d’expliquer leur sélectivité sociale rappelle que le coût des études joue un rôle non négligeable.

D’où la nécessité de bourses, dans un contexte où les possibilités de financer en partie ses études par un job d’étudiant sont quasiment exclues en classe préparatoire aux grandes écoles et dans celles-ci mêmes.

Intervenir tôt et jouer sur les structures

Au total, il est clair que les mesures intervenant au niveau du lycée restent bien trop tardives puisqu’une bonne part de la carrière scolaire des élèves est déjà jouée, de même que l’image, par les élèves, de leurs propres compétences.

On ne peut pas non plus se contenter d’agir au niveau des personnes, notamment sur les motivations ou l’information, car les carrières se jouent dans un contexte tout aussi décisif, qui rend certaines autocensures relativement rationnelles :

-

une offre de formation locale,

-

des études inégalement coûteuses,

-

un marché du travail sexué,

-

un accès à l’élite accaparé par les sortants des grandes écoles.

Jouer sur ces éléments structurels est capital, même si on peut envisager des voies plus radicales : supprimer cette voie si française (qui polarise les stratégies des parents bien en amont du bac), et diversifier les voies d’accès à l’élite, en tout cas rendre moins inégales les perspectives professionnelles des différentes filières du supérieur.

Tant que l’accès aux grandes écoles se fera sur la base d’une sélection scolaire biaisée dès les petites classes, tant que l’accès aux positions les plus enviables mettra en compétition des jeunes dotés par leurs familles d’atouts inégaux, aussi longtemps donc que les familles seront inégales à maints égards, les politiques publiques de démocratisation ont peu de chances d’aboutir, sans compter qu’on ne s’attend pas à ce que ceux qui parviennent actuellement à accaparer les grandes écoles et leurs débouchés militent pour ces changements…![]()

Marie Duru-Bellat, Professeure des universités émérite en sociologie, Observatoire sociologique du changement, Sciences Po

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

Erasmus... plus!

![]() Par

blatt-christophe

Le 27/12/2020

Par

blatt-christophe

Le 27/12/2020

Einen Austausch machen, eine Ausbildung, ein Studium in einem anderen Land machen?

Eine neue, andere Kultur kennen lernen und gleichzeitig neue Freunde finden?

Das ERASMUS-Programm der Europäischen Union bietet diese Möglichkeiten.

Aber ist ein Austausch tatsächlich eine gute Idee, um meinen Beruf und meine Tätigkeit im Berufsleben vorzubereiten?

Alle Arbeit ist Zusammenarbeit und die Europäische Union ist ein Beispiel für den Erfolg von Zusammenarbeit zur Erarbeitung von Frieden und Wirtschaftsentwicklung.

Und die gegenwärtige Krise? Die soziale Krise, die wohl auf die COVID-Krise folgen kann?

Brauchen wir mehr Austausch und internationale Zusammenarbeit oder sollten wir doch besser alle zunächst alle in unseren Regionen, Ländern und Landschaften bleiben?

Alle Arbeit ist... Zusammenarbeit.

Wir brauchen darum mehr Europa, mehr Austausch und eine verstärkte internationale Zusammenarbeit.

Wir brauchen ERASMUS + .

Etudiants : le programme Erasmus a-t-il démocratisé les séjours à l’étranger ?

Alessia Lefébure, École des hautes études en santé publique (EHESP)

Le 21 mars 2019, le rapport annuel de l’agence européenne Erasmus+ a présenté le bilan du célèbre programme européen d’échanges étudiants en faisant apparaître une augmentation du nombre de bénéficiaires (+33 % entre 2014 et 2017 pour la mobilité sortante depuis la France) ainsi qu’une « démocratisation » sociale du dispositif, désormais ouvert aux étudiants en formation professionnelle et en stage.

Si, depuis la création d’Erasmus, le nombre de candidats n’a cessé d’augmenter, l’Union européenne affiche de façon de plus en plus volontariste l’objectif de permettre à un plus grand nombre encore de jeunes de bénéficier d’une mobilité internationale au cours de leur formation. En mai dernier, la Commission européenne a proposé d’ajouter au budget de l’UE 2019 une enveloppe supplémentaire de 20 millions d’euros pour Erasmus+.

À lire aussi : Erasmus : 30 ans de succès, et ensuite ?

En France, l’augmentation des bourses de mobilité Erasmus figurait dans le programme de quasiment toutes les listes créditées de plus de 5 % d’intentions de vote aux élections européennes du 26 mai 2019 : La France insoumise, Républicains, LREM, Parti socialiste et Place publique. Pourquoi cette mobilité intra-européenne demeure-t-elle si importante et consensuelle ?

Objectif politique

Erasmus est le nom d’un programme d’aide à la mobilité étudiante mis en place par la Commission européenne en 1987. C’est à la fois l’acronyme de son nom officiel (« European Community Action Schema for the Mobility of University Students ») et l’hommage à une grande figure de l’humanisme européen du XVIe siècle, Érasme de Rotterdam, qui, par son ouverture d’esprit, sa maîtrise des langues et des savoirs, ses innombrables voyages d’étude fut surnommé « le précepteur de l’Europe ».

À l’époque de la création du programme, l’objectif est éminemment politique. Il s’agit, par un système de bourses et par un mécanisme d’équivalences entre les cursus, d’encourager les étudiants d’un pays membre de l’UE à partir effectuer un séjour dans une université d’un autre pays membre. Objectif : la constitution d’une identité commune européenne.

À l’instar d’Érasme, les fondateurs du programme comptent sur les vertus de la rencontre inter-culturelle et du décentrage pour renforcer les liens et les capacités de dialogue entre jeunes européens, conjurant ainsi intolérance et conflits. Initialement limité à 11 pays participants (Allemagne, Belgique, Danemark, Espagne, France, Grèce, Irlande, Italie, Pays-Bas, Portugal et Royaume-Uni) et progressivement élargi aux universités de 34 pays, ce programme a permis en 32 ans à 4,4 millions d’étudiants d’effectuer une mobilité intra-européenne.

Ce nombre ne représente toutefois qu’un très faible pourcentage du groupe cible (environ 1 % de la population étudiante). Car, en dépit de son immense popularité, Erasmus s’est révélé décevant par rapport aux objectifs attendus. De nombreuses études réalisées auprès des bénéficiaires du programme en ont démontré le caractère élitiste.

Outil de distinction

Erasmus est certes formellement ouvert à tous, l’attribution de bourses, devant lever les freins économiques. Les recherches conduites par la sociologue Magali Ballatore auprès des étudiants de trois universités (Bristol, Turin et Aix-Marseille) ont pourtant mis en évidence que des obstacles persistent lorsque les parents sont issus des catégories socio-professionnelles les moins favorisées et les moins éduquées.

À lire aussi : Faire un séjour Erasmus… Et après ?

Les inégalités socio-économiques entraînent en effet dès le plus jeune âge de fortes inégalités dans le parcours scolaire. L’exposition linguistique, l’acquisition de compétences que Magali Ballatore appelle « migratoires », expliquant ainsi la sur-représentation parmi les étudiants Eramsus des jeunes issus de milieux aisés et éduqués. S’y ajoutent les inégalités d’accès à certaines filières en fonction de leur prestige, de leur classement et de la réputation du système éducatif du pays visé.

Ainsi, la mobilité Erasmus, pensée et conçue pour tous, peut paradoxalement renforcer les clivages socio-culturels lorsqu’elle est l’instrument de stratégies de distinction des élites. Pour les jeunes déjà dotés d’un important capital socio-culturel, l’expérience Erasmus contribue avant tout à renforcer ce qui est de l’ordre du savoir-être dans un contexte international, puisque l’acquisition des connaissances académiques ou linguistiques a déjà eu lieu.

Dans la ligne de ces recherches, une étude récente conduite dans les grandes écoles d’ingénieurs françaises, à partir des enquêtes annuelles sur la mobilité internationale effectuées par la Conférence des grandes écoles (CGE), a confirmé que les inégalités d’origine conditionnent les opportunités internationales des élèves-ingénieurs.

Puisque l’expérience internationale est devenue une ressource essentielle et distinctive dans tous les secteurs d’activité, la compétition pour les séjours les plus valorisants (longs, diplômants, auprès des universités les plus prestigieuses) se joue au profit des élèves issus de milieux favorisés, leur donnant ainsi un atout supplémentaire lors de l’accès au marché du travail.

Compétitivité européenne

Le discours sur la nécessaire démocratisation de la mobilité émerge et s’impose progressivement avec le passage d’Erasmus à Erasmus+ en 2014, symboliquement marqué par l’ouverture du programme à la formation professionnelle, aux stages et aux personnels enseignants et administratifs des universités.

C’est un changement qui s’inscrit dans le contexte actuel européen, caractérisé par un fort mécontentent social, la perte de confiance des populations dans leurs institutions, la déconnexion entre les élites administrativo-politiques et les électeurs, le besoin de « démocratisation » de toutes les politiques publiques.

Mais le changement de nom va de pair avec un changement d’objectif car le paysage de l’enseignement supérieur a sensiblement évolué en trente ans. Le but initial qui était de forger une culture et une identité européenne par l’augmentation de la circulation des étudiants entre pays membres semble aujourd’hui secondaire.

La mobilité est progressivement entrée dans les mœurs de la jeunesse européenne et toutes les universités du monde offrent aujourd’hui des opportunités de séjour à l’étranger, souvent indépendantes des bourses Erasmus.

L’enjeu du XXIe siècle pour les établissements de l’espace européen est le renforcement de leur attractivité face à la compétitivité d’autres zones. En dépit d’un contexte géopolitique mondial peu propice à la mobilité internationale (politiques d’immigration restrictive, résurgence de mouvements populistes protectionnistes, multiplication d’actes terroristes dans tous les pays) les États-Unis continuent d’être la première destination des flux d’étudiants internationaux.

Profitant d’une croissance économique soutenue au cours des trente dernières années et d’une démographie favorable, la zone Asie a réussi à assurer, par des investissements massifs dans l’éducation et la recherche, l’émergence d’universités de rang mondial et à développer une importante mobilité intra-régionale, privant ainsi l’Europe d’un vivier potentiel de candidats.

L’université est devenue en quelques décennies la pierre angulaire de l’économie de la connaissance et de l’innovation. Pour maintenir sa place dans l’économie mondiale, l’UE a besoin de renforcer leur compétitivité internationale, à la fois pour attirer les talents étrangers et pour endiguer la fuite des jeunes européens vers les autres régions du monde.

C’est pour cela qu’Erasmus+ est étroitement articulé avec Horizon 2020, le programme de l’UE pour la recherche et l’innovation. Ensemble, ils cherchent avant tout à attirer, retenir, mais aussi accroître, par une mobilité intra-européenne renforcée et élargie, l’employabilité des jeunes européens en leur permettant d’acquérir des compétences précieuses à l’ère de la mondialisation.![]()

Alessia Lefébure, Directrice adjointe, directrice des études, École des hautes études en santé publique (EHESP)

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

APOLLO: Reise zum MOND?

![]() Par

blatt-christophe

Le 21/12/2020

Par

blatt-christophe

Le 21/12/2020

.Warum nur sollte man eine Reise zum Mond organisieren wollen?

Was können Menschen durch diese Reise lernen?

Gibt es nicht schon genug Probleme auf der Erde?

Und gibt denn keine wichtigeren Probleme weltweit wie den Klimawandel, den Hunger un die Not der Menschen auf allen Kontinenten?

Dieses Bild der Mission von Apollo 8 aus dem Jahr 1968 gibt eine Antwort.

Wir leben auf einem Planeten als Menschheit zusammen und dieses Bild macht das klar.

Alles klar.

.

Objectif Lune : le temps de la reconquête ?

Florian Vidal, Université de Paris et José Halloy, Université de Paris

Dans un exercice d’uchronie, la série produite par Apple For All Mankind (2019) imagine un monde où l’Union soviétique aurait été, pendant la guerre froide, la première puissance au monde à envoyer un homme sur la Lune. S’ensuit l’installation de deux bases lunaires par les deux superpuissances rivales, dans une compétition effrénée. Cette production intervient au moment où plusieurs puissances se sont engagées dans une nouvelle course pour la conquête de la Lune.

En 2019, cinquante ans après la mission Apollo 11 qui vit les premiers hommes se poser sur la Lune, les États-Unis en effet ont annoncé leur intention d’y retourner en 2024. À l’ère du New Space, cette nouvelle ambition spatiale reflète non seulement une compétition géostratégique plus intense, marquée notamment par la montée en puissance de la Chine, mais aussi l’avènement d’une dimension plus économique de la conquête spatiale.

Artemis, tête de proue d’une compétition globale

Emblème de ce renouveau, le programme Artemis constitue un consortium international autour des États-Unis et inclut sept autres pays (l’Italie, le Japon, le Royaume-Uni, l’Australie, le Canada, le Luxembourg et les Émirats arabes unis). Chaque participant devrait contribuer à cette mission en apportant un élément au « puzzle » élaboré par la NASA.

Les États sollicitent largement le secteur privé pour réaliser leurs projets. Pour la conception d’un atterrisseur lunaire humain (Human Landing System, HLS), l’agence spatiale américaine a notamment attribué un contrat de 967 millions de dollars à trois entreprises concurrentes : Blue Origin (579 millions de dollars) ; Dynetics (253 millions de dollars) ; et SpaceX (135 millions de dollars). Au Japon, le groupe Toyota s’est associé à l’Agence d’exploration aérospatiale japonaise (JAXA) pour proposer un prototype de véhicule lunaire, habité et pressurisé, afin de participer aux futures missions du programme international.

À lire aussi : L’espace pour tous… ou seulement pour quelques-uns ?